손 영역과 3D 모델의 일치성을 활용한 3D 손 재구성의 비지도 도메인 적응기법

Copyright© ICROS 2025

Abstract

Recent studies have explored the use of hand-object interaction videos to develop human-like skills for robots. Estimating hand pose and reconstructing the hand mesh is crucial for transferring human motion to robot motion in hand-object interaction videos. However, acquiring hand pose and hand mesh annotations is challenging, which often limits data collection to virtual or controlled laboratory environments. In this study, we propose a source-free domain adaptation method based on pseudo-labeling for hand mesh reconstruction using mask-mesh consistency. First, we construct a hand mesh reconstruction model with two separate heads: a segmentation head and a mesh head. Additionally, we assess the consistency between predictions from the two heads (segmentation masks and reconstructed meshes) to create reliable pseudo labels during adaptation to the target domain. These pseudo labels are then utilized to fine-tune the model for adaptation to the target domain. After applying our approach to the target domain, the model’s performance improves by 5% across all metrics for hand mesh reconstruction.

Keywords:

hand mesh reconstruction, unsupervised domain adaptation, source-free domain adaptationI. 서론

최근 로봇이 사람 수준의 복잡한 물체 조작을 수행하기 위해, 사람이 물체를 조작하는 영상에서 인간의 동작 정보를 활용하는 연구가 활발히 진행되고 있다[1]. 로봇이 사람의 동작을 효과적으로 모방하여 실제 환경에서 구현하려면 정확한 사람 손의 자세 인식이 필수적이다.

손의 자세 인식 방법으로는 2D 및 3D 스켈레톤을 인식하는 방식[2]과, 파라미터화된 손 모델을 이용하여 자세와 형상을 재구성하는 방식[3,4]이 있다. 스켈레톤을 추정하는 방식은 이미지로부터 각 관절의 위치를 직접 추론하는 방법으로, 모델이 가볍고 추론 속도가 빠르다는 장점이 있다. 그러나 관절 사이의 구조적 제약 조건이 없어 손 자세가 불안정하게 추정되거나 손 크기가 일관되지 않는 문제가 있다. 반면, 파라미터화된 손 모델을 이용하는 방법은 주로 MANO [7]와 같은 모델을 이용해 손의 3D 형상을 재구성한다. MANO는 사람 손의 관절 움직임을 3D 형상으로 매핑하는 함수로, 이 방법은 사전에 정의된 손 형상 기반의 추론을 통해 자세와 크기를 일관되게 재구성할 수 있다. 하지만 이미지와 모델 파라미터 간의 대응 관계를 정확히 학습하는 데 어려움이 존재한다. 최근 연구에서는 단일 RGB 이미지를 입력받아 MANO 손 모델을 기반으로 3D 형상을 재구성하는 방법들이 제안되고 있다[3,4]. 본 연구 또한 단일 RGB 이미지만으로 손의 3D 형상을 정확히 재구성하는 방법을 다룬다[12].

한편 로봇이 사람 수준의 정교한 물체 조작을 수행하기 위해서는 다양한 동작이 포함된 대규모 데이터셋이 필수적이다. 유튜브 영상이나 일상 촬영 영상 등은 대량으로 획득할 수 있으며, 이러한 데이터를 활용하려면 다양한 카메라 각도, 배경, 조명 및 노이즈 환경에서도 강건하게 동작하는 손 형상 재구성 모델이 필요하다. 일반적으로 딥러닝 기반의 모델은 학습된 데이터 도메인에서만 우수한 성능을 보이며, 다양한 환경에 대응하려면 다양한 도메인을 폭넓게 포함한 데이터로 모델을 학습해야 한다. 그러나 손 자세 추정을 위한 데이터셋은 대부분 모션캡처, 다중 카메라 환경, VR 장비와 같은 특수한 환경에서만 얻을 수 있다. 따라서 공개된 데이터는 대체로 가상 환경이나 실험실 환경으로 제한되어 있으며[5,6,8], 실제 일상 환경에서 촬영된 영상에서는 성능이 저하될 수 있다.

본 연구는 이러한 한계를 극복하기 위해, 학습되지 않은 도메인의 영상에서도 손 형상을 효과적으로 재구성할 수 있는 비지도 도메인 적응 기법을 제안한다. 제안한 방법은 새로운 도메인의 일부 라벨링되지 않은 이미지만을 사용하여 해당 도메인 전체에 대한 손 형상 재구성 성능을 향상시키는 방식이다. 기존의 비지도 도메인 적응기법들[13, 14]과 유사하게 별도의 추가 라벨링 없이도 일상 환경의 다양한 영상에서 일관된 성능 향상을 기대할 수 있다. 제안 방법은 EMA (Exponential Moving Average) [9] 모델을 활용하여 가상 라벨(pseudo-label)을 생성하는 도메인 적응 기법으로, 모델의 2D와 3D 출력 간의 일관성을 비교해 생성한 가상 라벨을 이용해 모델을 fine-tuning하는 방식을 사용한다. 이를 검증하기 위해 실험실 환경의 데이터인 DexYCB [6]로 학습된 모델을 FreiHand [5] 데이터로 평가하였다. 그 결과 손 형상 재구성 성능 지표(AUC, MPJPE, MPVPE)에서 약 5% 이상의 성능 향상을 확인하였다.

본 논문의 구성은 다음과 같다. 2장에서는 제안된 손 재구성 모델의 구조 및 도메인 적응 기법을 상세히 설명하고, 3장에서는 실험 설계와 그 결과를 제시한다. 마지막으로 4장에서는 결론 및 향후 연구 방향을 서술한다.

II. 본론

1. 문제 정의

본 연구는 손의 3D 형상 재구성 문제와 이를 학습되지 않은 도메인에 적용하기 위한 비지도 도메인 적응 문제를 다룬다. 손의 3D 형상을 재구성하는 문제는 RGB 이미지를 입력 받아 손의 3D 형상(hand mesh)을 출력하는 문제이다. 일반적으로 기존 연구[3,4]와 같이 오른손 이미지를 입력받아 MANO [7] 모델의 파라미터를 예측하는 방식으로 진행된다. 이때 입력 이미지는 손의 위치 및 종류가 미리 검출되었다고 가정하며, 왼손 이미지는 좌우 반전을 통해 오른손과 같이 변환하여 모델에 입력한다. 비지도 도메인 적응 문제는 특정 데이터(source-dataset)에서 학습된 모델이 학습에 사용되지 않은 다른 도메인의 데이터(target-dataset)에서도 성능 저하 없이 잘 동작하게 하는 문제이다. 특히 비지도 도메인 적응은 target-dataset의 라벨 없이 이미지 데이터만을 활용하여 도메인 적응을 수행한다.

본 연구는 실험실 환경에서 학습된 모델을 다양한 환경의 데이터에 적응시키기 위해, source-dataset으로는 실험실 환경 데이터인 DexYCB [6]를 사용하였고, target-dataset으로는 다양한 환경을 포함한 FreiHand [5] 데이터를 사용하였다. 평가 시에는 FreiHand 데이터의 라벨 없이 이미지만을 이용하여 비지도 적응을 수행하였으며, 적용 전후의 성능을 비교하여 평가하였다.

2. Hand Mesh Reconstruction 모델 구성

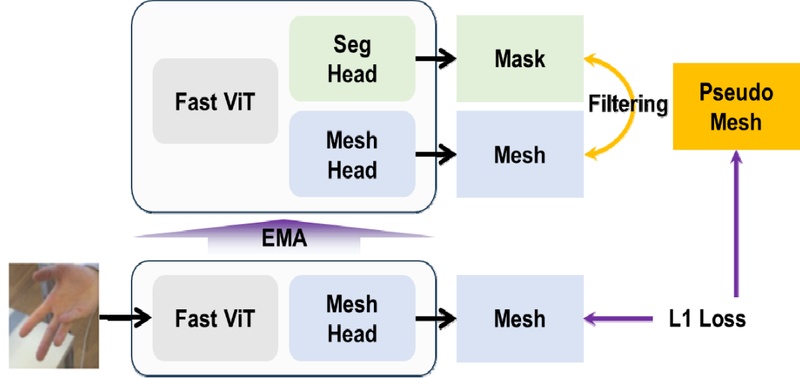

손 재구성 모델은 이미지상의 2D 키포인트를 활용하여 안정적인 3D 형상 재구성을 수행하는 Simple Baseline [3] 구조를 기반으로 구성하였다. 모델은 224x224 사이즈의 RGB 이미지를 입력받아 MANO [7] 손 모델의 778개 vertices의 3D 좌표를 출력하도록 설계하였다. 전체 모델 구조는 그림1의 상단과 같이 Fast-ViT backbone을 통과하여 이미지 특징을 추출한 뒤, Segmentation Head와 Mesh Head로 분리된다. Segmentation Head는 손 영역의 마스크를 출력하며, Mesh Head는 이미지상 손 관절의 21개의 2D 키포인트, MANO 모델을 이루는 778개 vertices의 좌표, 그리고 가상의 깊이 정보를 활용하여 최종적으로 손의 3D 형상을 출력한다. 여기서 가상의 깊이 정보는 단일 RGB 이미지로부터 카메라 파라미터에 관계없이 일관된 깊이 추정이 가능하도록 정규화한 값이다. 일반적으로 단일 이미지부터 실제 깊이를 추정하는 문제는 모호성이 존재하는데, 이는 같은 위치에 있는 물체라도 초점거리(f)에 따라 이미지상 픽셀 크기가 다르게 나타나기 때문이다. 본 연구에서는 이러한 모호성을 해소하기 위해 실제 깊이 정보(d)를 초점거리(fx, fy)로 나누어 카메라 파라미터의 영향을 제거하고, 손의 실제 길이(h)와 손이 이미지에서 차지하는 픽셀 크기(H, W)를 사용하여 정규화하였다. 정규화된 가상의 깊이 정보(γ)는 아래 (1) 식과 같이 계산한다.

| (1) |

본 논문에서는 손의 픽셀 크기(H, W)는 모델의 입력 해상도인 224 x 224로 가정하였으며, 손의 실제 길이(h)는 10 cm로 설정하였다.

학습에 사용한 손실 함수는 다음과 같다. 1) UV Loss: 이미지 상의 손 관절 위치(2D 키포인트)에 대한 L1 Loss; 2) Joints Loss: 3D 공간에서의 손 관절 위치에 대한 L1 Loss; 3) Vertices Loss: 3D 공간에서의 손 Mesh를 이루는 정점(vertices)에 대한 L1 Loss; 4) Segmentation Loss: 이미지 상의 손 영역 Mask에 대한 Dice Loss; 5) Depth Loss: 카메라 좌표계를 기준으로 손 위치에 대한 L1 Loss. 이 중 Depth Loss를 제외한 3D 공간에 대한 손실 함수(Joints Loss, Vertices Loss)는 실제 카메라 좌표계 기준 절대 좌표가 아니라, 손의 중심 좌표를 원점으로 이동시킨 상대 좌표값으로 계산한다.

3. Mask-Mesh Consistency 기반 Domain Adaptation

본 연구는 기존 학습 데이터를 사용하지 않고 새로운 환경에서 라벨링되지 않은 이미지만을 활용하여 성능을 향상시키는 비지도 도메인 적응 문제를 다룬다. 이를 위해 도메인 적응 방법으로 EMA [9] 모델을 이용한 가상 라벨 생성 방식을 사용하였다.

가상 라벨 생성을 위해 우선 source-dataset으로 학습된 모델을, 가상 라벨 생성에 사용되는 지수 이동 평균(EMA, Exponential Moving Average) 모델과 mini-batch마다 업데이트되는 모델로 구분한다. EMA 모델은 이전 모델의 출력값에 대한 지수 가중 이동 평균을 이용하여 천천히 업데이트된다. EMA 모델의 가중치 업데이트는 아래 식 (2)와 같다.

| (2) |

여기서 α는 0.999로 설정하여 새로운 도메인에 대한 가중치 가 천천히 반영되도록 하였다. 이 값은 모델이 새로운 도메인에 적응할 때 기존 모델의 출력이 급격히 변하지 않도록 조절하는 역할을 한다. 가상 라벨은 EMA 모델의 Mesh Head와 Segmentation Head의 출력 결과를 비교하여 결정하였다. 두 출력 결과의 비교는 3D mesh를 이미지상에 투영하여 생성한 마스크와 추론된 2D mask 간의 Silhouette Error(Es)를 계산하여 이루어진다. Silhouette Error는 렌더링된 마스크와 추론된 마스크 간의 차이를 정량화한 값이다. 각 픽셀에서 두 마스크 간의 차이를 제곱하여 합산한 후, 이를 전체 이미지 픽셀 수(𝐻×𝑊)로 나누어 평균을 계산한다. 이때 Silhouette Error가 0.1 미만이면, 해당 3D 형상을 가상 라벨로 간주한다.

| (3) |

여기서 와 는 각각 렌더링된 마스크와 추론된 마스크의 i 번째 픽셀 값을 나타낸다.

III. 실험 결과 및 분석

본 연구에서 제안한 방법을 평가하기 위해, 학습 데이터로는 DexYCB [6], 평가 데이터로는 FreiHand [5]를 사용하였다. 초기 학습 시 learning rate는 4e-4, batch size는 4로 설정하여 총 200 epoch 동안 학습하였으며, 추가 학습 시에는 batch size를 4로 유지한 채 learning rate를 최대 8e-5까지 점진적으로 증가시키면서 100 iteration 동안 진행하였다. 추가 학습 이후의 성능은 손 재구성 문제에서 일반적으로 사용되는 AUC, PA-MPJPE, PA-MPVPE 지표를 이용하여 평가하였다. 여기서 AUC (Area Under Curve)는 이미지 상에서 추론된 2D 관절 위치와 실제 라벨링된 2D 관절 위치 간의 정확도를 나타내는 지표로, 추론된 키포인트와 실제 키포인트 간의 거리가 특정 임계값(threshold) 이내일 때의 정확도를 측정하는 PCK (Percentage of Correct Keypoints)를 기반으로 계산된다. 구체적으로 AUC는 PCK 값을 임계값 0부터 1까지 0.1 간격으로 변화시키며 측정한 정확도 곡선 아래의 면적을 나타낸다. 3D 평가는 추론된 값과 실제 값을 PA (Procrustes Alignment) 변환으로 정렬한 뒤 측정하였다.

PA 변환은 손의 위치, 크기, 회전을 정렬하여 순수하게 손 형상 자체의 정확도를 평가하기 위한 과정이다. PA-MPJPE (Mean Per Joint Position Error)는 PA 변환 이후 21개 손 관절 각각에 대해 추론된 위치와 실제 위치 간의 3D 공간에서의 평균 거리이며, PA-MPVPE (Mean Per Vertex Position Error)는 PA 변환 이후 손의 3D 형상을 구성하는 778개 vertices의 추론된 위치와 실제 위치 간의 3D 공간에서의 평균 거리이다.

표 1은 FreiHand 데이터셋에서 도메인 적응 기법 적용 전후의 성능 평가 결과를 나타낸다. 실험 결과, 도메인 적응을 통해 AUC는 5.86%, PA-MPJPE는 6.16%, PA-MPVPE는 5.06% 만큼 향상되었다.

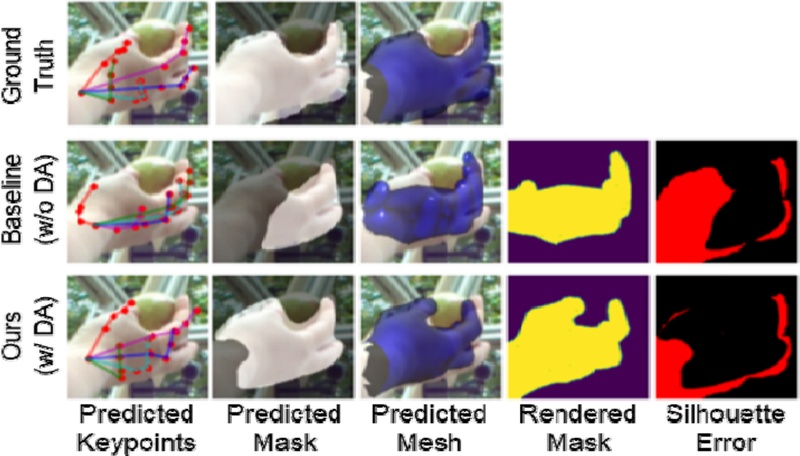

그림 2는 도메인 적응 기법 적용 전후 모델의 출력 결과를 시각화한 것이다. 왼쪽부터 순서대로 (1) 2D 키포인트, (2) Segmentation Head에서 추론한 마스크, (3) Mesh Head에서 출력한 3D 모델, (4) 3D 모델을 렌더링한 마스크, (5) 렌더링된 마스크와 추론 마스크 간의 Silhouette Error를 나타낸다. 도메인 적응 전에는 추정된 손의 자세나 각도가 부정확하게 출력되었으나, 적응 후에는 실제 형상과 더욱 잘 일치하도록 성능이 향상되었다.

IV. 결론

본 연구는 로봇 분야에서 최근 주목받는 사람의 물체 조작 영상을 바탕으로 손 형상을 재구성하는 문제를 다루며, 학습된 모델의 성능을 새로운 환경에서도 효과적으로 향상시키는 비지도 도메인 적응 방법을 제안하였다. 제안한 방법은 모델이 출력하는 2D 마스크 영역과 3D 형상의 일관성을 기반으로 가상 라벨(pseudo-label)을 생성하고, 이를 활용한 추가 학습(fine-tuning)을 통해 별도의 라벨 없이도 비지도 도메인 적응을 가능하게 한다. 이 방법론을 적용하여 실험실 환경에서 학습된 모델을 다양한 환경 도메인에 성공적으로 적응시켰으며, 간단한 추가 학습만으로 5% 이상의 성능 향상을 확인하였다. 실험 결과를 통해 제안된 방법이 적은 양의 라벨 없는 이미지 데이터만으로도 새로운 환경에서의 손 형상 재구성 성능을 효과적으로 향상시킬 수 있음을 검증하였다.

본 연구에서는 마스크 영역에 대한 정보를 얻기 위해 기존 모델 구조에 Segmentation Head를 추가하여 학습하였으며, 이후 제안된 비지도 도메인 적응 방법을 적용하였다. 향후 연구로는 Dinov2 [11]와 같은 VFMs (Vision Foundation Models)을 활용하여 다양한 도메인에서 정확한 마스크를 추론하는 능력을 확보하고, 별도의 모델 수정이나 추가 학습 없이 비지도 도메인 적응이 가능한 통합 파이프라인을 설계하고자 한다. 이를 바탕으로 더욱 다양한 환경의 영상에서 강건한 손 형상을 재구성 성능을 달성할 수 있도록 연구를 확장할 계획이다.

Acknowledgments

This work was supported by the Technology Innovation Program(00442029, Development of Tactile Intelligence in Robotic Hands Based on Tactile Data Learning for Manipulating Irregular Multiple Types of Objects) funded By the Ministry of Trade Industry & Energy(MOTIE, Korea).

상기 논문은 2024년도 ICROS-KROS 호남제주 그랜드 합동 학술대회에서 초안이 발표되었음.

References

-

H.-G. Singh, A. Loquercio, C. Sferrazza, J. Wu, H. Qi, P. Abbeel, and J. Malik, “Hand-object interaction pretraining from videos,” arXiv, Sep. 2024.

[https://doi.org/10.48550/arXiv.2409.08273]

-

W. Cheng, H. Tang, L. Van Gool, and J.-H. Ko, “HandDiff: 3D hand pose estimation with diffusion on image-point cloud,” Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, pp. 2274-2284, Apr. 2024.

[https://doi.org/10.48550/arXiv.2404.03159]

-

Z. Zhou, S. Zhou, Z. Lv, M. Zou, Y. Tang, and J. Liang, “A simple baseline for efficient hand mesh reconstruction,” Proc. of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, pp. 1367-1376, Mar. 2024.

[https://doi.org/10.48550/arXiv.2403.01813]

-

G. Pavlakos, D. Shan, I. Radosavovic, A. Kanazawa, D. Fouhey, and J. Malik, “Reconstructing hands in 3d with transformers,” Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, pp. 9826-9836, Dec. 2023.

[https://doi.org/10.48550/arXiv.2312.05251]

-

C. Zimmermann, D. Ceylan, J. Yang, B. Russell, M. Argus and T. Brox, “Freihand: A dataset for markerless capture of hand pose and shape from single rgb images,” Proc. of the IEEE/CVF International Conference on Computer Vision, pp. 813-822, Sep. 2019.

[https://doi.org/10.48550/arXiv.1909.04349]

-

Y.-W. Chao, W. Yang, Y. Xiang, P. Molchanov, A. Handa, J. Tremblay, Y. S. Narang, K. Van Wyk, U. Iqbal, S. Birchfield, J. Kautz, and D. Fox, “DexYCB: A benchmark for capturing hand grasping of objects,” Proc. of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, pp. 9044-9053, Apr. 2021.

[https://doi.org/10.48550/arXiv.2104.04631]

-

J. Romero, D. Tzionas, and M.-J. Black, “Embodied hands: Modeling and capturing hands and bodies together,” ACM Transactions on Graphics (Proc. SIGGRAPH Asia), vol. 36, no. 6, Nov. 2017.

[https://doi.org/10.48550/arXiv.2201.02610]

-

P. Banerjee, S. Shkodrani, P. Moulon, S. Hampali, S. Han, F. Zhang, L. Zhang, J. Fountain, E. Miller, S. Basol, R. Newcombe, R. Wang, J. J. Engel, and T. Hodan, “HOT3D: Hand and Object Tracking in 3D from Egocentric Multi-View Videos,” arXiv, Nov. 2024.

[https://doi.org/10.48550/arXiv.2411.19167]

-

Z. Cai, A. Ravichandran, S. Maji, C. Fowlkes, Z. Tu, and S. Soatto, “Exponential moving average normalization for self-supervised and semi-supervised learning,” Proc. of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (pp. 194-203) Jan. 2021.

[https://doi.org/10.48550/arXiv.2101.08482]

-

N. Ravi, J. Reizenstein, D. Novotny, T. Gordon, W.-Y. Lo, J. Johnson, and G. Gkioxari, “Accelerating 3d deep learning with pytorch3d,” arXiv, Jul. 2020.

[https://doi.org/10.48550/arXiv.2007.08501]

-

M. Oquab, T. Darcet, T. Moutakanni, H. Vo, M. Szafraniec, V. Khalidov, P. Fernandez, D. Haziza, F. Massa, A. El-Nouby, M. Assran, N. Ballas, W. Galuba, R. Howes, P.-Y. Huang, S.-W. Li, I. Misra, M. Rabbat, V. Sharma, G. Synnaeve, H. Xu, H. Jegou, J. Mairal, P. Labatut, A. Joulin, and P. Bojanowski, “Dinov2: Learning robust visual features without supervision,” arXiv, Feb. 2024.

[https://doi.org/10.48550/arXiv.2304.07193]

- R. Kang, S. Noh, J. Lee, N. Dong, and K. lee, “Domain adaptation method for hand mesh reconstruction,” Proc. of 2024 ICROS-KROS Honam-Jeju Regional Conference (in Korea), 2024.

- J.Moon, H.Seo, and K.Yu, “Application of unsupervised domain adaptation for timeseries data classification model training with data imbalance,” Proc. of 2023 38th ICROS Annual Conference (ICROS 2023), 2023

- S. Lee, J. Hyun, H. Seung, S. Lee, and T.Kim, “Domain adaptation method for training semantic segmentation networks with virtual dataset,” Proc. of 2023 38th ICROS Annual Conference (ICROS 2023), 2023

2020년 광주과학기술원 기계공학과 졸업. 2020년~현재 광주과학기술원 AI 융합학과 통합과정 재학 중. 관심분야는 컴퓨터 비전, 지능로봇.

2020년 단국대학교 기계공학과 졸업. 2020년~2022년 광주과학기술원 광주과학기술원 융합기술학제학부 졸업(석사). 2020년~현재 광주과학기술원 AI 융합학과 박사과정 재학 중. 관심분야는 컴퓨터 비전, 지능로봇.

2019년 광주과학기술원 화학과 졸업. 2019년~현재 광주과학기술원 AI 융합학과 통합과정 재학 중. 관심분야는 컴퓨터 비전, 지능로봇.

2022년 광주과학기술원 기계공학과 졸업. 2022년~현재 광주과학기술원 AI 융합학과 통합과정 재학 중. 관심분야는 컴퓨터 비전, 지능로봇.

2008년 한국과학기술원 기계공학과 (공학박사). 2008년~2012년 KIST 신경과학센터. 2012년~2018년 삼성종합기술원. 2018년~현재 광주과학기술원 AI 융합학과 교수. 관심분야는 컴퓨터 비전, 지능로봇.