합성 안개 이미지 기반 안개 밀도에 따른 안개 제거 모델의 성능 분석

Copyright© ICROS 2025

Abstract

Adverse weather conditions such as fog can severely impair object detection performance in autonomous driving systems. Therefore, research on improving visibility through efficient fog removal is being conducted. However, excessive fog removal can result in losing image details or introducing artificial artifacts, while insufficient fog removal may obscure important objects. This study compares various synthetic fog image techniques and analyzes the performance of fog removal models trained with different fog densities to evaluate their performance based on fog density. Models trained with light fog show significant performance degradation, while those trained with dense fog experience less performance loss. In the future, we plan to develop a fog density estimation algorithm for optimal fog removal and will compare the performance of various fog removal algorithms to maximize their effectiveness.

Keywords:

synthetic fog images, fog density, foggy environments, fog removal, YOLO (You Only Look Once), deep learning, object detectionI. 서론

자율주행 시스템에서 카메라를 이용한 객체 검출은 차량의 안전한 주행을 보장하는 핵심 기술 중 하나이다[1,2]. 카메라는 인간의 시각처럼 주변 환경을 파악하여 차량이 도로 상황, 장애물을 탐지하는 역할을 한다. 객체 검출이 원활하게 이루어지지 않으면 보행자나 다른 차량과 충돌 위험이 커지므로, 정확성과 신뢰성 확보가 필수적이다[3]. 특히, 안개와 같은 악천후 조건에서는 가시성이 저하되고 물체의 일부가 흐릿해지거나 가려져 객체 검출 성능이 낮아지는 문제가 발생한다[4-6]. 이러한 문제를 해결하기 위해 효율적인 안개 제거를 통해 가시성을 확보하는 연구가 진행되고 있고[7-9], 이와 더불어 효율적인 안개 제거를 위해 현실적인 합성 안개 이미지를 생성하는 기술이 개발되고 있다[10,11]. 이런 연구들은 안개 환경에서 객체 검출 성능을 향상시키기 위한 다양한 접근법을 제시하고 있지만 아직도 해결해야 할 문제점이 남아있다. 안개 환경에서 알고리즘의 성능을 평가하기 위해서는 다양한 안개 밀도를 정량적으로 측정하고 다양한 장면과 객체들이 충분하게 포함된 벤치마크가 필수적이지만 현재 사용되는 NH-Haze, REVIDE 같은 데이터셋은 정량화된 안개 밀도에 따른 알고리즘 성능을 평가하는 데 국한되어 있고 객체의 다양성 측면에서도 부족함이 있다[12,13]. 현재 사용되는 벤치마크의 예로, 스모그 머신을 사용해 인위적으로 안개를 생성하여 이미지를 수집하는 경우가 있다. 그러나 이러한 방식 또한 다양한 장면과 객체를 충분히 포함하기 어렵고 안개의 거리에 따른 밀도 변화를 충분히 반영하지 못하여, 실제 환경에서 발생하는 안개의 특성을 충분히 반영하지 못할 수 있다. 이로 인해 이러한 비현실적인 데이터셋은 실제 도로 주행 환경에서는 일관된 성능을 보장하지 못하게 만든다[14,15]. 또한, 기존 연구에서는 안개 제거를 적용할 때 안개가 과도하게 제거되어 이미지의 세부 정보가 손실되거나 인위적인 아티팩트(artifact)가 발생할 수 있고 반대로 안개가 충분히 제거되지 않으면 중요한 부분이 가려져 제대로 인식되지 않을 수 있다.

이러한 문제를 해결하려면 안개 제거에 사용되는 학습 데이터셋을 구성할 때 적절한 안개 밀도의 균형을 유지하는 것이 매우 중요하며 이를 위해, 다양한 안개 밀도를 반영한 데이터셋을 활용하여 안개 제거 모델의 성능을 분석할 필요가 있다. 따라서, 본 논문에서는 단일 이미지의 깊이를 추정한 후, 안개 밀도에 따라 합성 안개 이미지를 생성하여 이를 기반으로 안개 제거 모델을 구축하였다. 다양한 밀도의 실제 안개 상황에서 수집한 차량 블랙박스 영상과 도로환경 벤치마크 데이터를 활용하여, 안개 밀도에 따라 적절한 안개 제거 모델을 적용하지 않았을 때 미치는 영향을 분석한다. 또한 다양한 안개 조건에서도 일관되고 우수한 성능을 제공하는 안개 제거 모델을 선정하고, 이를 바탕으로 연구의 활용 방향 및 실제 자율주행 시스템에서 안개 제거 기술을 효과적으로 적용할 수 있는 방안을 제시한다.

본 논문의 구성은 다음과 같다. 2장에서는 깊이 추정 기반 합성 안개 이미지 생성에 대해 설명하고, 3장에서는 안개 제거 알고리즘에 대해 소개하고 선정 과정에 대해 설명한다. 4장에서는 안개 밀도에 따른 검출 성능과 다양한 밀도의 합성 안개 이미지에서 서로 다른 안개 밀도로 학습한 안개 제거 모델의 안개 제거 후 객체 검출 성능을 분석한다. 마지막으로 5장에서는 4장에서 분석한 결과를 요약하고 연구 활용 방향 및 향후 계획을 제시하며 결론을 맺는다.

II. 깊이 추정 기반 합성 안개 이미지 생성

1. Monodepth2 깊이 추정 알고리즘[16]

단일 이미지에서 깊이를 추정하는 연구는 컴퓨터 비전 분야에서 오랫동안 도전적인 과제였다. 그중 Monodepth2는 자가 지도 학습 방법을 제안하여 단일 이미지로부터 비교적 정확한 깊이 맵을 추정하였다[16].

기존 재투영 손실 방식은 연속된 소스 프레임들에서 각 프레임의 재투영 오류를 모두 평균화하여 손실을 계산하여 가려진 픽셀에 의한 큰 오류도 포함시켰다. 이를 해결하기 위해서 여러 소스 프레임 중에서 가장 작은 오류를 선택하여 손실을 계산한다. 이 방법은 가려진 픽셀로 인해 발생하는 경계의 흐릿함을 줄여 깊이 추정의 정확도를 향상시켰다.

기존의 다중 스케일 학습 방식은 낮은 해상도에서 깊이를 추정할 때 세부 정보가 손실되는 문제가 있었다. 이러한 문제를 해결하기 위하여, 낮은 해상도에서 재투영 오류를 계산하지 않고 원본 이미지로 업샘플링(upsampling)한 후 재투영 오류를 계산하였다. 이 방법은 모든 해상도의 정보를 고해상도로 결합하여, 세부 정보 손실을 줄였다.

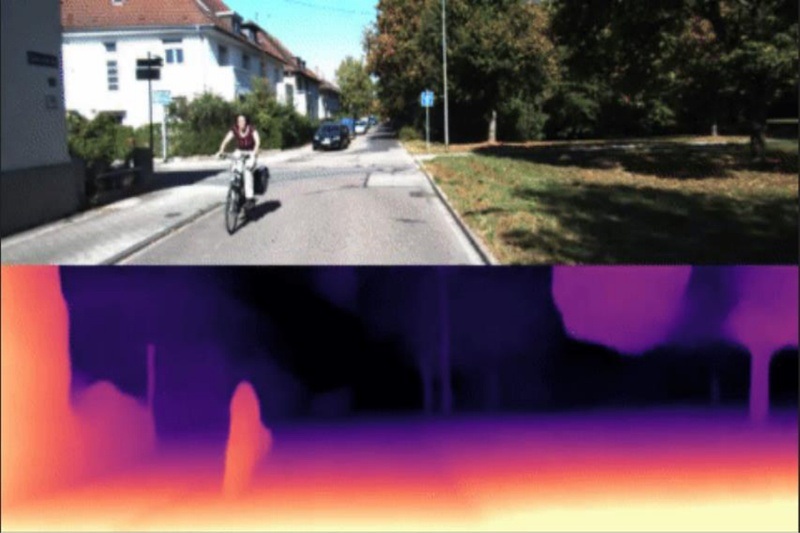

자가 지도학습 방식에서 카메라의 움직임이 없거나, 카메라와 물체가 같은 속도로 움직이는 경우에는 프레임 간의 차이가 없어 정확한 깊이 추정이 어렵다. 이를 해결하기 위해서, 프레임 간의 변화가 없는 픽셀을 자동으로 감지하여 학습에서 제외했다. 이 방식은 움직임이 없는 픽셀을 무시하고 변화가 있는 픽셀에만 집중해 학습함으로써, 정적인 장면에서도 깊이 추정 정확도를 향상시켰다. Monodepth2는 KITTI 데이터셋[17]을 사용하여 검증되었다. KITTI 데이터셋은 도로 환경에서 촬영된 데이터를 기반으로 하는 데이터셋이며, 자율주행 관련 연구 분야에서 주요 벤치마크로 사용되고 있다. Monodepth2는 KITTI 벤치마크에서 성능을 비교한 결과 기존 방법들에 비해 높은 정확도를 나타내어 깊이 추정 모델로 선정하였다. 그림 1은 Monodepth2를 이용하여 단일 이미지에 깊이를 추정한 이미지이다.

2. 합성 안개 이미지 생성

합성 안개 이미지를 생성하기 위해 대기 산란 모델을 적용하여 안개를 생성하였다. 대기 중 산란과 흡수에 의한 시야 제한을 설명하는 물리법칙인 Koschmieder의 법칙은 식 (1)과 같이 표현된다[18].

| (1) |

여기서 x 는 픽셀의 위치를 의미하며, I(x)는 안개가 포함된 이미지, J(x) 는 원래의 깨끗한 이미지를 나타낸다. A 는 대기의 산란광을 의미한다. 또한, 식 (2)에서 표현된 것처럼, t(x)는 전송 맵을 나타내며, d(x)는 장면의 깊이, β 는 대기의 산란 계수를 나타낸다.

| (2) |

본 논문에서는 합성 안개 이미지를 생성할 때 대기 산란 계수 β 를 변경해 가면서 다양한 안개 밀도를 구현하였다.

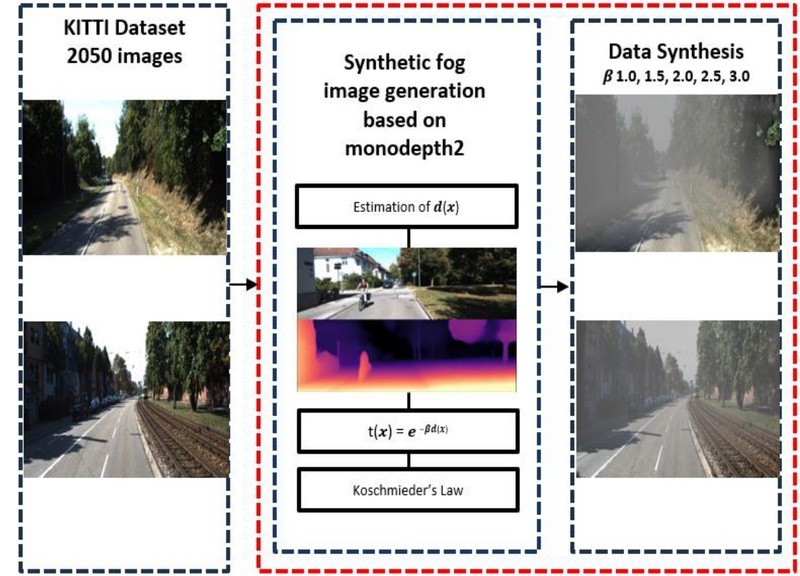

합성 안개 이미지 데이터셋 구축을 위해 KITTI 데이터셋의 2050장을 대상으로 깊이 추정 후 안개 효과를 적용한 경우와 이미지 전체에 균일하게 안개 밀도 효과를 적용한 경우로 나누어 진행하였다. 대기 산란광 A 는 밝기 스펙트럼의 중간값 이상으로 설정하였고, 대기 산란 계수는 1.0부터 3.0까지 0.5 간격으로 각각 적용함으로써 다양한 안개 밀도를 모사하였으며, 밀도에 따라 410장씩 구축하였다. 합성 안개 이미지 생성을 위한 전체적인 프레임워크는 그림 2에 나타내었다.

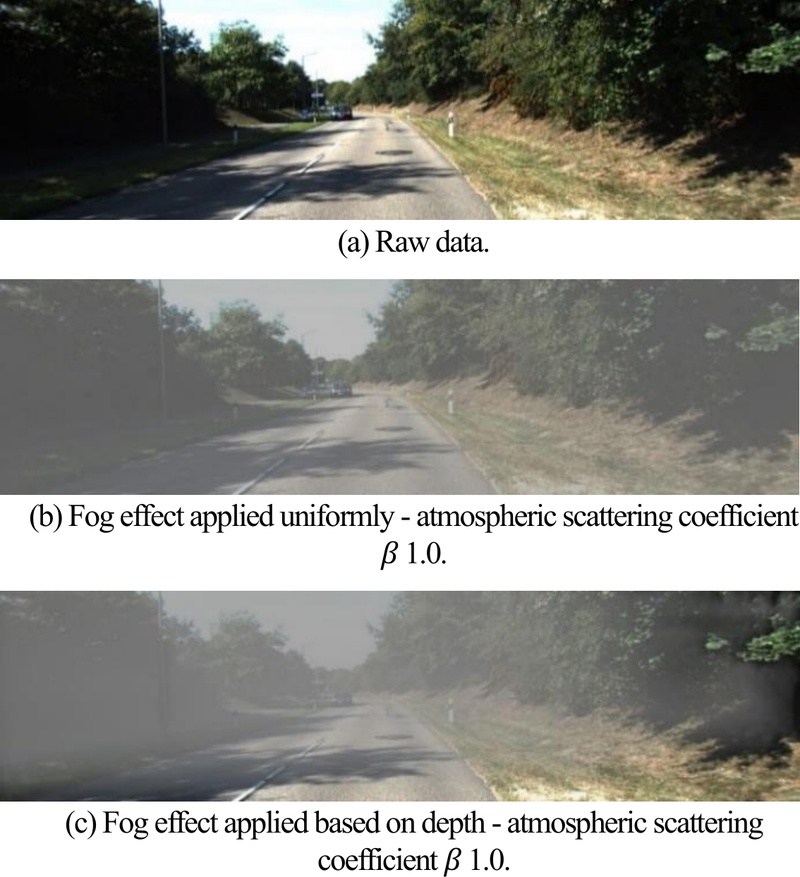

그림 3은 깊이 추정 기반 안개 효과와 균일 분포 안개 효과를 비교하기 위해 나타낸 예시로 (a)는 KITTI 데이터셋의 원본 이미지 (b)는 대기 산란 계수 1.0을 적용하여 균일하게 분포하여 생성한 안개 이미지, (c)는 대기 산란 계수 1.0을 적용하여 깊이 추정 결과에 따라 생성한 안개 이미지를 나타낸다.

III. 안개 제거 알고리즘

1. MixDehazeNet [19]

MixDehazeNet은 안개 제거를 위한 네트워크로, 주로 두 가지 중요한 모듈인 다중 스케일 병렬 대형 컨볼루션 커널 모듈(MSPLCK)과 향상된 병렬 주의 모듈(EPA)을 결합하여 기존 방법들의 한계를 극복하였다.

전통적인 CNN 기반 방법들은 단일 크기의 커널을 사용하여 이미지를 처리하지만 실제 안개 이미지는 안개의 특성에 따라 안개 밀도가 부분마다 다르게 분포되어 있다. 따라서 단일 크기의 커널만으로는 다양한 밀도의 안개가 분포된 이미지에서는 효과적으로 안개를 제거하는데 한계점이 존재한다. MixDehazeNet은 이러한 문제를 해결하기 위해 다중 스케일 병렬 커널을 도입하여, 각각의 커널이 서로 다른 크기의 영역을 처리한다. 이를 통해 이미지에서 넓은 부분에 퍼진 안개와 세부적인 영역의 안개를 동시에 효과적으로 제거할 수 있게 하였다.

향상된 병렬 주의 모듈(EPA)은 단순 픽셀 주의(SPA, Simple Pixel Attention), 픽셀 주의(PA, Pixel Attention), 채널 주의(CA, Channel Attention)를 병렬로 결합하여 이미지 복원 과정에서 전역 및 지역 정보를 동시에 처리할 수 있는 메커니즘(mechanism)을 제공한다.

단순 픽셀 주의(SPA)는 개별 픽셀 간의 차이를 고려하여 지역적으로 중요한 픽셀을 강조하고 덜 중요한 픽셀은 낮은 가중치를 부여하여 처리한다.

픽셀 주의(PA)는 단순 픽셀 주의와 달리, 픽셀 간의 정보뿐만 아니라 이미지 전체의 전역적 정보를 함께 고려하여 각 픽셀이 전체 이미지에서 차지하는 중요도를 평가하고, 중요도가 높은 픽셀을 더욱 정밀하게 복원하는데 중점을 둔다.

채널 주의(CA)는 특징 맵의 각 채널이 얼마나 중요한지 판단하고, 중요한 채널은 강조하고 덜 중요한 채널은 억제하여 복원 품질을 높인다. 이러한 병렬 결합을 통해 모델은 전역적 색상 분포와 지역적 세부 사항을 동시에 고려하여 더 정교하고 높은 품질의 복원이 가능하다.

MixDehazeNet 알고리즘은 SOTS Indoor 데이터셋에서 최대 신호 대 잡음비(peak signal to noise ratio, PSNR) 42.62 dB, 구조적 유사도 지수 측정(structural similarity index measure, SSIM) 0.997을 달성하였고, SOTS Outdoor에서 PSNR 36.50 dB, SSIM 0.986으로 우수한 성능을 보인 것을 확인하였다.

2. 안개 제거 알고리즘 선정을 위한 환경 구축 및 검출 성능 분석 결과

검출 성능을 평가하기 위해, 실시간성과 높은 검출 성능을 갖춘 객체 검출 알고리즘으로 YOLOv8 (You Only Look Once)을 선정하였다[20]. 객체 검출 모델 학습을 위해 다양한 환경에서 차량 전면 카메라로 수집된 이미지로 구성된 BDD100k [21] 데이터셋을 사용하였으며, 총 69,863장의 차량 이미지를 대상으로 학습을 진행하였다. 객체 검출 성능 비교를 위해 실제 도로에서의 안개 환경의 블랙박스와 안개 환경 벤치마크 데이터를 테스트 데이터셋으로 구축하여 안개 제거 전후의 평균 객체 검출 수를 기준으로 진행하였다. 이때 안개 제거 알고리즘 선정을 위해 SOTS Indoor, Outdoor [22]에서 성능이 우수한 MixDehazeNet[19]과 SFNet[23] 알고리즘을 비교하였다.

표 1은 균일 분포 안개 효과에서의 평균 객체 검출 수를 나타내며, 표 2는 깊이 추정 기반 안개 효과에서의 평균 객체 검출 수를 나타내었다. 표를 통해 알 수 있듯이 깊이 추정 기반으로 안개 효과를 적용한 모델이 이미지 전체에 균일하게 안개 효과를 적용한 모델보다 더 우수한 성능을 보였다. 또한, MixDehazeNet이 SFNet 보다 안개 제거 후 객체 검출 성능이 뛰어나 MixDehazeNet을 최종적으로 선택하였다[24].

IV. 안개 밀도 세분화에 따른 안개 제거 모델 검출 성능 분석

1. 안개 제거 모델 구축 및 성능 평가

대기 산란 계수를 1.0, 1.5, 2.0, 2.5, 3.0 및 1.0~3.0(혼합) 범위로 조정하여 깊이 추정 기반 합성 안개 이미지를 생성하고, 이를 통해 성능을 평가하였다. 테스트 데이터셋을 확장하여, 안개가 낀 도로의 블랙박스 영상 9개를 프레임 단위로 분할한 후, 안개 제거 전후의 객체 검출 성능을 분석하였다. 이에 대한 예시 이미지는 그림 4에 나타내었다.

그 결과, 모든 경우에서 원본 데이터보다 객체 검출 성능이 우수했으며, 특히 대기 산란 계수 2.0에서 10,426개의 객체를 검출하여 원본의 9,330개보다 1,096개 더 많은 객체를 검출함으로써 가장 우수한 성능을 보였다. 대기 산란 계수 1.0~3.0은 안개 제거 후의 결과에서 가장 성능이 좋지 않은 것을 확인하였다. 이에 대한 결과는 표 3에 나타내었다.

Object detection performance comparison based on fog removal models using the dashcam dataset in foggy environments.

Foggy Zurich 데이터셋은 도로 환경에서 안개 조건을 벤치마크로 활용하기 위해 설계된 대규모의 실제 데이터셋으로, 총 3,808장의 고해상도 이미지(1920×1080)로 구성되어 있다[25]. 이 데이터는 현실적인 안개 환경에서 촬영된 실제 데이터로, 그림 5에 예시 이미지를 나타내었다. 표 4는 안개 밀도에 따른 안개 제거 모델의 객체 검출 성능을 보여준다. 분석 결과, 대기 산란 계수 2.0인 모델을 사용하여 안개 제거를 적용한 경우, 원본 데이터보다 약 326개 더 많은 객체를 검출하였다. 이는 원본 데이터의 검출 결과인 6,399개에서 6,725개로 향상된 결과를 나타내며, 안개 제거가 검출 성능 향상에 기여했음을 확인할 수 있다.

또한, Foggy Zurich 데이터셋을 활용하여 안개 밀도에 따라 light fog, medium fog, heavy fog로 분류한 후 안개 제거 성능을 분석하였다. 실험에는 각각 light fog 1,556장, medium fog 1,498장, heavy fog 40장이 사용되었다. 분석 결과, light fog와 medium fog에서는 대기 산란 계수 2.0인 모델을 사용해 안개 제거를 적용했을 때 가장 우수한 성능을 보였다. 반면, heavy fog에서는 대기 산란 계수 1.0~3.0인 모델을 사용해 안개 제거를 적용한 경우 성능이 가장 뛰어난 것으로 확인되었다. 모든 실험 조건에서 안개 제거를 적용한 후, 객체 검출 성능이 전반적으로 향상되었다. 그러나 light fog와 medium fog의 경우, 대기 산란 계수를 비교적 높은 값으로 학습한 안개 제거 모델을 사용할 때 검출 성능이 크게 하락하는 경향이 관찰되었다. 특히, light fog에서는 대기 산란 계수 3.0인 모델을 사용했을 때 객체 검출 수가 오히려 132개 감소하는 결과를 보였다. 이때 light fog의 검출 성능 결과는 표 5, medium fog는 표 6, heavy fog는 표 7에 각각 나타내었다.

Object detection performance comparison based on fog removal models using the light Foggy Zurich dataset.

Object detection performance comparison based on fog removal models using the medium Foggy Zurich dataset.

Object detection performance comparison based on fog removal models using the heavy Foggy Zurich dataset.

DAWN (Detection in Adverse Weather Nature) 데이터셋은 도로 환경에서 다양한 악천후 조건을 벤치마크하기 위해 설계된 실제 데이터셋이다[26]. 이 데이터셋은 도시, 고속도로, 교차로 등 다양한 교통 상황을 반영하며, 자동차, 버스, 트럭과 같은 차량뿐만 아니라 사람과 자전거 이용자에 대한 데이터를 포함한다. 총 1,000장의 고해상도 이미지를 포함하며, 안개, 비, 눈, 모래폭풍 등 자연적인 악천후 환경에서 수집된 데이터를 활용한다. 이에 대한 예시 이미지는 그림 6에 나타내었다. 특히, 안개와 관련된 300장의 이미지를 대상으로 객체 검출 성능을 평가하였다. 표 8은 대기 산란 계수 1.0~3.0인 모델을 사용하여 안개 제거를 적용한 결과, 원본 이미지보다 31개 더 많은 객체를 검출했음을 보여준다.

2. 합성 안개 데이터셋에서의 성능 평가

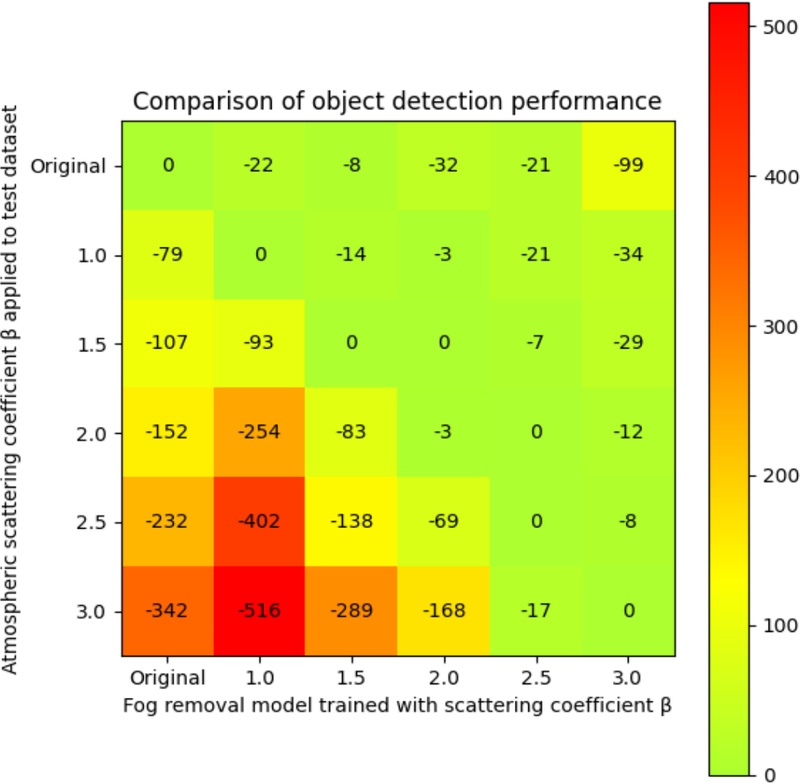

학습에 사용되지 않은 깨끗한 환경의 도로 블랙박스 영상을 수집하여 깊이 추정 기반 합성 안개 효과를 적용하여 안개 밀도별 안개 제거 모델의 성능을 분석하였다. 같은 안개 밀도에 대해 학습한 모델이 가장 성능이 우수하였고, 입력 이미지보다 안개 밀도가 낮은 이미지로 학습한 모델로 안개 제거를 할 시 큰 폭으로 성능이 저하되는 것을 확인하였다.

그림 7은 다양한 밀도의 합성 안개 이미지에서 서로 다른 안개 밀도로 학습한 안개 제거 모델의 안개 제거 후 객체 검출 성능을 나타낸다. 안개 제거 모델은 대기 산란 계수 1.0, 1.5, 2.0, 2.5, 3.0의 값으로 각각 학습하였다. 그래프에서 구간별로 표시된 값은 입력 이미지의 안개 밀도에서 안개 제거 모델별 최대 검출 수와 입력 이미지의 검출 수의 차이를 나타낸다. x축은 해당 대기 산란 계수로 학습한 안개 제거 모델을 나타내며, y축은 테스트 데이터셋에 적용된 대기 산란 계수의 값을 나타낸다. 이때, 가장 검출 성능이 저하된 경우는 대기 산란 계수 3.0 이미지에서 대기 산란 계수 1.0으로 학습한 모델을 사용해 안개를 제거했을 때로, 입력 이미지에서 두 모델의 검출 수의 차이가 516개였으며, 안개 제거 전 합성 안개 이미지에서 안개를 제거한 것보다 174개 적게 검출하였다.

V. 결론

본 논문에서는 안개 환경에서 합성 안개 이미지 기법에 따른 안개 제거 성능을 분석하였다. 이미지 전체에 균일하게 적용한 안개 효과와 깊이 추정 기반으로 적용한 안개 효과를 비교한 결과, 깊이 추정 기반 안개 효과가 더 우수한 객체 검출 성능을 보였다. 또한, 다양한 안개 밀도 상황에서 안개 제거 성능을 확인하기 위해 서로 다른 안개 밀도로 구성된 데이터셋을 사용하여 학습한 안개 제거 모델들의 성능을 분석하였다. 이때 활용된 데이터셋은 안개 환경 블랙박스 데이터셋, Foggy Zurich, DAWN 데이터셋이다. Foggy Zurich 데이터셋은 DAWN에 비해 안개 밀도가 낮은 특징이 있고, 안개 환경 블랙박스 데이터셋은 안개 밀도가 다양하게 분포되어 있다는 특징이 있다. 대부분의 실험에서 안개 제거를 적용한 후 객체 검출 성능이 전반적으로 향상되었다.

또한, 대기 산란 계수를 2.0으로 설정한 모델과 1.0~3.0 범위에서 설정한 모델은 다양한 안개 밀도 환경에서도 안정적인 성능을 보이는 것으로 나타났다. Foggy Zurich 데이터셋의 light fog와 medium fog에서는 대기 산란 계수를 높게 설정해 학습한 모델에서 성능이 하락하는 경향이 나타났으며, DAWN 데이터셋에서는 대기 산란 계수를 낮게 설정해 학습한 모델에서 성능 저하가 관찰되었다.

이러한 결과를 통해, 안개 밀도에 따라 적절한 안개 제거 모델을 선택하는 것이 객체 검출 성능 향상에 중요한 요인임을 확인할 수 있었다. 특히, 다양한 안개 환경에서도 일관되면서 우수한 성능을 보인 모델은 대기 산란 계수를 2.0으로 설정한 모델과 1.0~3.0 범위에서 설정한 모델로, 이는 향후 자율주행 시스템 적용 시 유의미한 기준이 될 수 있다. 추가적으로 다양한 안개 밀도가 객체 검출 성능에 미치는 영향을 파악하기 위해 여러 밀도의 안개 효과가 적용된 이미지를 생성하여 추가 분석을 진행하였다. 그 결과 옅은 안개 이미지로 학습한 모델은 성능이 크게 저하된 반면, 짙은 안개 이미지로 학습한 모델은 상대적으로 안정적인 성능을 보였다. 따라서 안개 제거 모델의 선정이 어려운 경우, 짙은 안개 데이터셋으로 학습한 모델이 더 유리할 수 있음을 알 수 있었다. 추후에는 안개 밀도를 판별하는 알고리즘을 개발하여, 안개 밀도에 따라 최적의 안개 제거가 이루어지도록 할 계획이다. 또한, 더 다양한 안개 제거 알고리즘의 성능을 비교하여 안개 제거 효과를 극대화할 예정이다.

Acknowledgments

본 연구는 과학기술정보통신부의 재원으로 한국연구재단의 지원(No.2021R1C1009219)과 2024년도 정부(과학기술정보통신부)의 재원으로 한국연구재단-현장연계 미래선도인재양성 지원사업의 지원(No. NRF-2022H1D8A3038669)을 받아 수행된 연구임.

이 논문은 2024 제39회 제어·로봇·시스템학회 학술대회에 초안이 발표되었음.

REFERENCES

- S. Y. Kim and C. H. Kang, “YOLOv9 and deepsort algorithm for multiple object detection and tracking,” Proc. of the Control, Robotics and Systems Conference (in Korean), July 2, 2024.

-

H. S. Kim, H. Y. Ra, A. R. Kim, and S. Y. Kim, “Research on building an object detection dataset based on transfer learning using CARLA,” Journal of Control, Robotics, and Systems (in Korean), vol. 30, no. 2, pp. 175-182, 2024.

[https://doi.org/10.5302/J.ICROS.2024.23.0204]

-

Y. J. Kim, S. M. Hong, and S. Y. Kim, “Analysis of vehicle-detection performances based on observation conditions and learning configurations,” Journal of Control, Robotics and Systems (in Korean), vol. 30, no. 6, pp. 656-661, 2024.

[https://doi.org/10.5302/J.ICROS.2024.23.8006]

-

H. M. Hu, H. Zhang, Z. Zhao, B. Li, and J. Zheng, “Adaptive single image dehazing using joint local-global illumination adjustment,” IEEE Transactions on Multimedia, vol. 22, no. 6, pp. 1485-1495, 2019.

[https://doi.org/10.1109/TMM.2019.2944260]

-

J. Li, R. Xu, J. Ma, Q. Zou, J. Ma, and H. Yu, “Domain adaptive object detection for autonomous driving under foggy weather,” Proc. of the IEEE/CVF Winter Conference on Applications of Computer Vision, pp. 612-622, 2023.

[https://doi.org/10.1109/WACV56688.2023.00068]

-

W. Liu, G. Ren, R. Yu, S. Guo, J. Zhu, and L. Zhang, “Image-adaptive YOLO for object detection in adverse weather conditions,” Proc. of the AAAI Conference on Artificial Intelligence, vol. 36, no. 2, pp. 1792-1800, June 2022.

[https://doi.org/10.1609/aaai.v36i2.20072]

-

Y. Wang, X. Yan, F. L. Wang, H. Xie, W. Yang, X. P. Zhang, and M. Wei, “Ucl-dehaze: Towards real-world image dehazing via unsupervised contrastive learning,” IEEE Transactions on Image Processing, 2024.

[https://doi.org/10.1109/TIP.2024.3362153]

-

Y. Cui and A. Knoll, “Exploring the potential of channel interactions for image restoration,” Knowledge-Based Systems, vol. 282, p. 111156, 2023.

[https://doi.org/10.1016/j.knosys.2023.111156]

-

Y. Cui, W. Ren, X. Cao, and A. Knoll, “Image restoration via frequency selection,” IEEE Transactions on Pattern Analysis and Machine Intelligence, 2023.

[https://doi.org/10.1109/TPAMI.2023.3330416]

-

J. Zhang, Y. Cao, Z. J. Zha, and D. Tao, “Nighttime dehazing with a synthetic benchmark,” Proc. of the 28th ACM International Conference on Multimedia, pp. 2355-2363, 2020.

[https://doi.org/10.1145/3394171.3413763]

-

S. Zhao, L. Zhang, S. Huang, Y. Shen, and S. Zhao, “Dehazing evaluation: Real-world benchmark datasets, criteria, and baselines,” IEEE Transactions on Image Processing, vol. 29, pp. 6947-6962, 2020.

[https://doi.org/10.1109/TIP.2020.2995264]

-

X. Zhang, H. Dong, J. Pan, C. Zhu, Y. Tai, C. Wang, and F. Wang, “Learning to restore hazy video: A new real-world dataset and a new method,” Proc. of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, pp. 9239-9248, 2021.

[https://doi.org/10.1109/CVPR46437.2021.00912]

-

C. O. Ancuti, C. Ancuti, and R. Timofte, “NH-HAZE: An image dehazing benchmark with non-homogeneous hazy and haze-free images,” Proc. of the IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops, pp. 444-445, 2020.

[https://doi.org/10.1109/CVPRW50498.2020.00230]

-

P. Narayanan, X. Hu, Z. Wu, M. D. Thielke, J. G. Rogers, A. V. Harrison, and Z. Wang, “A multi-purpose realistic haze benchmark with quantifiable haze levels and ground truth,” IEEE Transactions on Image Processing, vol. 32, pp. 3481-3492, 2023.

[https://doi.org/10.1109/TIP.2023.3245994]

-

L. A. Tran, C. N. Tran, D. C. Park, J. Carrabina, and D. Castells-Rufas, “Toward improving robustness of object detectors against domain shift,” Proc. of the 2024 International Conference on Green Energy, Computing and Sustainable Technology (GECOST), pp. 01-05, IEEE, 2024.

[https://doi.org/10.1109/GECOST60902.2024.10474777]

-

C. Godard, O. Mac Aodha, M. Firman, and G. J. Brostow, “Digging into self-supervised monocular depth estimation,” Proc. of the IEEE/CVF International Conference on Computer Vision, pp. 3828-3838, 2019.

[https://doi.org/10.1109/ICCV.2019.00393]

-

A. Geiger, P. Lenz, C. Stiller, and R. Urtasun, “Vision meets robotics: The KITTI dataset,” The International Journal of Robotics Research, vol. 32, no. 11, pp. 1231-1237, 2013.

[https://doi.org/10.1177/0278364913491297]

-

W. E. K. Middleton, “Vision through the atmosphere,” in Geophysik II/Geophysics II, pp. 254-287, 1957.

[https://doi.org/10.1007/978-3-642-45881-1_3]

-

U L. Lu, Q. Xiong, B. Xu, and D. Chu, “Mixdehazenet: Mix structure block for image dehazing network,” Proc. of the 2024 International Joint Conference on Neural Networks (IJCNN), pp. 1-10, IEEE, June 2024.

[https://doi.org/10.1109/IJCNN60899.2024.10651326]

- Ultralytics, YOLOv8 GitHub repository, https://github.com/ultralytics/ultralytics, .

- F. Yu, H. Chen, X. Wang, W. Xian, Y. Chen, F. Liu, V. Madhavan, and T. Darrell, “BDD100K: A diverse driving dataset for heterogeneous multitask learning,” Proc. of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), pp. 2636-2645, Jun. 2020.

-

B. Li, W. Ren, D. Fu, D. Tao, D. Feng, W. Zeng, and Z. Wang, “Benchmarking single-image dehazing and beyond,” IEEE Transactions on Image Processing, vol. 28, no. 1, pp. 492-505, 2018.

[https://doi.org/10.1109/TIP.2018.2867951]

- Y. Cui, Y. Tao, Z. Bing, W. Ren, X. Gao, X. Cao, and A. Knoll, “Selective frequency network for image restoration,” Proc. of the Eleventh International Conference on Learning Representations (ICLR), 2023.

- S. M. Hong, Y. J. Kim, and S. Y. Kim, “Enhancing detection performance in actual foggy environments through depth estimation-based haze removal techniques,” Proc. of the Korean Institute of Control, Robotics and Systems Conference, 2024.

-

C. Sakaridis, D. Dai, S. Hecker, and L. Van Gool, “Model adaptation with synthetic and real data for semantic dense foggy scene understanding,” Proc. of the European Conference on Computer Vision (ECCV), pp. 687-704, 2018.

[https://doi.org/10.1007/978-3-030-01261-8_42]

- M. A. Kenk, and M. Hassaballah, “DAWN: Vehicle detection in adverse weather nature dataset,” arXiv preprint arXiv:2008.05402, , 2020.

2024년 국립군산대학교 기계공학부 졸업. 2024년~현재 국립군산대학교 기계공학과 석사과정 재학 중. 관심분야는 항법 시스템, 자율주행, 딥러닝, 목표물 검출 및 식별, 동시적 위치추정 및 지도작성.

2019년~현재 국립군산대학교 기계공학과 학사과정 재학 중. 관심분야는 항법 시스템, 자율주행, 경로 계획, 경로 추종 제어.

1999년 국민대학교 전자공학과 졸업. 2015년 서울대학교 공과대학 기계항공학부 대학원 졸업(공학석사). 2019년 동 대학원 졸업(공학박사). 2019년~2020년 세종대학교 지능기전공학부 박사후 연구원. 2020년~2023년 국립군산대학교 기계공학부 조교수. 2023년~현재 국립군산대학교 기계공학부 부교수. 관심분야는 항법 시스템, 필터링, 자율주행, 딥러닝, 다중 센서 융합, 다중 목표물 추적, 목표물 검출 및 식별.