CLAHE 를 이용한 딥러닝 기반 밝기 적응형 객체 분할

Copyright© ICROS 2025

Abstract

This study proposes a brightness-adaptive instance segmentation algorithm utilizing CLAHE (Contrast Limited Adaptive Histogram Equalization) to address domain shift issues that degrade object segmentation performance in indoor environments. The proposed algorithm employs a BAE (Brightness Adaptive Equalizer) module based on CLAHE in the YUV color space to adjust contrast and enhance input data quality. The algorithm enhances recognition accuracy by integrating the YOLOv8 object recognition model with an exception-handling structure. Furthermore, the algorithm’s effectiveness is validated by comparing brightness distributions between the training and test datasets. The performance is quantitatively evaluated using metrics such as precision, recall, and mean average precision. Experimental results demonstrate that the proposed method mitigates performance degradation from domain shifts and enhances accuracy in different lighting conditions. This work enhances object recognition and segmentation in challenging lighting scenarios.

Keywords:

CLAHE, deep learning, instance segmentation, RGB-DI. 서론

학습모델의 일반화 성능을 확보하는 것은 머신러닝의 근본적인 문제 중 하나이다. 이는 학습된 모델이 학습 데이터셋에 포함되지 않은 새로운 이미지의 데이터에 대해서도 높은 인식성능을 유지하며 작동할 수 있도록 하는 방법을 의미한다. 학습모델은 제한된 수의 샘플을 학습하고 이를 통해 학습하지 않은 모든 잠재적인 샘플에 대해 추론한다[1]. 인공신경망을 사용한 딥러닝 모델에서 이 문제가 특히 두드러지는 데, 대형 딥러닝 모델에서는 학습 데이터의 특정 피처에 쉽게 과적합되어 모델의 일반화 성능을 저하시키게 된다[2]. 학습모델이 학습한 데이터셋과 실험 데이터셋의 분포의 차이가 존재하여 이러한 문제가 발생하게 되는데, 이를 domain shift 라고 한다.

물체를 인식하는 컴퓨터비전 연구에서는 촬영된 이미지의 밝기, 시야각, 이미지 센서의 노이즈 등 다양한 요인들에 의해 결정된 이미지의 품질에 의해 이러한 domain shift 문제가 발생하게 된다. 컴퓨터비전 분야에서 이러한 domain shift 문제를 해결하기 위해 이미지의 품질을 향상시켜 학습 모델에 적용하는 많은 기법들에 대한 연구가 이뤄지고 있다[3].

이미지의 품질을 향상시키는 전통적인 방법은 색상공간의 정보를 활용하는 방법과 히스토그램 평활화를 이용한 방법이다. 빛의 3원색인 RGB 색상공간의 0~255 범위의 이미지 정보를 HSV, YUV 등의 색상공간으로 변환하여 각 요소의 정보를 처리하는 연구가 진행되어 왔다[4-6]. 또 다른 방법으로는 히스토그램 평활화(histogram equalization)가 있다. 히스토그램 평활화는 이미지의 밝기 분포를 히스토그램으로 표현한 후 밝기 값의 분포를 균일하게 만들어주는 평활화 작업을 통해 저조도 이미지의 명암 대비를 향상시킬 수 있다. 하지만 히스토그램 평활화는 이미지 전체에 대해 하나의 분포만 사용하기 때문에 특정 이미지에서는 밝은 영역이 더 밝아져 원본 이미지 대비 이미지 품질이 저하되는 문제가 있다. 따라서 이러한 문제를 개선하기 위해 적응 히스토그램 평활화(adaptive histogram equalization)라는 방법이 제안되었다[7]. 기존 히스토그램 평활화는 이미지 전체에 하나의 분포만을 사용하기 때문에 이미지의 세부적인 명암정보가 손실되는 문제가 발생한다. 적응 히스토그램 평활화는 이미지를 여러 개의 그리드로 분할하여 그리드별로 히스토그램 평활화를 적용하여 기존 방법 대비 이미지의 세부적인 명암정보를 보존한 영상 품질을 향상시킬 수 있다. 하지만 적응 히스토그램 평활화에서는 과도한 명암대비 증폭 및 노이즈가 증가하여 이미지의 품질이 저하되는 문제가 발생할 수 있다[8-9]. 이러한 문제를 해결하기 위해 그리드에 대해 평활화를 수행할 때, 대비 제한을 부여하여 일정 값 이상은 재 분포하는 대비 제한 적응 히스토그램 평활화(CLAHE, Contrast Limited Adaptive Histogram Equalization)를 통해 해결할 수 있다[10].

이러한 이미지 품질향상 기법을 딥러닝과 접목한 기법들에 대한 연구들도 활발하게 진행되고 있다. [11]은 야간 객체탐지 성능향상을 위해 야간의 촬영된 이미지에 히스토그램 평활화를 수행 후 YOLOv8을 학습하여 학습모델의 야간 저조도 이미지의 객체탐지 성능을 향상시켰다. [12]는 YUV 색상공간을 기반으로 residual network와 결합하여 학습하는 모델인 YUVDR을 제안하여 계산효율성 및 이미지 디블러링 성능을 향상시켰다.

본 논문에서는 실내 환경에서 문고리를 인식하는 작업에서 domain shift 문제에 의해 인식 성능이 저하되는 현상을 극복하기 위해 YUV 색상공간에서 CLAHE를 활용한 BAE (Brightness Adaptive Equalizer) 모듈과 예외처리 구조[13]를 통한 딥러닝 기반 밝기 적응형 객체 분할 방법을 제안하고 평가지표를 통해 알고리즘의 인식성능이 향상되었음을 검증하였다. 그리고 알고리즘의 단계 별로 밝기 분포를 확인하여 해당 밝기분포의 변화에 따른 유사도를 비교하였다. 이를 통해 BAE module의 인식성능 향상에 대해 학습 데이터셋과 테스트 데이터셋의 밝기에 대한 차이가 감소됨을 확인하였다.

본 논문에서는 CLAHE를 활용한 밝기 적응형 객체 분할 알고리즘과 예외처리 구조를 통해 domain shift 문제를 해결하는 방법을 제안하고 알고리즘의 성능 평가를 통해 알고리즘의 유효성을 검증한다. 2장에서는 제안하는 전체적인 알고리즘과 알고리즘에 사용되는 학습 모델 및 데이터셋에 대해 설명한다. 3장은 해당 알고리즘의 유효성을 검증하기 위해 precision, recall, Map (Mean Average Precision) 와 같은 성능 지표를 통해 모델의 성능이 베이스 모델과 명암대비를 향상시키기 위해 사용되는 방법 중 하나인 히스토그램 평활화 기법 대비 향상되었음을 검증하였다. 학습 데이터 셋과 테스트 데이터셋의 밝기 분포를 비교하여 밝기 도메인에서의 차이를 감소시켰음을 확인하였다. 4장에서는 본 연구의 결론과 한계점에 대해 다루며 향후 연구방향을 제시하였다.

II. 딥러닝 기반 밝기 적응형 객체 분할

1. YOLOv8 객체 인식 모델

본 논문에서는 사전 학습된 YOLOv8-seg 모델을 활용하여 2D 이미지상의 객체를 인식한다. YOLOv8 [14]은 CSPNet 백본과 anchor-free 방식을 사용하여 경량화 및 네트워크 효율성 확보하였다. 그리고 decoupled head를 사용하여 classification head와 regression head을 분리하여 각 작업에 맞는 독립적인 최적화를 통해 인식 정확도를 향상시킨 모델이다. 본 논문에서는 AdamW optimizer와 이용해서 최적화를 수행하였다. 학습을 위해 분류와 객체분할을 위한 손실함수는 BCE loss를 사용했고, 경계 상자를 검출하기 위한 손실함수는 CIOU loss를 사용하여 학습하였다.

2. 학습 데이터셋

본 논문에서 딥러닝 모델을 학습시키기 위해 2가지의 데이터셋을 활용하였다. 각 데이터셋을 원본 데이터셋과 BAE 데이터셋이라고 정의한다. 첫 번째 데이터셋은 서울시립대학교 부지 내의 건물들에 부착된 문고리를 Intel Realsense D435로 촬영하여 RGB-D 데이터를 취득하였다. 다양한 환경에서 데이터를 취득하기 위해 밝기, 시간, 시야각들과 같은 요소들 변화시켜가며 902개의 데이터를 취득했다. 학습 모델의 일반화 성능을 향상시키기 위해 획득한 데이터들을 회전, 좌우반전, 밝기 변화와 같은 기법을 통해 데이터를 증강하여 표 1과 같이 2706개의 데이터셋을 구성하였다.

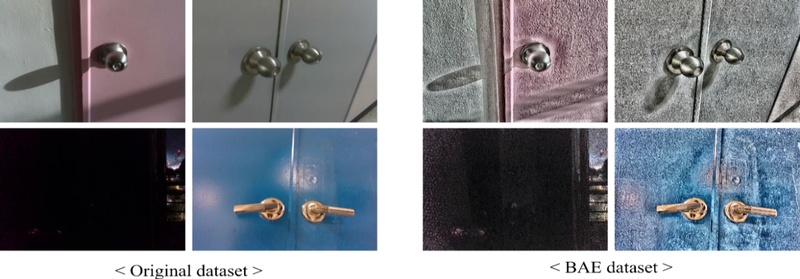

두 번째 데이터셋은 증강하기 전 원본 데이터셋에 BAE 모듈을 거친 후 나온 이미지로 구성된 데이터셋이다. 그 후 원본 데이터셋과 동일하게 증강하여 2706개의 데이터셋을 구성하였다. 해당 데이터셋은 그림 1과 같다.

3. BAE (Brightness Adaptive Equalizer) 모듈

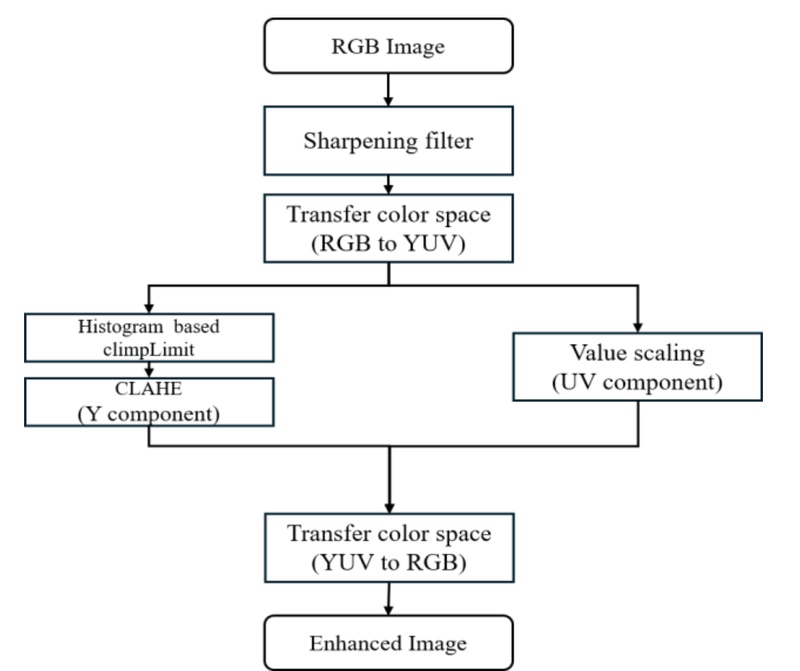

저조도 및 고조도 이미지와 같이 명암대비가 낮은 이미지는 객체의 형상과 같은 세부적인 정보가 명확히 두드러지지 않는 문제가 있다. 이러한 이미지를 개선하려면 명암대비를 조정하고 이미지의 세부 정보를 강화하는 알고리즘이 필요하다. 본 논문에서는 YUV 색상공간과 CLAHE 기법을 활용하여 BAE (Brightness Adaptive Equalizer) 모듈을 설계하여 이미지의 명암대비를 증가시켜 이미지의 세부적인 표현을 두드러지게 하여 이미지의 품질을 향상시켰다. BAE 모듈은 그림 3과 같이 동작한다. 모듈에 RGB이미지가 입력된다. 입력 이미지는 이미지의 특징을 두드러지게 하는 샤프닝 필터를 통과한 후 ITU-R BT.601 [15]에 따라 식 (1) ~ (3)과 같이 RGB 채널에서 YUV 채널로 색상공간을 변환하여 명암 대비 조정에 필요한 밝기 요소인 Y (Luminance) 채널과 색차정보인 UV (Chrominance) 채널로 나눠 독립적으로 처리할 수 있다. 입력 이미지의 명암대비를 향상시키기 위해 Y 요소에 대해서 CLAHE를 수행한다. CLAHE에서 과도한 명암 대비 증가를 방지하기 위해 적용하는 대비 제한을 입력 이미지에 맞춰서 적용하기 위해 이미지의 밝기정보로 표현한 히스토그램에서 전체 정보의 하위 3/4의 구간에 해당하는 부분을 대비 제한으로 선정하여 CLAHE를 수행해 입력 이미지의 밝기에 맞춰서 해당 알고리즘이 동작할 수 있다. 추가적으로 UV 채널의 색차정보를 증폭시키기 위해 스케일링을 수행했다. 그 후 각 채널을 다시 합쳐 RGB 이미지로 변환하여 이미지의 품질을 보정하였다.

| (1) |

| (2) |

| (3) |

4. 예외처리 구조 및 포인트 클라우드 처리

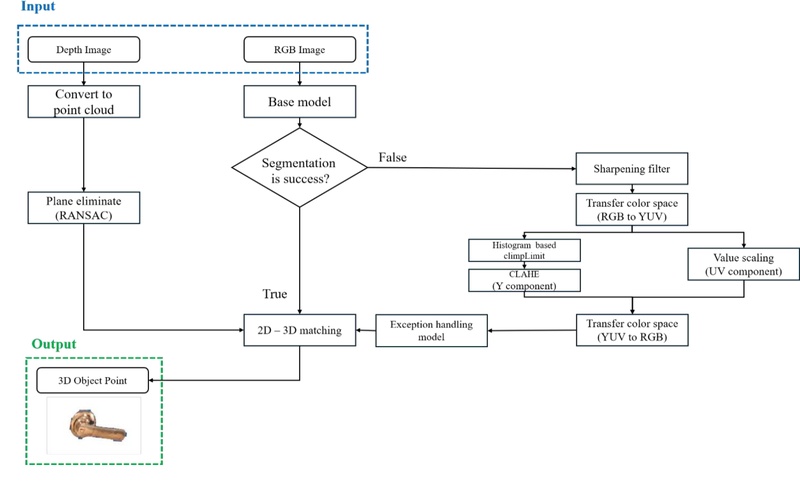

본 논문에서는 그림 2와 같이 2가지 데이터셋을 각각 학습한 2가지 모델들을 활용해 순차적으로 추론하여 문고리에 해당하는 픽셀정보를 추출한다. 각 모델의 명칭은 베이스 모델과 예외처리 모델이라고 정의하였다. 베이스 모델은 YOLO v8 객체 분할 모델에 원본 데이터셋으로 학습을 진행하였고 예외처리 모델은 동일한 모델에 BAE 데이터셋을 학습한 모델이다. 입력 이미지가 베이스 모델에서 추론을 실패하였을 경우만 동작한다. 이때 이미지는 BAE 모듈을 거쳐 품질이 보정된다. 그 후 보정된 이미지를 예외처리 모듈에 입력하여 이미지상의 픽셀정보를 최종 추출하게 된다. 이 때 베이스 모델에서 정상적으로 추론이 성공하게 된다면 예외처리 모듈의 브런치는 생략된다. BAE 모듈과 예외처리 구조를 통해 학습 데이터와 입력 데이터의 밝기 도메인에서 유사도를 증가시키는 효과를 얻을 수 있다. 본 논문에서 제안하는 방법은 베이스모델에 추가적으로 BAE 모듈을 적용하여 인식 성능을 향상시켰다.

그 후 추출된 픽셀정보를 3차원 포인트 클라우드에 매칭하여 문고리에 해당하는 포인트 클라우드를 추출한다. 그리고 문고리가 부착된 문을 평면이라고 가정하여 RANSAC(Random Sample Consensus) [16]알고리즘을 활용해 문에 해당되는 포인트 클라우드를 구할 수 있다. 이 때 RANSAC 알고리즘의 결과로 추출된 문에 해당하지 않는 이상치와 학습 모델을 통해 추출한 포인트 클라우드를 KD-tree 자료구조를 활용하여 거리 기반의 인접한 점들을 탐색하여 문에 해당하지 않는 이상치 영역에 해당하는 포인트 클라우드와 모델이 추론한 마스크에 해당하는 포인트 클라우드 간의 중복 영역을 최종적으로 출력한다.

III. 실험 및 결과

1. 알고리즘 추론 성능 평가

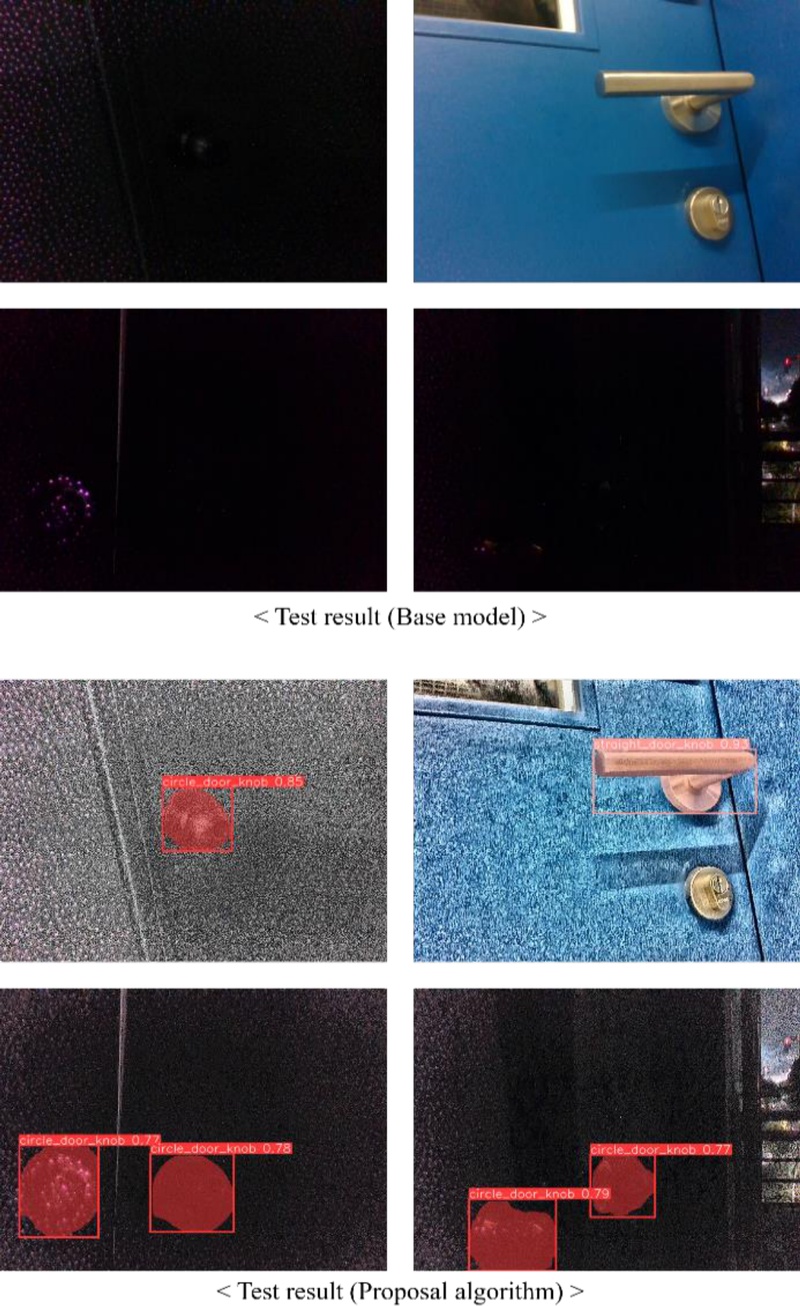

본 논문에서 제안하는 알고리즘은 다양한 환경에서 직접 취득한 문고리의 이미지 데이터를 통해 학습을 진행하였다. 학습환경은 Ubuntu 20.04 운영체제와 Intel(R) i9-13900 CPU, NVIDIA GeForce RTX 4070 GPU가 부착된 PC 환경에서 학습하였다. 총 10회 실험하여 추론시간에 대한 평균과 표준 편차를 약 2.3s, 0.04s로 달성하였다. 베이스모델과 명암대비 증폭을 위해 사용하는 기법인 히스토그램 평활화와 비교하여 제안하는 알고리즘의 성능을 평가하기 위해 식 (4) ~ (6)과 같이 precision, recall, mAP (mean Average Precision)의 평가 지표를 통해 검증하였다. 평가지표를 통해 검증한 결과는 표 2와 같다. 기존 베이스모델을 단독으로 사용할 경우와 비교하여 전반적인 객체 인식 성능이 향상된 것을 확인할 수 있다. 특히, recall에서 큰 차이를 볼 수 있는데 이는 제안하는 알고리즘이 학습한 원본 데이터셋과 조도의 차이가 큰 테스트 이미지에 대해 검출 성능이 향상했음을 알 수 있다. 고조도 및 저조도 이미지에 대한 실험결과는 그림 4와 같다.

| (4) |

| (5) |

| (6) |

2. 이미지의 밝기 분포 분석

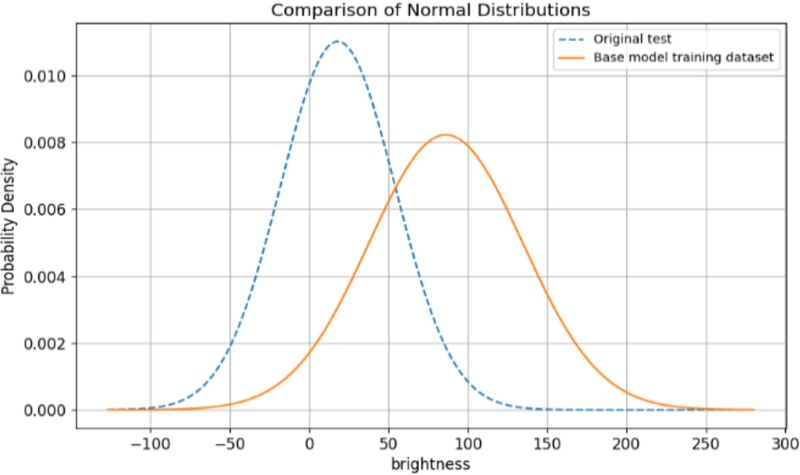

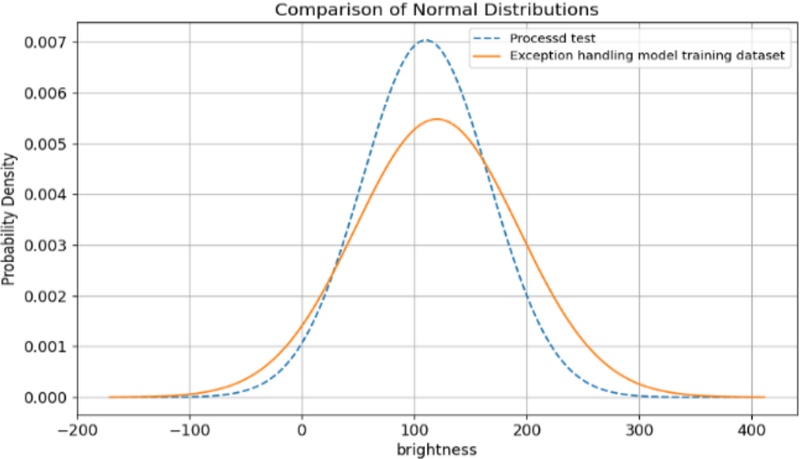

BAE 모듈과 예외처리 구조를 통해 학습 데이터와 테스트 데이터의 밝기 도메인의 차이를 줄이는 효과를 검증하기 위해 학습 데이터셋과 테스트 데이터셋의 밝기 분포를 비교하였다. 이미지의 밝기 분포는 정규분포로 가정하여 분석하였다. 그림 5, 6과 같이 베이스 모델과 예외처리 모델의 밝기 분포를 시각화하였다. 그림 5는 베이스 모델의 학습 데이터셋 분포와 테스트 데이터셋의 분포를 표현했다. 그림 6은 예외처리 모델의 학습 데이터셋과 테스트 데이터셋의 분포를 표현했다. 이를 통해 그림 5에 비해 그림 6의 분포의 유사도가 향상되었음을 정성적으로 확인할 수 있다. 이 밝기 분포의 유사도를 정량적으로 확인하기 위해 KL-divergence를 통해 구한 값을 표 3과 같이 표현하였다. 연속분포인 p, q에 대한 KL-divergence는 식 (7)과 같이 정의된다. 식 (7)에서 p(x), q(x) 는 각 분포의 확률분포를 의미하고 이 두 확률분포의 상대적인 차이를 log 스케일로 측정한다. p, q가 가우시안 분포 N(x|μ, σ) 를 따를 경우 KL-divergence는 식 (8)과 같이 정의된다[17]. 식 (8)에서 μp, μq 는 각 분포의 평균을 의미하고 σp, σq 는 분포의 표준편차를 의미한다. DKL (p ‖ q) 는 p, q 사이의 KL-divergence를 나타낸다. 이 때 분포의 차이를 표 3과 같이 구할 수 있다. 표 3을 통해 본 논문에서 제안하는 BAE모듈과 예외처리 구조를 밝기 도메인에서 분포의 차이를 감소시켰음을 확인하였다.

| (7) |

| (8) |

IV. 결론

본 연구에서는 다양한 환경적 요인에 의한 domain shift 문제에 의해 학습모델의 객체인식 성능이 저하되는 문제를 개선하는 알고리즘을 제안하였다. 제안한 알고리즘에는 2개의 데이터셋을 각각 학습한 2개의 학습모델을 활용한다. 서울시립대학교 부지 내에 있는 다양한 환경에서 문고리 데이터를 취득해 원본 데이터셋을 구축하였고, 원본 데이터셋에 본 논문에서 제안하는 BAE 모듈을 통해 처리된 BAE 데이터셋을 또 다른 학습 데이터셋으로 구축하였다. 제안하는 알고리즘에서 사용되는 첫 번째 베이스 모델은 객체 분할 모델인 YOLOv8-seg을 원본 데이터셋으로 학습하였고, 예외처리 모델은 BAE 모듈을 거친 BAE 데이터셋으로 학습을 진행하였다. 이 과정을 통해 2가지 모델은 서로 다른 밝기 도메인을 가진 데이터셋을 학습하였다. 알고리즘의 동작 순서는 RGB 이미지를 알고리즘의 입력으로 받아 베이스 모델에 입력으로 전달된다. 이때, 베이스모델의 추론이 실패할 경우 입력 이미지의 색상 공간을 RGB에서 YUV로 변환한다. 그 후 Y요소를 추출하여 이미지의 품질을 향상시키는 CLAHE 기법을 적용한다. CLAHE 기법은 이미지의 과도한 명암대비 증폭을 막기 위해 대비 제한을 설정하는 과정이 존재하는데 이때 입력 이미지의 밝기 채널에 맞게 대비 제한이 설정될 수 있도록 Y 채널을 히스토그램으로 나타내 하위 3/4 지점을 대비 제한으로 설정하여 CLAHE가 수행된다. 기존의 CLAHE 기법의 대비 제한은 하이퍼 파라미터인 점에 비해 제안하는 알고리즘은 입력되는 이미지별로 맞는 대비 제한 값을 부여할 수 있다. 그 후 색차 정보를 향상시키기 위해 UV 채널에 대해 스케일링을 수행하고 다시 RGB 이미지로 변환되어 예외처리 모델에 입력 정보로 전달된다. 이 과정을 통해 예외처리 모델의 입력 데이터와 학습 데이터는 베이스 모델을 단일로 사용하였을 경우에 비해 밝기 도메인이 유사한 관계를 가지게 된다. 문이 평면이라는 점을 가정하여, 깊이 이미지를 포인트 클라우드로 변환한 후 RANSAC 알고리즘을 이용해 문에 해당하는 평면을 추출한다. 이때 RANSAC 알고리즘의 결과로 이상치로 추정된 포인트 클라우드와 학습모델이 검출한 마스크에 해당하는 포인트 클라우드의 중복영역을 KD-tree 구조를 활용하여 문고리에 해당하는 포인트 클라우드만 출력한다.

본 논문에서 제안하는 알고리즘은 2개의 학습모델을 순차적으로 사용하기 때문에 단일 모델을 사용하는 경우에 비해 예외처리 모델에 대한 연산 시간이 추가로 소요된다. 그리고 3차원 객체를 추정하는 과정에서 이미지 정보에 대해서만 학습하여 활용하고 있기 때문에 취득한 이미지 정보의 노이즈에 대해 보정이 불가능하다. 이러한 한계에 기반하여 추후 연구는 RGB 이미지 정보와 깊이 이미지를 학습의 입력 정보로 활용하는 multi-modal분야를 접목한 연구와 모델의 연산시간 감소를 위해 하나의 학습 파이프라인으로 구성된 End-to-End 방식의 학습모델에 대한 연구로의 확장이 필요하다. 추가적으로 동일한 데이터셋에서 domain shift 문제를 해결하기 위한 다른 방법과의 성능 비교를 통한 검증이 요구된다.

Acknowledgments

본 연구는 2023년도 산업통상자원부 및 산업기술평가관리원(KEIT) 연구비(20008668) 와 산업통상자원부의 재난 및 위험작업 현장근로자의 사고 방지를 위한 안전로봇 기술개발 사업(No. 20026194, 소방용 4족 보행 로봇 기반 인명탐지·화재진압 솔루션 개발 및 소방 로봇·센서 실증)의 지원을 받았습니다.

REFERENCES

-

W. M. Kouw and M. Loog, “A review of domain adaptation without target labels,” IEEE Transactions on Pattern Analysis and Machine Intelligence, vol. 43, no. 3, pp.766-785, Mar. 2021

[https://doi.org/10.1109/TPAMI.2019.2945942]

-

K. Stacke, G. Eilertsen, J. Unger, and C. Lundström, “Measuring domain shift for deep learning in histopathology,” IEEE Journal of Biomedical and Health Informatics, vol. 25, no. 2, pp. 325-336, Feb. 2021.

[https://doi.org/10.1109/JBHI.2020.3032060]

-

Y. Chen, M. Huang, H. Liu, K. Shao, and J. Zhang, “Real-world low-light image enhancement via domain-gap aware framework and reverse domain-distance guided strategy,” Frontiers in Physics, vol. 11, Mar. 2023

[https://doi.org/10.3389/fphy.2023.1147031]

-

L. Chenlei, D. Zhang, S. Geng, Z. Wu, and H. Huang, “Color transfer for images: Asurvey,” ACM Transactions on Multimedia Computing, Communications and Applications, vol. 20, no. 8, pp. 1-29. Jul. 2024.

[https://doi.org/10.1145/3635152]

-

G. Gao, H. Lai, Y. Liu, L. Wang, and Z. Jia, “Sandstorm image enhancement based on YUV space,” Optik, vol. 226, no. 1, Jan. 2021.

[https://doi.org/10.1016/j.ijleo.2020.165659]

- Y. Kim, S. Hong, S. Back, S. Kim, E. Park, and S. Kim, “Performance analysis of lane detection using HSV color space and hough transform in the harsh environment,” Proc. Institute of Control, Robotics and Systems, pp. 201-202, 2022.doi: https://www.dbpia.co.kr/journal/articleDetail?nodeId=NODE11480272

-

S. M. Pizer, E. P. Amburn, J. D. Austin, R. Cromartie, A. Geselowitz, T. Greer, B. H. Romeny, J. B. Zimmerman, and K. Zuiderveld, “Adaptive histogram equalization and its variations,” Computer Vision Graphics and Image Processing vol. 39, no. 3, pp. 355-368, Sep. 1987.

[https://doi.org/10.1016/S0734-189X(87)80186-X]

-

S. M. Pizer, E. P. Amburn, J. D. Austin, R. Cromartie, A. Geselowitz, T. Greer, B.M. Haar Romeny, J.B. Zimmerman and K. Zuiderveld, “Adaptive histogram equalization and its variations,” Computer Vision, Graphics and Image Processing, vol. 39, no. 3, pp. 355–368, Sep. 1987.

[https://doi.org/10.1016/S0734-189X(87)80186-X]

-

C. R. Nithyananda, A. C. Ramachandra and Preethi, “Review on histogram equalization based image enhancement techniques,” 2016 International Conference on Electrical, Electronics, and Optimization Techniques (ICEEOT), pp. 2512-2517, Mar. 2016.

[https://doi.org/10.1109/ICEEOT.2016.7755145]

-

K. Zuiderveld, “Contrast limited adaptive histogram equalization,” Graphics Gems, pp. 474–485, Aug. 1994.doi: https://dl.acm.org/doi/abs/10.5555/180895.180940

[https://doi.org/10.1016/B978-0-12-336156-1.50061-6]

-

G. Bak and Y. Ha, “Performance evaluation of deep learning-based nighttime object detection using histogram equalization,” Journal of the Korea Academia-Industrial cooperation Society, vol. 25, no. 2, pp. 52-61, 2024.

[https://doi.org/10.5762/KAIS.2024.25.2.52]

-

M. Zhang, H. Wang, and Y. Guo, “YUVDR: A residual network for image deblurring in YUV color space,” Multimedia Tools and Applications, vol. 83, pp. 19541-19561, Jul. 2024.

[https://doi.org/10.1007/s11042-023-16284-y]

- D. Lee, Y. Kim, and M. J. Hwang,” Brightness adaptive image segmentation using luminance histogram equalizing in YUV color space,” International Conference on Control, Automation and Systems, 2024.doi: https://sigongji.2024.iccas.org/Proceedings/HomeIF.asp

- G. Jocher, A. Chaurasia, and J. Qiu, “Ultralytics yolov8,” 2023. [Online]. Available: https://github.com/ultralytics/ultralytics

- ITU-R, Recommendation ITU-R BT.601-7 - Studio encoding parameters of digital television for standard 4:3 and wide-screen 16:9 aspect ratios, 2011.

-

M. A. Ficher and R. C. Bolles, “Randoms sample consensus: A paradigm for model fitting with applications to image analysis and automated cartography,” Communications of the Association for Computing Machinery, vol. 24, no. 6, pp. 381-395, Jun. 1981.

[https://doi.org/10.1145/358669.358692]

- K. P. Murphy, Probabilistic Machine Learning: An Introduction, MIT press, 2022.

2023년 한국공학대학교 기계설계공학과 졸업. 2023년~현재 서울시립대학교 대학원 기계정보공학과 석사과정 재학 중. 관심분야는 딥러닝, 로봇 비전.

2024년 서울시립대학교 기계정보공학과 졸업. 2024년~현재 서울시립대학교 대학원 기계정보공학과 석사과정 재학 중. 관심분야는 딥러닝, 강화학습 로봇 비전.

2001년 한국과학기술원 기계공학과(공학사). 2003년 한국과학기술원 기계공학과(공학석사). 2007년 한국과학기술원 기계공학과(공학박사). 2008년~2009년 Case Western Reserve University Research Associate. 2010년~2013년 삼성전자 생산기술연구소 책임. 2013년~2015년 한라대학교 기계자동차공학부 조교수. 2015년~2021년 한국교통대학교 기계공학전공 조교수/부교수. 2021년~2024년 서울시립대학교 기계정보공학과 부교수. 2024년~현재 서울시립대학교 기계정보공학과 교수. 관심분야는 로봇 및 모션 제어, 매니퓰레이션, 자율주행, 로봇 비전.