3D 지도 개선을 위한 차량 분할 및 선형 보간법 기반 지면 가림 영역 재구성

Copyright© ICROS 2025

Abstract

Simultaneous localization and mapping (SLAM) is crucial in robotics and autonomous navigation. In real-world environments such as parking lots, parked vehicles often appear in maps created through SLAM. However, these vehicles are dynamic objects that may disappear over time, making them unsuitable for map-based localization and navigation. Therefore, the SLAM-based map creation process typically removes them. However, this removal results in an occlusion area on the ground where vehicles were previously located. Thus, we propose a ground occlusion reconstruction method using linear interpolation. First, 3D semantic segmentation is employed to segment the vehicle point cloud. Object segmentation is then performed to identify individual vehicles, and their coordinates are estimated using an L-shape fitting method. The estimated vehicle coordinates transform the corresponding vehicle point cloud, allowing for accurate occlusion area determination. Finally, the point cloud inside the vehicle boundary on the ground is generated using linear interpolation. Experiments conducted in an underground parking lot with numerous parked vehicles demonstrate that the proposed method generates more accurate maps.

Keywords:

3D LiDAR, static map, vehicle segmentation, l-shape fitting, occlusion reconstructionI. 서론

동시적 위치 추정과 지도 작성(SLAM)은 로봇에 장착된 센서를 이용하여 로봇의 위치를 추정하며 지도 작성하는 기술이며 최근 로보틱스와 자율 주행 분야에서 많은 관심을 받고 있다. SLAM 기술은 크게 사용하는 센서에 따라 구분할 수 있으며, 대표적으로 카메라를 활용하는 Visual SLAM [1-3]과 라이다(LiDAR)센서를 활용하는 LiDAR SLAM [4-8]이 있다. 또한, 다양한 센서를 융합하여 로봇 위치 추정 정확도를 향상시키는 방법이 연구되고 있다[9-10]. 다양한 SLAM 방법 중 본 논문은 LiDAR SLAM으로 생성된 지도에 초점을 두고 있다. LiDAR SLAM은 높은 정확도와 dense한 포인트 클라우드 지도를 얻을 수 있다는 특징이 있다. 이러한 특성 덕분에 LiDAR로 생성된 지도를 활용하여 로봇의 위치를 추정[11-12]하는 기술도 많은 관심을 받고 있다.

하지만 LiDAR SLAM을 통해 생성된 지도에는 지도를 활용하는 과정에서 없어지거나 불필요한 객체가 포함된다. 예를 들어 주차장에서 SLAM을 통해 지도를 생성할 경우, 지도에는 주차되어 있는 차량이 남게 될 것이다. 이러한 주차된 차량이 지도에 많이 남아있게 되면 지도를 활용한 작업을 수행할 때 문제가 될 수 있다. 지도 기반의 path planning [13]과 같은 작업을 수행할 때 장애물로 인식되는 장소들이 많이 존재하여 효율적인 경로를 생성할 수 없을 것이다. 또한 실제 환경에서 지도를 사용할 때 지도와 현재 상태의 차이를 검출하여 지도를 관리하는 기술[14-15]이 필요하다. 하지만 지도에 남아있는 주차된 차량과 같은 물체는 계속 변화하는 물체이다. 지도를 활용할 때마다 변화하는 물체와 지도와의 차이를 검출하고 업데이트하는 것은 비효율적이다.

본 논문에서는 SLAM을 통해 지도를 생성함과 동시에 주차된 차량을 지도에서 제거하고자 한다. 이때, 단순히 주차된 차량을 지도에서 제거하면 해당 차량에 의해 가려지면서 차량이 존재하던 지면에서 가림 영역이 발생한다. 이러한 가림 영역은 실제 환경과 지도와의 차이를 증가시켜 지도의 정확도와 활용도를 감소시킨다. 따라서 지도에서 차량을 제거하면서 차량에 의해 발생한 가림 영역에 대해 새로운 점을 생성하여 채우는 방법을 제안한다.

포인트 클라우드에서 차량을 구분하기 위해 3D semantic segmentation [16-18]을 수행한다. 구분된 차량의 포인트 클라우드가 존재하고 있는 지면 부분에서 가림 영역이 발생할 것이기 때문에 차량의 포인트 클라우드를 객체 단위로 구분한다. 객체 단위의 차량이 존재하고 있는 지면의 경계를 계산하고 차량의 좌표계를 정의한다. 각 차량 경계와 좌표계를 이용하여 선형 보간법을 통해 지면의 가림 영역을 채우는 점을 생성한다. 생성된 점을 지도에 포함시켜 가림 영역이 재구성된 지도를 얻는다. 실혐 결과, 제안한 방법을 통해 재구성한 지도가 기존의 방법으로 생성한 지도보다 더 정확하다는 것을 보였다.

II. 본론

1. Overview

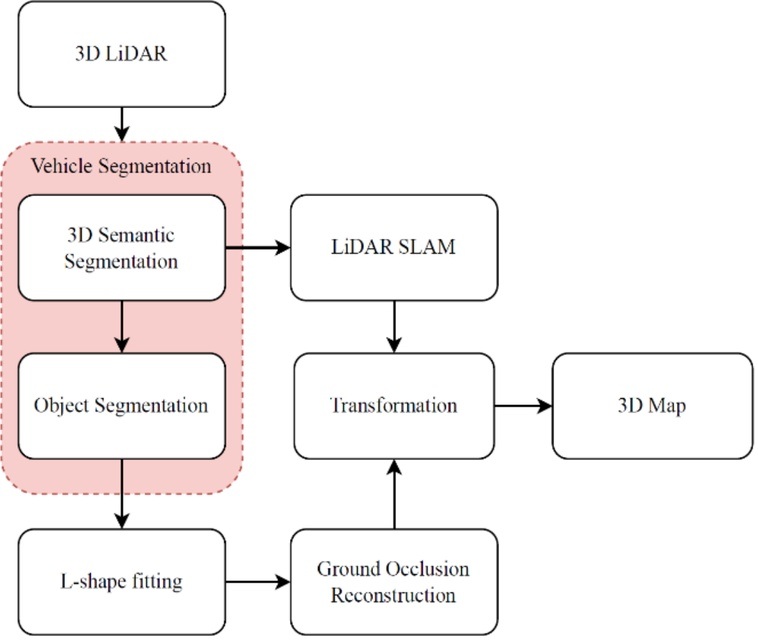

그림 1은 본 논문에서 제안하는 지면 가림 영역 재구성 방법의 프레임워크이다. 3D LiDAR에서 얻은 포인트 클라우드에서 차량을 구분하고 구분된 차량의 경계를 찾아 해당 부분의 지면을 새로운 점으로 채우는 과정을 나타내고 있다. 또한 지면 가림 영역 재구성을 위한 과정과 동시에 SLAM도 수행하고 추정된 로봇의 위치 추정 결과를 이용하여 최종적으로 지도를 생성한다.

1.1절에서 포인트 클라우드에서 차량을 검출하는 방법에 대해 설명한다. 1.2절에서 차량이 존재하고 있는 지면을 정확히 추정하기 위한 방법을 설명한다. 마지막으로 1.3절에서 지면의 가림 영역에 대해 선형보간법을 사용하여 채우는 방법을 설명한다.

포인트 클라우드에서 지도에 포함시킬 점과 제거할 점을 구분해야 한다. 본 논문에서는 차량에 해당하는 포인트를 제거하고자 한다. 따라서 포인트 클라우드를 차량, 벽 등으로 구분해준다. 이를 위해 딥러닝 기반의 3D semantic segmentation을 수행한다. 3D semantic segmentation은 포인트 클라우드를 입력으로 받아 각 점을 정해진 class 중 하나로 구분해주는 딥러닝 방법이다. LiDAR에서 얻은 포인트 클라우드를 차량, 지면, 벽, 천장 등으로 구분한다. 구분된 포인트 클라우드 중 차량에 해당하는 포인트 클라우드를 지도에서 제거하는 점들로 고려한다.

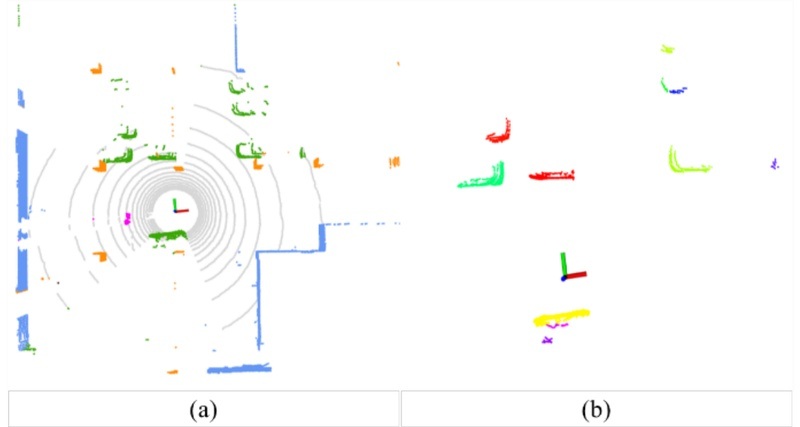

이전에 언급했듯이 차량에 해당하는 포인트 클라우드를 지도에서 제거하면 해당 포인트가 존재하던 지면에서 가림 영역이 발생한다. 발생한 가림 영역은 지도의 정확도를 감소시키며, 지도를 활용한 다른 작업을 수행할 때에도 지도의 활용도를 감소시킨다. 따라서 차량이 제거된 부분의 가림 영역에서 새로운 점을 생성하고자 한다. 정확한 가림 영역을 검출하기 위해 차량에 해당하는 포인트 클라우드에서 각각의 차량을 구분한다. 각 차량을 구분하여, 해당 포인트 클라우드가 존재하고 있는 지면을 새로운 점을 채울 영역으로 고려한다. 포인트 클라우드를 객체 단위로 구분해주기 위해 [19]에서 제안된 object segmentation을 사용하여 각 차량을 구분해준다. [19]의 object segmentation은 지면이 제거된 포인트 클라우드를 Spherical projection하여 인접한 점을 찾는 과정이 효과적으로 수행되도록 한다. Projection 후에 포인트 클라우드를 graph 로 표현하고 업데이트하며 객체를 구분하는 방법이다. [19]에서 제안된 object segmentation방법은 빠르고 정확하게 포인트 클라우드를 객채로 구분할 수 있어 사용하였다. 본 논문에서는 3D semantic segmentation 결과로 차량으로 구분된 포인트 클라우드를 입력으로 하여 차량을 객체 단위로 구분해준다. 그림2(a)는 3D semantic segmentation 결과를 보여준다. 포인트 클라우드가 차량, 벽, 지면, 기둥 등으로 구분된 결과를 볼 수 있다. 이 중 초록색으로 표현된 포인트가 차량으로 구분된 포인트 클라우드이다. (b)는 object segmentation의 결과이다. 같은 색으로 표현된 포인트 클라우드는 같은 객체로 구분된 것이다.

다음으로 차량에 의해 가려지면서 지면에서 발생한 가림 영역을 찾아야 한다. 하지만 그림 3과 같이 LiDAR를 통해 얻은 차량의 포인트 클라우드는 한쪽 측면의 정보를 얻게 된다. 따라서 차량에 해당하는 포인트 클라우드가 존재하는 지면 보다 실제 차량이 차지하고 있는 지면이 더 넓을 것이다. 이를 추정하기 위해 차량의 정확한 경계를 찾아주어야 한다.

LiDAR로 얻은 차량의 포인트 클라우드는 L모양을 이루고 있고, L모양의 포인트 클라우드의 경계를 찾는 방법으로 L-shape fitting을 사용한다. L-shape fitting은 L모양을 이루고 있는 포인트 클라우드가 가장 잘 맞는 사각형을 찾는 최적화 방법이다. L-shape fitting을 수식으로 표현하면 다음과 같다:

| (1) |

차량에 해당하는 포인트 클라우드 V를 두 개의 포인트 클라우드(P,Q)로 분할하고 두 개의 수직 직선을 나타내는 파라미터(θ,c1,c2)를 찾아 squared error를 최소화한다.

식 (1)번 최적화 수식을 실시간으로 해결하는 것은 어렵기 때문에, [20]에서 대략적으로 가장 잘 맞는 사각형을 찾는 search-based algorithm을 제안하였다. 사각형이 이룰 수 있는 모든 방향을 검사하여 error값이 가장 작은 방향을 찾는 것이다. [20]에서는 3가지 기준을 사용하여 L-shape fitting을 수행하고 결과를 비교하였다. 본 논문에서는 [20]에서 제안한 기준 중 variance criterion을 이용하여 L-shape fitting을 수행하였다.

L-shape fitting의 결과로 얻은 θ는 차량 포인트 클라우드에 잘 맞는 직선의 방향을 나타낸다. 따라서 해당 방향의 직선과 수직하는 직선을 각각 차량 좌표계의 x축과 y축으로 사용하고 차챵 포인트 클라우드의 중심점(cx,cy)을 원점으로 하는 차량의 좌표계를 정의한다. 정의된 각 차량의 좌표계는 다음 과정인 빈공간을 채우는 과정에서 사용한다. 현재 LiDAR좌표계에서 각 차량의 좌표계로의 변환행렬 는 식 (2)와 같다.:

| (2) |

변환행렬 를 이용하여 차량 포인트 클라우드를 차량의 좌표계로 변환한다. 각 포인트는 이고, pL 은 현재 LiDAR 좌표계에서의 포인트를 나타내고 pV 은 각 차량 좌표계에서의 포인트를 의미한다. 따라서 변환 행렬 을 이용하여 현재 LiDAR 좌표계의 포인트를 식 (3)과 같이 각 차량 좌표계로 변환해준다.

| (3) |

변환된 차량 포인트 클라우드의 최댓값(xmax, ymax)과 최솟값(xmin, ymin)을 계산한다. 최댓값과 최솟값을 이용하여 선형 보건법으로 생성할 점의 위치를 계산한다. 선형 보간법을 이용한 차량의 좌표계에서 경계 내에 생성되는 점의 수식은 다음과 같다:

| (4) |

위 수식에서 h 는 지면으로 구분된 포인트 클라우드의 z값의 평균값이다. 을 만족하며 τ 만큼 일정하게 키워가며 생성하는 점의 위치를 계산한다. 본 논문에서는 τ = 0.05 를 사용하여 실험하였다. 최종적으로 식 (4)를 통해 생성된 점은 각 차량의 좌표계에서 계산되었기 때문에, 이를 현재 LiDAR 좌표계로 변환 후 LiDAR SLAM [5]의 로봇의 위치 추정 결과를 이용하여 세계 좌표계로의 변환행렬 을 적용하여 지도에 포함시킨다.

| (5) |

III. 실험 결과

1.실험 환경

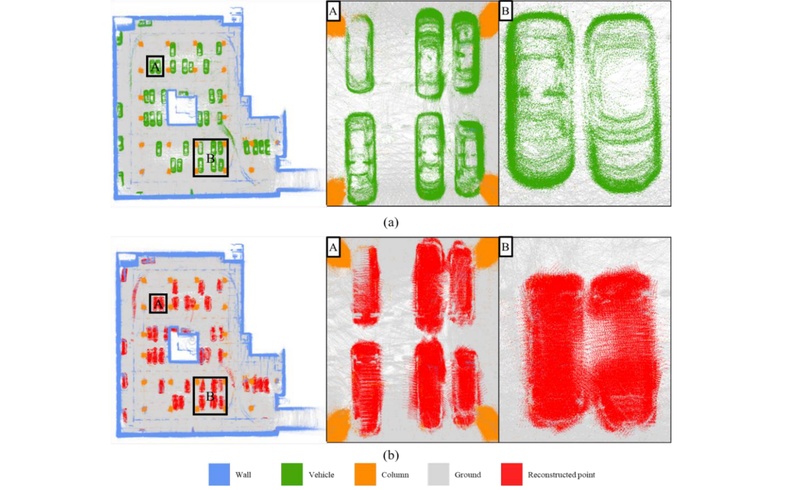

그림 4는 전북대학교(JBNU) 중앙도서관 지하주차장에서 Ouster OS1-32 LiDAR센서를 이용하여 데이터를 취득하고 [6] 알고리즘을 통해 생성한 지도이다. 해당 환경에서 차량이 많이 존재하는 데이터를 취득하여 제안한 방법을 사용하여 지도에서 차량을 구분하여 제거하고 선형 보간법을 통해 가림 영역에서 새로운 점을 생성하여 결과를 비교하였다.

포인트 클라우드에서 차량을 구분하기 위해 사용한 3D semantic segmentation 모델은 추론 시간이 빠른 [16] 모델을 사용하였다. 해당 모델 학습을 위해 취득한 포인트 클라우드를 차량, 지면, 벽 등으로 구분하여 학습을 진행하였다. 정량적 평가를 위한 Ground Truth 지도를 생성하기 위해 주차된 차량이 거의 없는 상황에서 데이터를 취득하였고, 차량이 존재하지 않는 부분만을 비교하여 정량적 평가를 진행하였다. Ground Truth 지도는 LiDAR와 IMU 센서를 이용하여 정확한 위치 추정을 수행하는 [6] 알고리즘을 이용하여 생성한다. 정량적 평가 지표는 [21]에서 사용된 지도의 품질을 비교하는 평가 지표를 사용하였다.

2. 실험 결과

그림 5는 전북대학교 중앙도서관 지하주차장에서 실험을 진행한 결과를 보여준다. 3D semantic segmentation 결과로 얻은 class에 따라 색으로 구분하여 표현한 것이다. (a)는 LeGO-LOAM의 실행 결과로 3D semantic segmentation의 결과를 이용해 포인트를 구분하였다. (a)에서 차량에 해당하는 포인트는 차량의 위치를 표현하기 위해 남겨두었다. (b)는 제안한 방법을 통해 생성한 지도 결과이다. (a)에서 차량이 존재했던 영역의 지면에 적절한 점을 생성하여 채우고 있는 모습을 볼 수 있다.

Result in uderground Parking lot of JBNU Central Library (a) is result of LeGO-LOAM, (b) is result of proposed method.

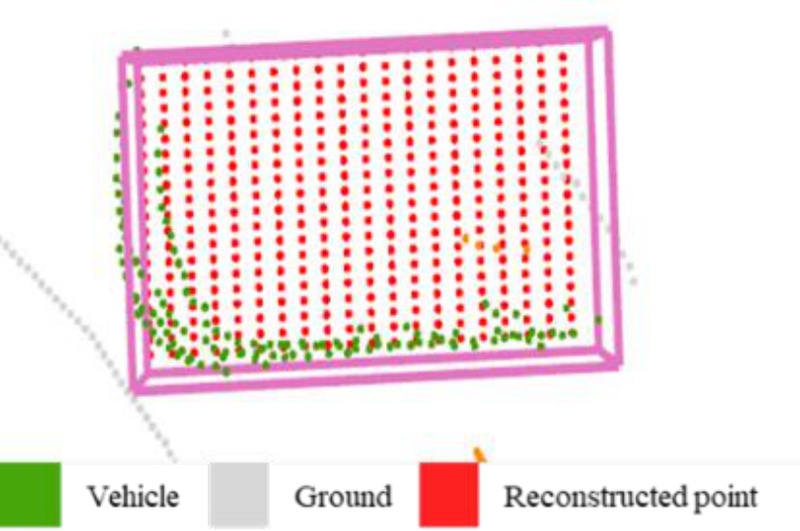

그림 6은 한 프레임에서의 차량에 의해 발생한 가림 영역에서 점을 생성한 결과를 시각화한 것이다. 각 차량의 포인트 클라우드를 L-shape fitting을 통해 차량의 경계를 찾은 것을 볼 수 있다. 또한 해당 경계 내에서 지면에 발생한 가림 영역에 대해 점을 생성하여 채우는 것을 보여준다. 본 논문에서 제안한 방법은 포인트 클라우드가 들어오는 프레임마다 실행되며 실시간으로 수행 가능하다.

표 1은 전북대학교 중앙도서관 지하주차장에서 수행한 지도 품질에 대한 정량적 평가 결과이다. LeGO-LOAM 방법은 LeGO-LOAM으로 생성된 지도에서 3D semantic segmentation을 통해 얻은 차량 정보를 이용하여 지도에서 차량을 제거한 것이다. LeGO-LOAM 방법의 경우 차량이 존재하던 지면에서 가림 영역이 발생하여 지도의 품질이 낮다. 하지만 제안한 방법을 통해 지면의 가림 영역을 선형 보간법을 이용해 재구성한 지도는 차량에 의해 발생한 가림 영역을 채울 수 있어 지도의 품질이 단순히 차량을 제거했을 때보다 높은 것을 보여준다. 또한 평가 지표인 F-score가 97.335%로 높게 나오는 것을 통해 실제 환경과 유사하게 가림 영역을 재구성하는 것을 알 수 있다.

IV. 결론

본 논문에서는 LiDAR 센서를 사용하여 SLAM을 수행함과 동시에 환경에 존재하는 차량을 검출하고, 차량에 의해 가려지면서 지면에서 발생한 가림 영역을 재구성하는 방법을 제안하였다. 3D semantic segmentation을 통해 차량을 구분하고 각 차량이 차지하고 있는 지면을 검출하기 위해 차량을 객체 단위로 구분해준다. 객체 단위로 구분된 차량 포인트 클라우드를 L-shape fitting을 이용하여 가장 잘 맞는 사각형을 찾아 각 차량의 좌표계로 사용한다. 찾은 지면의 가림 영역을 선형 보간법을 이용해 새로운 점을 생성해 재구성한다.

주차된 차량이 많이 존재하는 환경에서 실험을 진행하여 제안한 방법을 통해 차량을 제거하고 지면의 가림 영역을 재구성한 지도가 실제 환경과 유사한 지도를 생성하는 것을 보였다.

본 연구를 통해서 SLAM을 수행함과 동시에 차량과 같이 변화할 수 있는 물체를 제거하고 물체가 차지하고 있는 부분은 적절한 점으로 채운 지도를 생성하는 방법을 제시하였다. 제안한 방법을 통해 생성한 지도는 path planning, 지도 기반의 위치 추정 등에서 효율을 높이고 정확도를 증가시킬 것으로 기대된다.

Acknowledgments

상기 논문은 2024년도 ICROS-KROS 호남제주 그랜드 합동 학술대회에서 초안이 발표되었음[22].

이 논문은 정부(과학기술정보통신부)의 재원으로 정보통신기획평가원-지역지능화혁신인재양성사업의 지원(IITP-2024-RS-2024-00439292)과 정부(과학기술정보통신부)의 재원으로 한국연구재단의 지원을 받아 수행된 연구임(No RS-2024-00346415).

REFERENCES

-

T. Qin, P. Li, and S. Shen, “VINS-Mono: A robust and versatile monocular visual-inertial state estimator,” IEEE Transactions on Robotics, vol. 34, no. 4, pp. 1004–1020, 2018.

[https://doi.org/10.1109/TRO.2018.2853729]

-

C. Campos, R. Elvira, J. J. G. Rodriguez, J. M. M. Montiel, and J. D. Tardos, “ORB-SLAM3: An accurate open-source library for visual, visual-inertial, and multimap SLAM,” IEEE Transactions on Robotics, vol. 37, no. 6, pp. 1874–1890, 2021.

[https://doi.org/10.1109/TRO.2021.3075644]

-

M. Jo and H. G. Jo, “Robust visual SLAM algorithm using QR code-based visual place recognition,” Journal of Institute of Control, Robotics and Systems (in Korean), vol. 30, no.6, pp. 650–655, 2024.

[https://doi.org/10.5302/J.ICROS.204.23.8004]

-

H. Wang, C. Wang, C. L. Chen, and L. Xie, “F-LOAM : Fast LiDAR odometry and mapping,” Proc. IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS), pp. 4390–4396, 2021.

[https://doi.org/10.1109/IROS51168.2021.9636655]

-

T. Shan and B. Englot, “LeGO-LOAM: Lightweight and ground-optimized lidar odometry and mapping on variable terrain,” Proc. IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS), pp. 4758–4765, 2018.

[https://doi.org/10.1109/IROS.2018.8594299]

-

C. Bai, T. Xiao, Y. Chen, H. Wang, F. Zhang, and X. Gao, “Faster-LIO: Lightweight tightly coupled lidar-inertial odometry using parallel sparse incremental voxels,” IEEE Robotics and Automation Letters, vol. 7, no. 2, pp. 4861–4868, 2022.

[https://doi.org/10.1109/LRA.2022.3152830]

-

T. Shan, B. Englot, D. Meyers, W. Wang, C. Ratti, and D. Rus, “LIO-SAM: Tightly-coupled lidar inertial odometry via smoothing and mapping,” Proc. IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS), pp. 5135–5142, 2020.

[https://doi.org/10.1109/IROS45743.2020.9341176]

-

K. Koide, M. Yokozuka, S. Oishi, and A. Banno, “GLIM: 3D range-inertial localization and mapping with GPU-accelerated scan matching factors,” Robotics and Autonomous Systems, vol. 179, no. June, p. 104750, 2024.

[https://doi.org/10.1016/j.robot.2024.104750]

-

C. Zheng, W. Xu, Z. Zou, T. Hua, C. Yuan, D. He, B. Zhou, Z. Liu, J. Lin, F. Zhu, Y. Ren, R. Wang, F. Meng, and F. Zhang, “FAST-LIVO2: Fast, direct LiDAR-inertial-visual odometry,” IEEE Transactions on Robotics, vol. 41, pp. 326–346, 2024.

[https://doi.org/10.1109/TRO.2024.3502198]

-

M. Lee, M. Kang, D. G. Shin, J. Pyo, J. Kim, H. Song, and M. Kim, “Localization method in dense smoke scenarios using radar-thermal stereo sensor fusion,” Journal of Institute of Control, Robotics and Systems (in Korean), vol. 30, no. 8, pp. 871–878, 2024.

[https://doi.org/10.5302/J.ICROS.2024.24.0084]

-

Y. X. Feng, Z. Jiang, Y. Shi, Y. L. Feng, X. Chen, H. Zhao, and G. Zhou, “Block-map-based localization in large-scale environment,” Proc. IEEE International Conference on Robotics and Automation (ICRA), pp. 1709-1715, 2024.

[https://doi.org/10.1109/ICRA57147.2024.10610122]

-

P. Egger, P. V. K. Borges, G. Catt, A. Pfrunder, R. Siegwart, and R. Dube, “PoseMap: Lifelong, multi-environment 3D LiDAR localization,” Proc. IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS), pp. 3430–3437, 2018.

[https://doi.org/10.1109/IROS.2018.8593854]

-

S. Hrabar, “3D path planning and stereo-based obstacle avoidance for rotorcraft UAVs,” Proc, IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS), pp. 807–814, 2008.

[https://doi.org/10.1109/IROS.2008.4650775]

-

I. Jinno, Y. Sasaki, and H. Mizoguchi, “3D map update in human environment using change detection from LIDAR equipped mobile robot,” Proc. IEEE/SICE International Symposium on System Integration (SII), pp. 330–335, 2019.

[https://doi.org/10.1109/SII.2019.8700352]

-

G. Kim and A. Kim, “LT-mapper: A modular framework for LiDAR-based lifelong mapping,” Proc. IEEE International Conference on Robotics and Automation (ICRA), pp. 7995–8002, 2022.

[https://doi.org/10.1109/ICRA46639.2022.9811916]

-

A. Milioto, I. Vizzo, J. Behley, and C. Stachniss, “RangeNet ++: fast and accurate LiDAR semantic segmentation,” Proc. IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS), pp. 4213–4220, 2019.

[https://doi.org/10.1109/IROS40897.2019.8967762]

-

X. Zhu, H. Zhou, T. Wang, F. Hong, Y. Ma, W. Li, H. Li, and D. Lin, “Cylindrical and asymmetrical 3D convolution networks for LiDAR segmentation,” Proc. IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), pp. 9934–9943, 2021.

[https://doi.org/10.1109/CVPR46437.2021.00981]

-

X. Wu, L. Jiang, P.-S. Wang, Z. Liu, X. Liu, Y. Qiao, W. Ouyang, T. He, and H. Zhao, “Point transformer V3: Simpler, faster, stronger,” Proc. IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), pp. 4840–4851, 2024.

[https://doi.org/10.1109/CVPR52733.2024.00463]

-

M. Oh, E. Jung, H. Lim, W. Song, S. Hu, E. M. Lee, J. Park, J. Kim, J. Lee, and H. Myung, “TRAVEL: Traversable ground and above-ground object segmentation using graph representation of 3D LiDAR scans,” IEEE Robotics and Automation Letters, vol. 7, no. 3, pp. 7255–7262, 2022.

[https://doi.org/10.1109/LRA.2022.3182096]

-

X. Zhang, W. Xu, C. Dong, and J. M. Dolan, “Efficient L-shape fitting for vehicle detection using laser scanners,” Proc. IEEE Intelligent Vehicles Symposium (IV), no. Iv, pp. 54–59, 2017.

[https://doi.org/10.1109/IVS.2017.7995698]

-

X. Zhong, Y. Pan, J. Behley, and C. Stachniss, “SHINE-Mapping: Large-scale 3D mapping using sparse hierarchical implicit neural representations,” Proc. IEEE International Conference on Robotics and Automation (ICRA), vol. 2023-May, no. Icra, pp. 8371–8377, 2023.

[https://doi.org/10.1109/ICRA48891.2023.10160907]

- K. G. Kim and H. G. Jo, “Static 3d map generation using ground hole filling,” Proc. of 2024 ICROS-KROS Honam Jeju Regional Conference (in Korean), 2024.

2023 Mechanical Engineering from Jeonbuk National University (B.S.). 2025 Div. of Electronic Engineering from Jeonbuk National University (M.S.). 2025~Div. of Electronic Engineering from Jeonbuk National University (Ph.D. student). Field of Interests: LiDAR SLAM, Spatial AI

2012 Electrical and Electronic Engineering from Yonsei University (B.S.). 2020 Electrical and Electronic Engineering from Yonsei University (Ph.D.). 2021~Div. of Electronic Engineering from Jeonbuk National University (Assistant Professor). Field of Interests: SLAM, Robot Perception, Spatial AI, Autonomous Navigation.