교통 법규 위반 감시를 위한 카메라-라이다 융합 시스템

Copyright© ICROS 2025

Abstract

Traffic surveillance systems are essential for ensuring public safety and optimizing urban traffic flow by accurately detecting, classifying, and monitoring traffic law violations such as illegal parking and jaywalking. However, detecting such violations in dynamic urban environments poses significant challenges due to unpredictable conditions. Traditional camera-based systems excel in capturing visual details but suffer performance degradation under low light, occlusion, or complex intersection scenarios, leading to false positives and missed detections. Therefore, we propose a camera-LiDAR fusion-based traffic violation detection system. LiDAR's independence from lighting conditions complements camera capabilities, especially in night scenarios or occluded environments. Experimental results in a real-world urban environment demonstrate the system’s effectiveness in reducing false positives and missed detections compared to traditional camera-only approaches. This study underscores the potential of sensor fusion to improve traffic management systems and points out future research opportunities in challenging conditions.

Keywords:

traffic surveillance system, traffic law violations, intelligent transportation systemI. 서론

교통 법규 위반 감시 시스템은 공공 안전을 보장하고 도시 교통 흐름을 최적화하는 데 중요한 역할을 한다. 이러한 시스템은 불법 주차, 무단 U턴, 무단 횡단과 같은 교통 법규 위반을 정확히 감지하고 분류하며 모니터링해야 한다[1,2]. 이는 특히 밀집된 도시 지역에서 빈번하게 발생하는 문제다[3,4]. 이러한 교통 법규 위반은 교통 흐름을 방해할 뿐 아니라 교통 체증과 사고 위험을 높이며, 특히 교통량이 많은 지역에서 심각한 영향을 미친다[5].

그러나 실제 도시 환경에서 교통 법규 위반을 감지하는 것은 역동적이고 예측하기 어려운 조건으로 인해 여전히 도전 과제다. 기존의 교통 감시 시스템은 주로 카메라 기반 감지에 의존하여 객체를 분류하고 추적하지만[6-9], 카메라는 야간의 저조도 환경이나 물리적 장애물로 인해 성능이 크게 저하될 수 있다. 이러한 문제는 종종 오탐지와 누락을 초래하여 교통 감시 시스템의 신뢰성을 떨어뜨린다[10,11]. 점점 복잡해지는 교통 환경에서는 다양한 불리한 조건에서도 견고하게 작동할 수 있는 고급 감지 시스템이 필수적이다.

카메라 기반 시스템은 낮과 일정한 조명 환경에서 충분한 성능을 보이지만, 환경 변화와 야간, 폐색, 또는 복잡한 교차로와 같은 상황에서는 탐지 및 추적 성능이 저하되는 경향이 있다. 반면, 라이다(LiDAR, Light Detection And Ranging)는 조명에 의존하지 않는 특성 덕분에 야간에도 추가적인 객체 탐지가 가능하다[12-14].

복잡한 교차로에서는 라이다가 제공하는 3D 거리 데이터를 통해 카메라로는 감지할 수 없는 객체를 보완적으로 탐지할 수 있다. 라이다는 모든 환경에서 반드시 필요한 것은 아니지만, 야간, 폐색, 복잡한 교차로 등에서 카메라 기반 시스템의 한계를 보완하며 감지 신뢰성을 크게 향상시킨다.

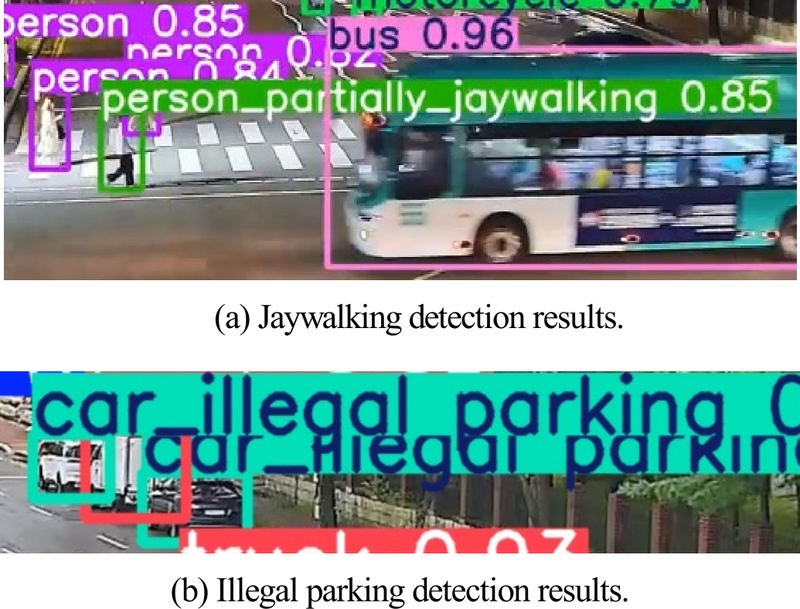

제안된 시스템은 카메라 기반 교통 법규 위반 감시 시스템에 라이다를 융합함으로써 다양한 환경에서 성능이 개선될 수 있음을 실험적으로 증명하였다. 그림 1은 복잡한 도심 환경에서 야간의 불법주정차 및 무단횡단 감지 결과를 보여준다. 특히, 라이다를 활용한 객체 탐지와 거리 정보를 기반으로 교통 법규 위반 행위를 감지하였고, 이를 카메라 기반 방식과 비교·검증하였다. 기존 연구는 주로 카메라를 중심으로 이루어졌으나, 라이다를 적용한 교통 법규 위반 감시 연구는 부족한 실정이다. 본 연구는 이러한 공백을 보완하여 카메라와 라이다의 융합이 실제 도로 환경에서 신뢰성과 성능 향상에 기여할 수 있음을 제시한다.

II. 기존 연구

카메라 기반 감시 시스템은 건설 현장과 같은 고위험 환경에서 실시간으로 잠재적 위험을 감지하고 관리자에게 위험을 경고하여 작업자의 안전을 강화하는 데 널리 사용된다[15,16]. 교통 법규 위반 감시에서 이러한 시스템은 차량 감지, 형태적 특징 분석 및 경계 상자 추적을 사용하여 실시간 객체 분류 및 비정상 동작을 감지한다[17,18]. 그러나 야간이나 악천후와 같이 조명이 좋지 않은 조건에서는 성능이 저하될 수 있다[19,20]. 이를 해결하기 위해 열 화상 카메라와 딥 러닝 기반 특징 추출을 결합하여 까다로운 환경에서 강인한 성능을 보이는 연구가 존재한다[21]. 카메라 기반은 낮이나 맑은 날씨에는 높은 정확도를 보이지만, 밤, 비, 안개, 역광, 과도한 반사광과 같은 불리한 조건에서는 오탐지 및 미탐지가 자주 발생할 수 있다[22].

Zou et al. [23]은 RGB 카메라, 적외선 카메라, 라이다를 결합한 주간-야간 장애물 탐지 시스템을 제안하여 저조도 및 폐색 조건에서 효과적인 멀티센서 융합을 보여주었다. Qiao et al. [24]는 RGB 이미지와 라이다 데이터를 통합한 3D 다중 객체 추적 프레임워크를 개발하여 적응형 복합 샘플 마이닝을 사용하여 악천후에서의 견고성을 개선했다. Wang et al. [25]는 2D 및 3D 궤적을 병합하여 추적, 정확도 향상 및 객체 손실 해결을 위한 도로변 융합 방법을 도입하였다. Zhao et al. [26]은 까다로운 조건에서 성능을 개선하기 위해 적응형 하드 샘플 마이닝을 통해 유사한 접근 방식을 제시했다. 그러나 라이다 센서는 비, 안개, 눈에 상당한 성능 저하를 겪으며, 이는 감지 신뢰성에 영향을 미친다[27].

III. 카메라-라이다 교통 법규 위반 감시 시스템

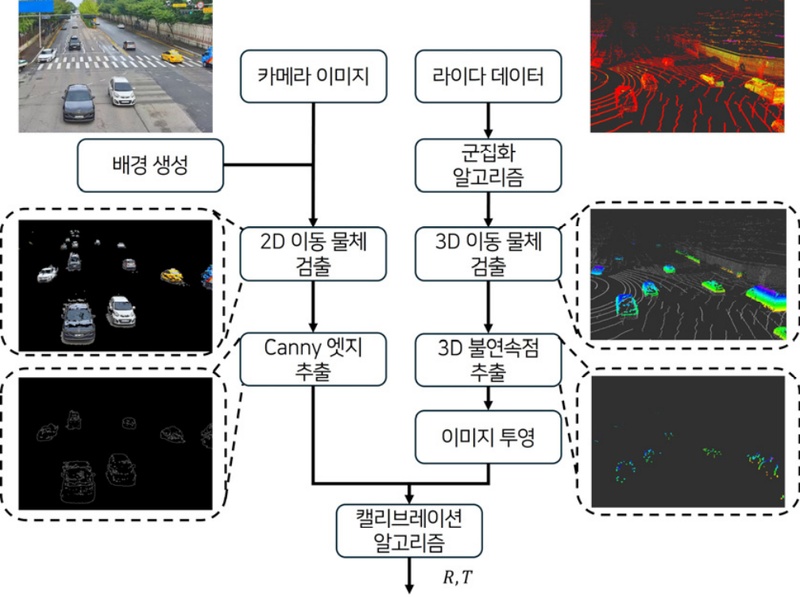

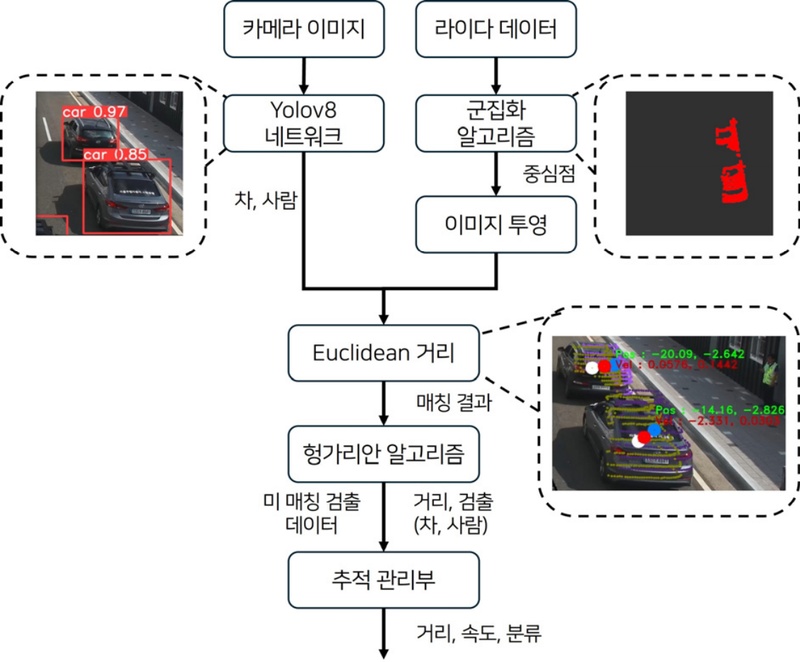

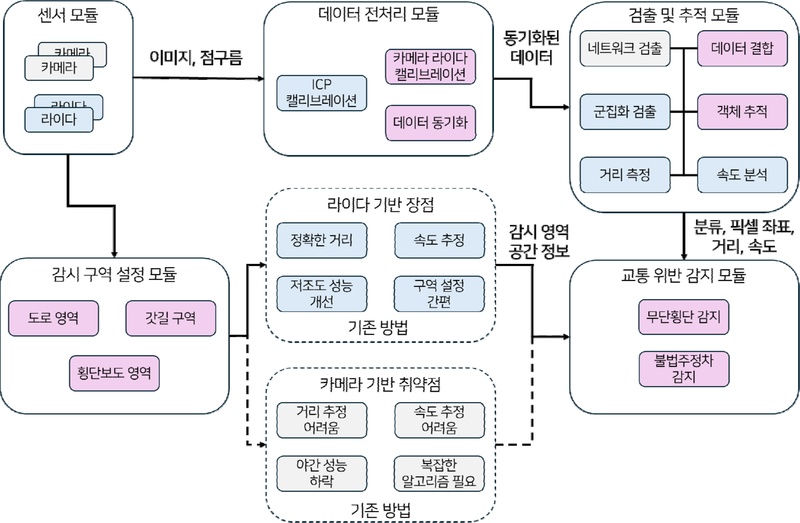

교통 법규 위반 감시 시스템은 도로 위 차량 또는 보행자의 위반 행위를 감지해야 한다. 그림 2은 카메라와 라이다를 융합하여 교통 법규 위반을 감지하도록 설계된 시스템 구조를 보여준다. 카메라 이미지는 단일 프레임으로 입력되며, 데이터 전처리 모듈에서는 카메라, 라이다에 좌표계 캘리브레이션(calibration) 및 시간 동기화를 수행한다. 검출 및 추적 모듈은 네트워크와 군집화 알고리즘을 활용하여 수행하고 검출된 이미지 좌표계와 라이다 검출결과를 이미지 좌표계로 변환하여 매칭한다. 매칭된 데이터로 검출된 데이터에 거리를 갱신하여 칼만필터로 각 매칭 데이터를 추적한다. 감지 구역 설정 모듈은 카메라 이미지 픽셀 좌표계와 라이다 데이터를 기반으로 사전에 정의한다. 사전의 정의된 교통 법규 위반 감시구역과 검출 및 추적 모듈로부터 전달된 데이터를 활용하여 최종적으로 교통 법규 위반을 감지한다.

System module structure: A traffic law violation detection system based on camera and LiDAR sensors. The main stages consist of the data pre-processing module, detection and tracking module, detection zone setting module, and traffic law violation detection module.

1. 데이터 전처리 모듈

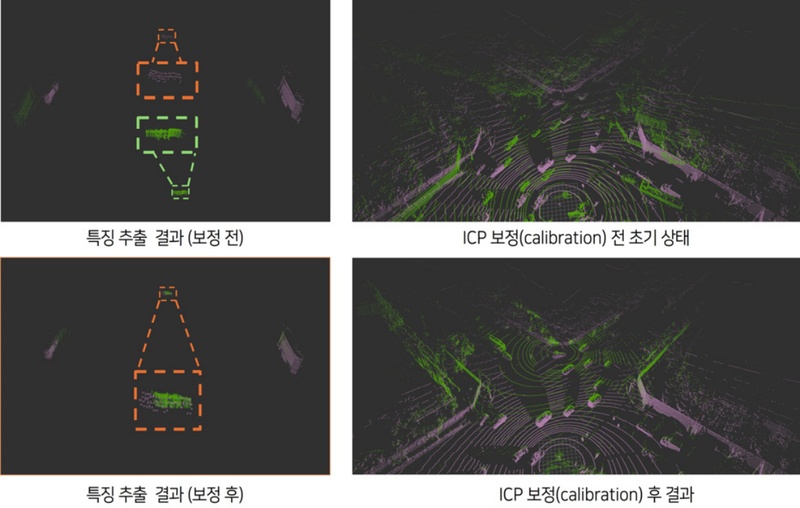

다중 카메라, 라이다를 사용하는 시스템은 각각의 센서들의 좌표계를 일치시켜야 한다. 이 과정을 캘리브레이션이라 부르며 제안된 시스템은 2단계로 첫 번째는 라이다, 라이다 캘리브레이션 단계와 두 번째는 카메라, 라이다 캘리브레이션 단계로 구성된다. 먼저 라이다, 라이다 좌표계 보정을 수행하였으며 ICP (Iterative Closest Point) 알고리즘[28]을 활용하였다. 그림 3은 캘리브레이션 결과로서 위는 좌표계 통일 전, 아래는 좌표계가 보정된 결과이다. ICP 알고리즘을 이용하여 최적의 라이다, 라이다 보정을 수행하기 위해, 관심영역을 지정하고 벽에 점 구름을 추출하여 오프라인으로 캘리브레이션을 수행하였다.

다음으로는 보정된 하나의 라이다 좌표계와 카메라 좌표계를 캘리브레이션을 해야 한다. 카메라, 라이다에 좌표계를 보정은 식 1로 표현되며 내부(Intrinsic) 파라미터와 외부(Extrinsic) 파라미터로 구성된다.

| (1) |

내부파라미터 K는 카메라 왜곡을 보정하는 파라미터로서 체커보드를 이용하여 계산할 수 있다. 라이다 좌표 x,y,z 를 이미지 픽셀 좌표계 u,v에 대응시키기 위한 외부 파라미터 R, T를 구하는 과정이다.

외부파라미터를 취득하는 방법은 타겟 기반 방법 [29], 비타겟 기반 방법 [30], 그리고 딥러닝 기반 방법의 세 가지 주요 접근 방식이 있다. 이 중 비타겟 기반 방법은 교통 법규 위반 감시 환경에 적합하다. 본 연구에서는 비타겟 기반 방법을 기반으로 엣지(edge) 특징을 활용한 보정을 수행했다. Luo et al. [31]은 학습이 필요 없는 환경에 적합한 방법을 제안했으나 검색 공간이 큰 도로변 환경에서는 초기 값을 결정하는 데 있어 비타겟 기반 방법이 더 효과적이다. 따라서 본 연구에서는 초기 값을 얻기 위해 비타겟 기반 방법을 사용한 후, 딥러닝 기반 오픈소스를 활용하여 세부 조정을 수행했다.

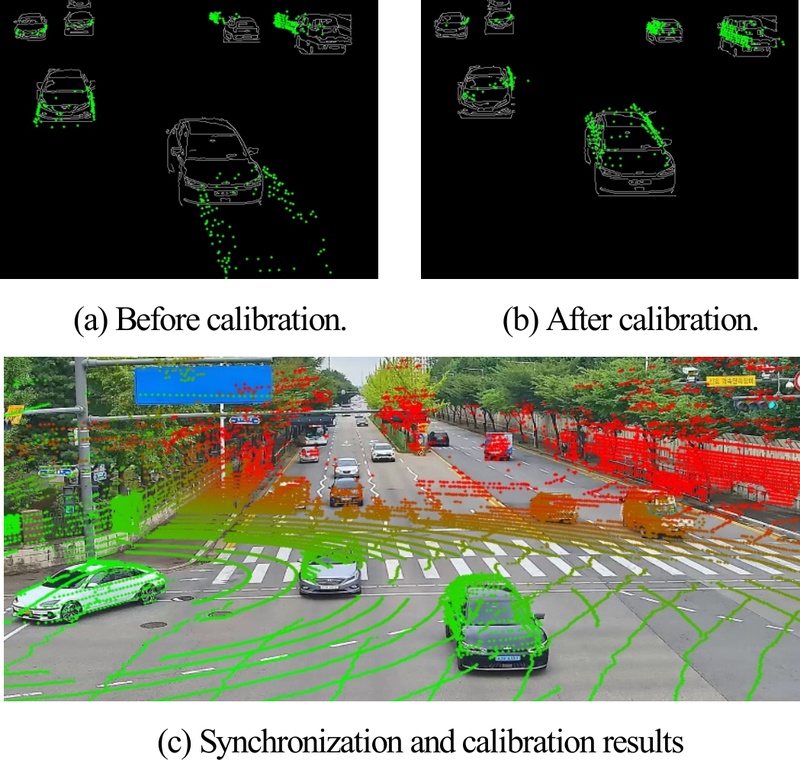

그림 4는 캘리브레이션 세부 과정으로 사전에 카메라 이미지를 누적하여 배경을 만든다. 배경과 현재 이미지 프레임에 차이가 나는 픽셀 좌표계에 마스크를 생성 후, 이동 물체 후보군 영역을 추출하여 Canny 엣지로 특징을 추출한다. 라이다 데이터는 DBSCAN (Density-Based Spatial Clustering of Applications with Noise) [32]로 이동 물체일 가능성이 있는 후보 점구름을 생성한다. 이전 프레임 점구름과 현재 프레임 점구름의 중심점 차이를 통해, 이동 물체 후보군을 활용하고 3D 불연속점을 추출한다. 이를 외부파라미터 R, T로 이미지에 투영 후, 두 특징의 거리가 근사해지는 최적의 외부파라미터를 찾는다. 그림 5는 캘리브레이션 후, 데이터 동기화까지 수행한 결과로서, 데이터 동기화는 캘리브레이션 이후에도 이동 물체의 차이가 발생하는 경우, 카메라 이미지 또는 라이다 점구름 데이터를 떨어뜨려 매칭하였다.

2. 객체 검출 및 추적 모듈

그림 6은 제안된 시스템의 객체 검출 및 추적 모듈에 수행 과정이다. 최근 딥러닝 기술의 발달로 이미지에서 위치와 분류를 수행할 수 있게 되었다. Yolov8 [33]은 이미지에서 실시간성을 보장하는 딥러닝 네트워크로서, 이미지 내의 객체의 위치와 분류를 수행한다. 우리는 Yolov8 네트워크를 이용하여 차량과 사람을 분류하고 영역 검출 후, 라이다는 군집화 알고리즘으로 도로 위 객체 후보군을 추출하였다. 라이다 객체 후보군의 점 구름 중심점을 계산하고 앞 절의 카메라, 라이다 보정 파라미터를 활용하여 이미지에 중심점을 투영한다. 투영된 중심점과 Yolov8로 찾은 바운딩 박스 중심점을 Euclidean 거리를 계산하여 매칭 행렬을 생성한다. 헝가리안 알고리즘은 최대 객체 매칭을 수행하여 각 센서 검출 결과의 가까운 거리를 매칭한다. 그림 6에서 Euclidean 거리 그림의 흰점은 Yolov8이 검출한 바운딩 박스 중심점을 의미하며 파란점은 투영된 라이다 중심점이다. 두 중심점에 중간 값은 빨간색 점으로 일정 임계값 거리에 데이터만 매칭하도록 하였다.

| (2) |

| (3) |

추적 관리부는 DeepSort [34]를 기반으로 구현되었으며 칼만 필터 기반으로 이미지 좌표가 아닌 라이다 거리좌표를 추적한다. 상태벡터 X와 측정 벡터 Z는 식 2, 3으로 표현된다.

상태벡터의 상태천이행렬 A는 등속도 모델을 사용하였고 측정벡터와 상태벡터의 상관관계를 표현하는 측정천이행렬 H는 선형 모델을 사용하여 각각 식 4, 5로 표현된다. 칼만필터의 업데이트 과정은 선형 칼만필터와 동일하다.

| (4) |

| (5) |

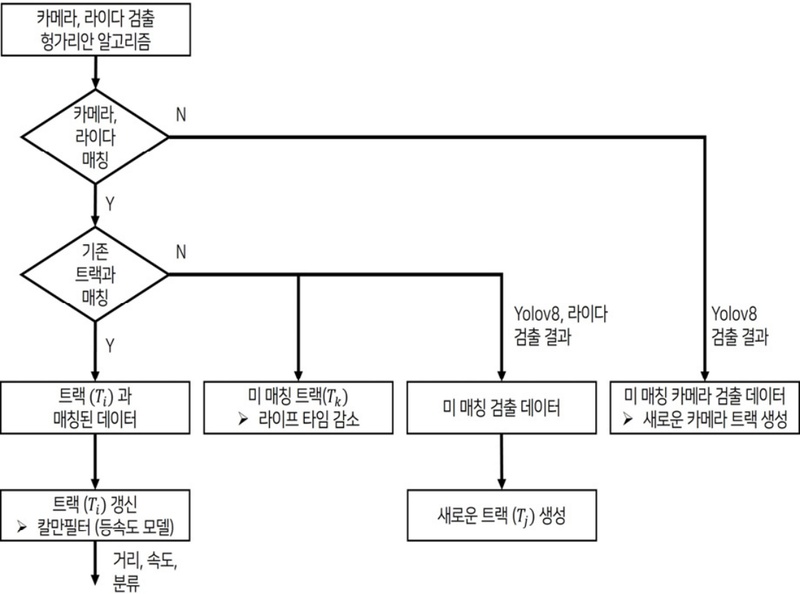

그림 7은 추적관리부로 칼만필터의 트랙 T을 관리한다. 매칭되지 않은 트랙은 라이프 타임을 감소시켜 트랙이 제거되도록 유도하며 분류 및 거리 측정이 된 데이터가 트랙 t번째와 매칭되면 트랙의 라이프타임을 증가시킨다. 어느 트랙과 매칭되지 않고 분류 및 거리가 측정된 데이터는 새로운 트랙을 생성하여 객체 추적을 수행한다. 최종적으로 일정 임계 값 보다 큰 라이프타임을 가지는 트랙만이 교통 법규 위반 판단을 위한 객체로 활용되며 거리와 분류 및 속도 추정에 신뢰가 있는 데이터만을 활용하여 카메라 기반 방법보다 신뢰성 있는 교통 법규 위반 감시 시스템을 구현하였다.

3. 감시 구역 설정 및 교통 법규 위반 감지 모듈

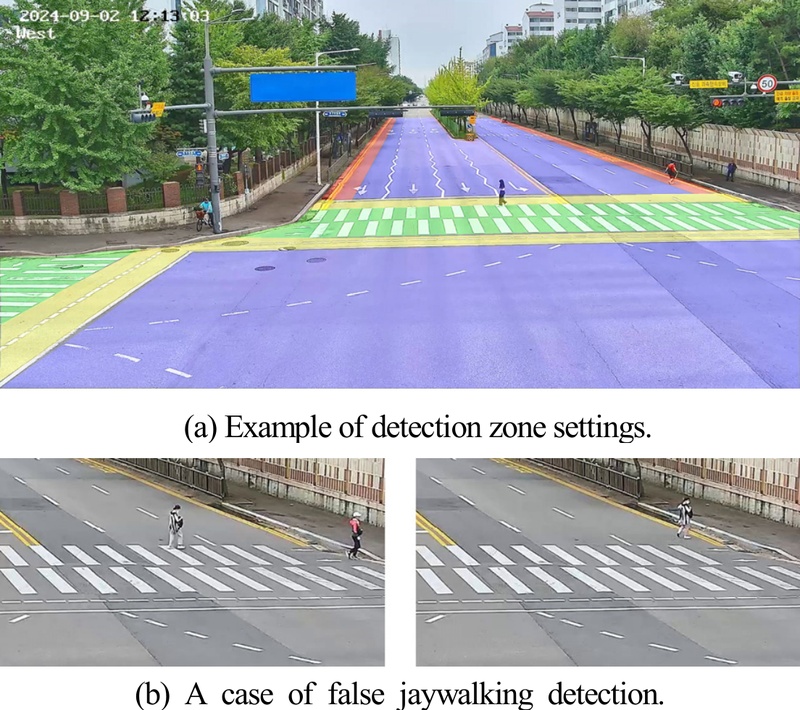

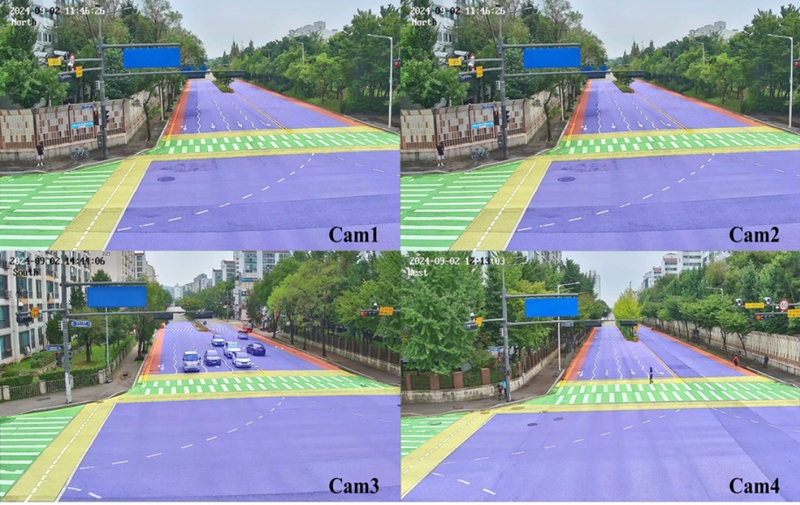

그림 8은 감시 구역예시로서, 횡단보도 영역은 초록색으로 빨간색 영역은 갓길 영역, 파란색 계열의 색깔은 도로 영역을 의미한다. 노란색은 보행자 경고영역으로 설정하여 횡단보도로부터 이탈하여 보행하는 보행자를 오검출하지 않도록 한다. 또한, 갓길 영역은 무단횡단과 불법주정차를 판단하는 데 필수적이며 무단횡단 경고 구역으로 활용하였다. 때때로 보행자가 갓길 영역에 위치하거나 불법주정차 차량에 사람이 인도로 진입하는 경우가 있다. 이때, 모든 보행자를 무단횡단으로 판단하면 오검지율이 증가함으로 우리는 갓길과 보행자 경고영역을 활용하여 오검지율을 감소시켰다.

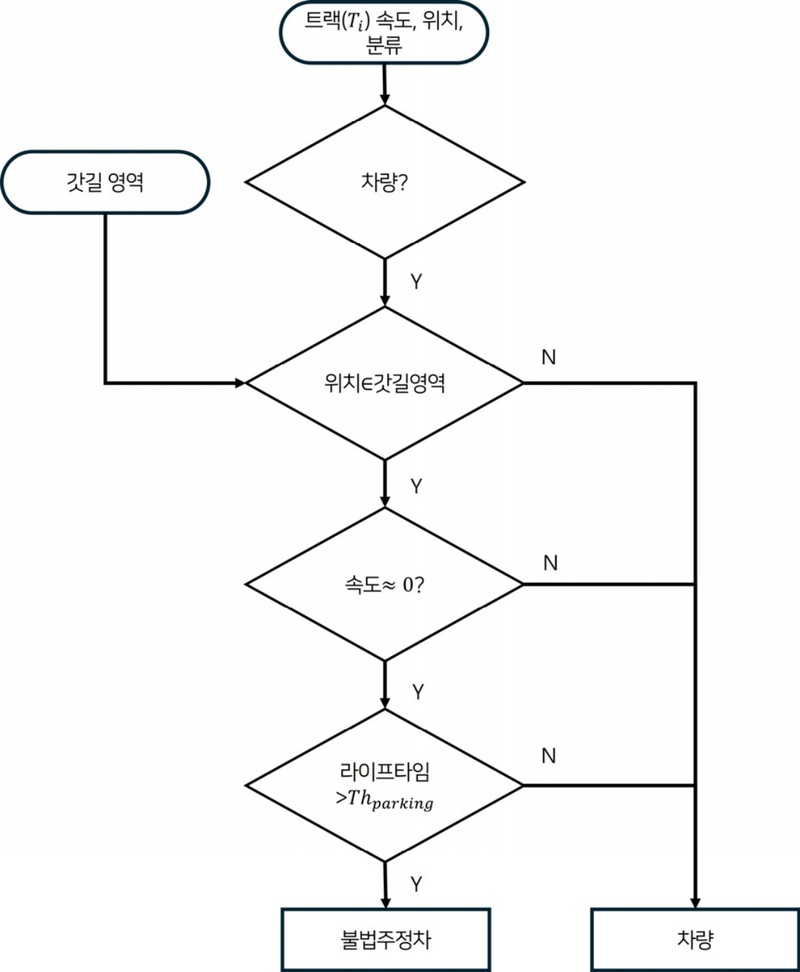

그림 9는 불법주정차 판단 흐름도로 추적 관리부로부터 트랙 Ti가 입력되면 속도, 위치, 분류 데이터를 활용하여 불법주정차를 판단한다. 차량이며 갓길 영역에 위치하고 추적된 데이터의 속도 정보가 0에 근사하면 불법주정차라 판단할 수 있다. 그러나 빈번한 오검출을 감소시키기 위해, 트랙의 라이프 타임을 활용하여 객체 추적이 충분히 진행되어 신뢰할 수 있는 속도 추정 정보일 때, 불법주정차로 판단하였다. 라이다 데이터는 위치를 측정이 가능하나 속도를 측정할 수는 없다. 속도 추정 값에 불확실성을 고려하여 라이프 타임을 통해 한번 검증하였다.

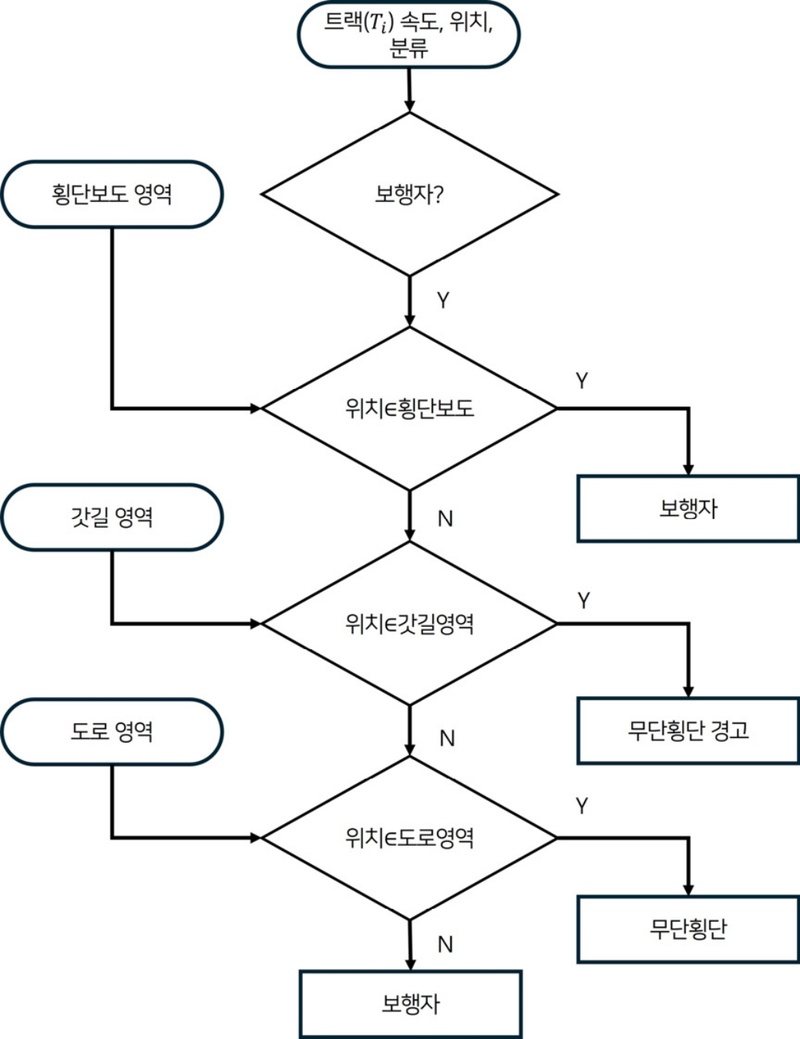

그림 10은 무단횡단 판단 순서도로 트랙의 보행자 정보가 입력되면 위치를 보고 횡단보도 영역에 위치하면 보행자로 분류한다. 그러나 갓길 영역에 보행자가 위치하는 경우, 무단횡단 경고로 분류하여 오검지를 방지하였으며 도로 영역에 존재하는 경우, 무단횡단으로 판단하였다. 이때, 위치는 카메라 픽셀 데이터 u, v와 라이다 좌표 x, y를 모두 고려하였다.

IV. 실험 및 결과

1. 실험 환경 및 데이터 셋 구성

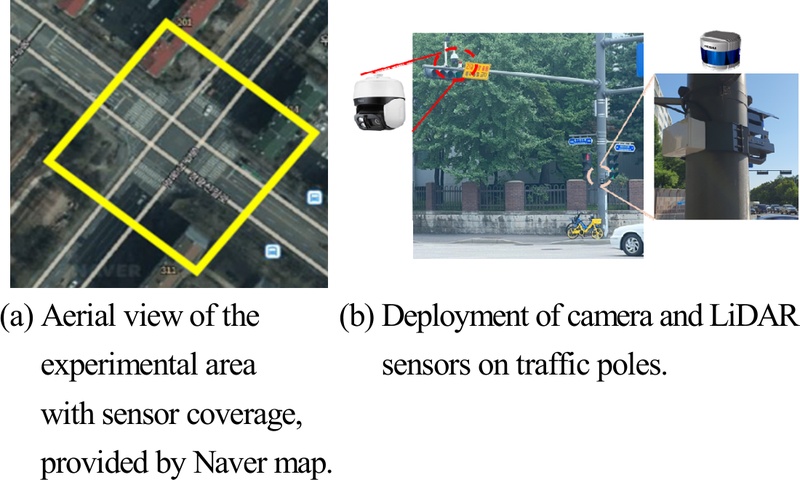

그림 11은 실험 환경으로서 한국 시흥시의 실제 도로 교차로이다. 그림 11(a)는 네이버 맵 애플리케이션에서 제공하는 항공사진이다. 카메라는 교차로 지역의 신호등에 부착되고 라이다는 그림 11(b)와 같이 도로변에 부착된다. 그림 12는 실험 환경인 시흥 CCTV 데이터의 감지구역을 시각화한 이미지 예시이다. 4대의 CCTV 카메라와 2대의 Hesai 40ch 라이다가 사용되었다. 카메라와 라이다 데이터는 동기화를 수행하였으며 GPU는 RTX 3080 사용하였고, 감지 네트워크는 Yolov8을 사용하였다. 모든 네트워크 훈련은 오픈 데이터 세트인 kitti 데이터 셋과 시흥시에서 수집한 데이터의 주간 데이터 3584장과 야간 이미지 500장을 학습에 활용되었다. 또한, ROS (Robot Operating System) 프레임워크에서 개발되었다. 교통법규위반감시 시스템은 거짓 양성(예: 횡단보도 위반으로 잘못 분류된 보행자)과 거짓 음성(예: 실제 횡단보도 위반자를 감지하지 못함)을 최소화하는 것을 목표로 하였다. 평가 데이터 셋 객체 규모는 주간 이벤트 1000개, 야간 300개, 폐색 200개, 악천 후 200개를 선별하여 평가하였으며 평가 지표로는 정밀도(Precision), 재현율(Recall), F1-Score를 활용하였다.

2. 교통 법규 위반 감지 결과

표 1은 교통 법규 위반 검출 결과로서 정밀도가 약간 하락하였으나 재현율이 약 10% 증가하였다. 정밀도의 하락은 주로 오검지나 객체 추적의 데이터가 몇 프레임간 잘못된 객체를 추적하여 증가하는 경향이 있었다. 그림 13은 무단횡단 검출에서 주로 발생 가능한 폐색 상황을 보여준다. 그림 상단의 결과는 yolov8의 검출 결과로 가려진 사람을 검출하지 못한다. 그러나 라이다 융합의 결과는 폐색 상황에서 가려진 물체에 대한 점구름을 투영 및 객체 추적을 통해 폐색 상황에서도 무단횡단을 검출할 수 있다. 그림 14는 야간이며 폐색 상황에서의 무단횡단 검출 결과이다. 동일하게 이미지에서는 검출되지 않았으며 라이다에서는 검출하였다. 그러나 일부 검출 결과는 오탐지이거나 위치 추정이 불안정하여 잘못된 위치에 바운딩 박스가 존재하였으며 이는 정밀도를 하락시키는 요인이 되었다.

Comparison of performance and reliability between camera and camera-LiDAR fusion systems (P: Precision, R: Recall, F1: F1-Score).

환경 조건별 교통 법규 위반 검출 성능 분석 결과는 표 2에 정리되어 있다. 카메라와 라이다를 활용한 검출에서는 폐색 상황에서 재현율이 크게 증가해 성능 향상에 기여했다. 하지만, 오탐지 증가로 인해 정밀도가 일부 하락했으며, 특히 악천후 상황에서는 성능향상이 미미했다. 이는 카메라에서 검출이 이루어지지 않는 경우 라이다가 보조 역할을 하지만, 성능 향상이 제한적임을 시사한다.

Performance comparison of traffic law violation detection across different environmental conditions (P: Precision, R: Recall, F1: F1-Score).

그림 15는 악천후 상황에서의 검출 결과를 보여주며, 이는 학습 시 악천후 데이터를 포함하지 않은 점에서 기인한 문제다. 카메라와 라이다의 보조 효과를 분석하기 위해 악천후 데이터를 학습에서 제외했고, 야간 데이터도 제한적으로 학습에 포함했다. 이를 통해 폐색 상황에서 재현율 증가와 같은 카메라와 라이다의 결합으로 얻을 수 있는 이점을 분석할 수 있었으며, 학습 데이터에 의존하는 성능의 한계도 파악할 수 있었다.

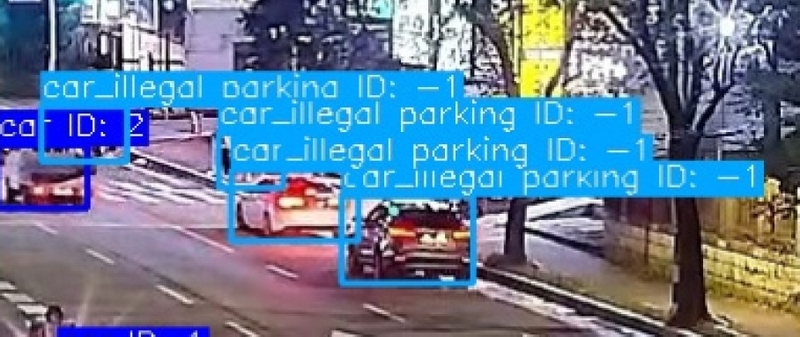

표 3은 교통 법규 위반 별 검출 사례를 분석하였다. 주로 무단횡단 검출에서 재현율 지표가 우수하였다. 그러한 이유는 폐색 상황이 자주 발생하여 재현율 지표가 증가한 것으로 분석된다. 그러나 불법 주정차에서는 재현율이 크게 증가하지 않았으며 정밀도는 하락하는 문제가 있다. 그림 16은 불법 주정차 감지에 대한 실험 결과로서, 라이다 데이터의 취약점을 보여준다. ID에 –1 값은 라이다 데이터가 매칭되지 않았음을 의미한다. 불법 주정차는 실험 환경 구역인 교차로 중심에서 50m 이상의 위치한 차량을 검출 및 거리를 측정해야 한다. 그러나 그림 결과로 보듯이 라이다 데이터가 희소한 문제로 인해, 군집화 알고리즘을 이용한 검출이 불가능하다. 또한, 비타겟 기반의 캘리브레이션 방법이 먼 거리에서의 라이다 데이터의 투영마저 정밀하게 수행되기 어렵다. 이러한 문제들로 인해, 불법 주정차에서의 성능이 크게 증가하지 않은 것으로 파악된다.

Performance comparison of detection by traffic laws violation types (P: Precision, R: Recall, F1: F1-Score).

표 4는 학습 데이터 셋의 규모에 따른 성능 평가 결과를 나타낸다. 이 평가는 객체 검출 네트워크의 성능이 제안된 방법에 미치는 영향을 분석하기 위해 수행되었다. 결과에 따르면, 학습 데이터의 양에 따라 전체적인 성능 차이가 발생함을 확인할 수 있다. 특히, 학습 데이터 셋의 20%만 활용한 경우에도 제안된 방법은 재현율이 약 10% 증가한 것을 보여준다. 이는 학습 성능에 관계없이 라이다(LiDAR)를 활용한 방법이 교통 법규 위반 감지에서 유의미한 도움을 줄 수 있음을 입증하는 결과이다.

V. 결론

본 연구에서는 카메라와 라이다(LiDAR)를 융합한 교통 법규 위반 감시 시스템을 제안하고, 다양한 환경에서의 성능을 실험적으로 평가하였다. 기존의 카메라 기반 교통 감시 시스템은 낮이나 일정한 조명 조건에서는 우수한 성능을 보였으나, 야간, 폐색, 악천후 등의 불리한 환경에서는 신뢰성이 저하되는 한계를 가지고 있었다. 이를 해결하기 위해 라이다의 3D 거리 데이터와 카메라의 시각 정보를 융합하여 이러한 한계를 극복하고자 하였다.

실험 결과, 제안된 시스템은 특히 폐색 상황과 야간 환경에서 높은 재현율을 기록하며 기존의 카메라 기반 시스템 대비 성능이 향상됨을 확인하였다. 학습 데이터 셋의 크기에 따른 성능 평가에서도, 학습 데이터의 20%만 사용하더라도 라이다를 활용한 융합 시스템이 카메라 단독 시스템보다 약 10% 높은 재현율을 보였다. 이는 제안된 융합 접근법이 데이터 부족 상황에서도 견고한 성능을 제공할 수 있음을 시사한다.

다만, 악천후 환경에서의 성능 향상이 제한적이었고, 불법 주정차 감지에서 라이다 데이터의 희소성과 캘리브레이션 정밀도의 한계로 인해 일부 성능 저하가 나타났다. 이러한 점은 향후 연구에서 개선이 필요한 부분으로 판단된다. 또한, 라이다 데이터를 활용한 객체 검출과 추적 과정에서 발생한 오탐지 문제는 추가적인 알고리즘 최적화와 데이터 학습 보완을 통해 해결 가능할 것으로 보인다.

결론적으로, 본 연구는 카메라와 라이다 융합 시스템이 교통 법규 위반 감지에 있어 보다 신뢰할 수 있는 대안을 제공할 수 있음을 증명하였다. 특히, 폐색과 야간 상황과 같이 기존 시스템이 한계를 보이는 환경에서 효과적으로 작동할 수 있는 가능성을 확인하였다. 앞으로는 악천후 및 라이다 데이터의 활용성을 높이기 위한 추가 연구를 통해, 실제 도로 환경에서 더욱 안정적이고 효율적인 교통 법규 위반 감시 시스템을 구현할 수 있을 것이다.

Acknowledgments

본 논문은 정부(과학기술정보통신부)의 재원으로 정보통신기획평가원의 지원을 받아 수행된 지역지능화혁신인재양성사업임(IITP-2025-RS-2020-II201462), 이 논문은 2024학년도 충북대학교 학술연구영역 사업의 연구비 지원에 의하여 연구되었음.

References

-

N. -Y. Kim and K. -M. Lee, “Intelligence detection and identification of traffic rule violations using a drone,” Journal of Institute of Control, Robotics and Systems (in Korean), vol. 28, no. 12, pp. 1127-1132, Dec. 2022.

[https://doi.org/10.5302/J.ICROS.2022.22.0154]

-

J. -Y. Kim and S. -H. Kim, “Deep learning based object detection method and its application for intelligent transport systems,” Journal of Institute of Control, Robotics and Systems (in Korean), vol. 27, no. 12, pp. 1016-1022, Dec. 2021.

[https://doi.org/10.5302/J.ICROS.2021.21.0145]

-

Y. Zheng, T. Chase, L. Elefteriadou, B. Schroeder, and V. P. Sisiopiku, “Modeling vehicle–pedestrian interactions outside of crosswalks,” Simulation Modelling Practice and Theory, vol. 59, pp. 89-101, 2015.

[https://doi.org/10.1016/j.simpat.2015.08.005]

-

B. T. Morris and M. M. Trivedi, “A survey of vision-based trajectory learning and analysis for surveillance,” IEEE Transactions on Circuits and Systems for Video Technology, vol. 18, no. 8, pp. 1114-1127, 2008.

[https://doi.org/10.1109/TCSVT.2008.927109]

-

B. R. Kadali and P. Vedagiri, “Proactive Pedestrian safety evaluation at unprotected mid-block crosswalk locations under mixed traffic conditions,” Safety Science, vol. 89, pp. 94-105, 2016.

[https://doi.org/10.1016/j.ssci.2016.05.014]

-

A. Pramanik, S. Sarkar, and J. Maiti, “A real-time video surveillance system for traffic pre-events detection,” Accident Analysis & Prevention, vol. 154, p. 106019, 2021.

[https://doi.org/10.1016/j.aap.2021.106019]

-

L.-C. Kuo and H.-Y. Lin, “Illegal Parking detection based on multi-task driving perception,” Proc. 2024 IEEE Intelligent Vehicles Symposium (IV), pp. 1865-1870, 2024.

[https://doi.org/10.1109/IV55156.2024.10588798]

-

S. Mostafi, W. Zhao, S. Sukreep, K. Elgazzar, and A. Azim, “Real-time jaywalking detection and notification system using deep learning and multi-object tracking,” Proc. 2022 IEEE Global Communications Conference (GLOBECOM), pp. 1164-1168, 2022.

[https://doi.org/10.1109/GLOBECOM48099.2022.10000957]

-

X. Zhang, Y. Feng, P. Angeloudis, and Y. Demiris, “Monocular visual traffic surveillance: A review,” IEEE Transactions on Intelligent Transportation Systems, vol. 23, no. 9, pp. 14148–14165, 2022.

[https://doi.org/10.1109/TITS.2022.3147770]

-

H. Kim, H. Jeon, D. Kim, and J. Kim, “Lightweight framework for the violence and falling-down event occurrence detection for surveillance videos,” Proc. 2022 13th International Conference on Information and Communication Technology Convergence (ICTC), IEEE, pp. 1629–1634, 2022.

[https://doi.org/10.1109/ICTC55196.2022.9952688]

-

M. Hassaballah, K. Murakami, S. Shoji, and S. Iwasaki, “Vehicle detection and tracking in adverse weather using a deep learning framework,” IEEE Transactions on Intelligent Transportation Systems, vol. 22, no. 7, pp. 4230–4242, Jul. 2020.

[https://doi.org/10.1109/TITS.2020.3014013]

-

M. Bijelic, T. Gruber, W. Ritter, F. Kellner, K. Dietmayer, W. Reinhold, F. Kraus, K. Schmidt, and W. Franke, “Seeing through fog without seeing fog: Deep multimodal sensor fusion in unseen adverse weather,” Proc. IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), Seattle, WA, USA, pp. 11682–11692, Jun. 2020.

[https://doi.org/10.1109/CVPR42600.2020.01170]

-

Y. Li, H. Ma, Z. Wang, H. Xie, R. Wang, and D. Wang, “Deepfusion: Lidar-camera deep fusion for multi-modal 3D object detection,” Proc. IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), New Orleans, LA, USA, pp. 17182-17191, Jun. 2022.

[https://doi.org/10.1109/CVPR52688.2022.01667]

-

R. Heinzler, P. Schindler, J. Seekircher, W. Ritter, and W. Stork, “Weather Influence and Classification with Automotive Lidar Sensors,” Proc. 2019 IEEE Intelligent Vehicles Symposium (IV), pp. 1527-1534, 2019.

[https://doi.org/10.1109/IVS.2019.8814205]

-

I. Jeelani, A. Han, S. Albert, and M. A. Al-Hussein, “Real-time vision-based worker localization & hazard detection for construction,” Automation in Construction, vol. 121, p. 103448, 2021.

[https://doi.org/10.1016/j.autcon.2020.103448]

-

H. Luo, J. Tang, and J. Xu, “Real-time smart video surveillance to manage safety: A case study of a transport mega-project,” Advanced Engineering Informatics, vol. 45, p. 101100, 2020.

[https://doi.org/10.1016/j.aei.2020.101100]

-

J. Azimjonov and A. Özmen, “A real-time vehicle detection and a novel vehicle tracking systems for estimating and monitoring traffic flow on highways,” Advanced Engineering Informatics, vol. 50, p. 101393, 2021.

[https://doi.org/10.1016/j.aei.2021.101393]

-

J. D. Trivedi, S. D. Mandalapu, and D. H. Dave, “Vision-based real-time vehicle detection and vehicle speed measurement using morphology and binary logical operation,” Journal of Industrial Information Integration, vol. 27, p. 100280, 2022.

[https://doi.org/10.1016/j.jii.2021.100280]

-

J. Shen, G. Li, W. Yan, W. Tao, G. Xu, D. Diao, and P. Green, “Nighttime driving safety improvement via image enhancement for driver face detection,” IEEE Access, vol. 6, pp. 45625–45634, 2018.

[https://doi.org/10.1109/ACCESS.2018.2864629]

-

H. Kuang, L. Chen, L. L. H. Chan, R. C. Cheung, and H. Yan, “Feature selection based on tensor decomposition and object proposal for night-time multiclass vehicle detection,” IEEE Transactions on Systems, Man, and Cybernetics: Systems, vol. 49, no. 1, pp. 71-80, 2018.

[https://doi.org/10.1109/TSMC.2018.2872891]

-

M. Kumar, S. Ray, and D. K. Yadav, “Moving human detection and tracking from thermal video through intelligent surveillance system for smart applications,” Multimedia Tools and Applications, vol. 82, no. 25, pp. 39551-39570, 2023.

[https://doi.org/10.1007/s11042-022-13515-6]

-

T. Rothmeier, S. Klatte, L. Wiesmann, K. Dietmayer, and F. Diermeier, “I had a bad day: Challenges of object detection in bad visibility conditions,” Proc. 2023 IEEE Intelligent Vehicles Symposium (IV), Anchorage, AK, USA, pp. 1-6, Jun. 2023.

[https://doi.org/10.1109/IV55152.2023.10186674]

-

M. Zou, X. Zhang, L. Wang, H. Li, and Y. Chen, “A novel day-to-night obstacle detection method for excavators based on image enhancement and multisensor fusion,” IEEE Sensors Journal, vol. 23, no. 10, pp. 10825–10835, May 2023.

[https://doi.org/10.1109/JSEN.2023.3254588]

-

L. Qiao, P. Zhang, Y. Liang, X. Yan, L. Huangfu, X. Zheng, and Z. Yu, “Cross-modality 3D multiobject tracking under adverse weather via adaptive hard sample mining,” IEEE Internet of Things Journal, vol. 11, no. 14, pp. 25268–25282, Jul. 15, 2024.

[https://doi.org/10.1109/JIOT.2024.3392844]

-

S. Wang, Y. Liu, J. Zhang, and Q. Chen, “Object tracking based on the fusion of roadside LiDAR and camera data,” IEEE Transactions on Instrumentation and Measurement, vol. 71, pp. 1-14, 2022.

[https://doi.org/10.1109/TIM.2022.3201938]

-

Z. Zhao, Y. Liu, H. Wang, and M. Zhang, “Robust 3D multi-object tracking in adverse weather with hard sample mining,” Proc. 2023 IEEE 26th Int. Conf. Intell. Transp. Syst. (ITSC), Bilbao, Spain, pp. 4933–4940, Sep. 2023.

[https://doi.org/10.1109/ITSC57777.2023.10422642]

-

M. Dreissig, S. Klatte, K. Dietmayer, and M. Schuster, “Survey on lidar perception in adverse weather conditions,” Proc. 2023 IEEE Intelligent Vehicles Symposium (IV), Anchorage, AK, USA, pp. 1-8, Jun. 2023.

[https://doi.org/10.1109/IV55152.2023.10186539]

-

A. Segal, D. Haehnel, and S. Thrun, “Generalized-icp,” Robotics: Science and Systems, vol. 2, No. 4, pp. 435, 2009.

[https://doi.org/10.7551/mitpress/8727.003.0022]

-

A. Geiger, F. Moosmann, O. Car, and B. Schuster, “Automatic camera and range sensor calibration using a single shot,” Proc. 2012 IEEE International Conference on Robotics and Automation (ICRA), St. Paul, MN, USA, pp. 3936–3943, May 2012.

[https://doi.org/10.1109/ICRA.2012.6224570]

-

J. Levinson and S. Thrun, “Automatic online calibration of cameras and lasers,” Proc. Robotics: Science and Systems, Berlin, Germany, June 2013.

[https://doi.org/10.15607/RSS.2013.IX.029]

-

Z. Luo, X. Chen, Y. Li, H. Wang, and Y. Zhang, “Zero-training LiDAR-camera extrinsic calibration method using segment anything model,” Proc. of 2024 IEEE International Conference on Robotics and Automation (ICRA), Yokohama, Japan, pp. 14472-14478, May 2024.

[https://doi.org/10.1109/ICRA57147.2024.10610983]

- M. Ester, H.-P. Kriegel, J. Sander, and X. Xu, “A density-based algorithm for discovering clusters in large spatial databases with noise,” Proc. 2nd Intelligence Conference on Knowledge Discovery and Data Mining, pp. 226-231, 1996.

- G. Jocher, A. Chaurasia, and J. Qiu, “Ultralytics YOLOv8,” 2023. [Online].Available: https://github.com/ultralytics/ultralytics, .

-

N. Wojke, A. Bewley, and D. Paulus, “Simple online and realtime tracking with a deep association metric,” Proc. 2017 IEEE International Conference on Image Processing, Beijing, China, pp. 3645–3649, Sep. 2017.

[https://doi.org/10.1109/ICIP.2017.8296962]

2018년 충북대학교 전자공학부 졸업. 2020년 충북대학교 제어로봇공학 석사. 2020년 ~ 현재 충북대학교 제어로봇공학 박사과정. 관심분야는 센서 융합, 딥러닝 네트워크.

2022년 공주대학교 제어계측공학과 졸업. 2025년 충북대학교 지능로봇공학 석사. 관심분야는 최적화 알고리즘, 센서 융합 캘리브레이션.

2024년 충북대학교 전자공학부 졸업. 2024년~현재 충북대학교 지능로봇 공학 석사과정. 관심분야는 딥러닝 네트워크., 자율주행 환경 인지.

1988년 서울대 제어계측공학과 졸업. 1990년 동 대학원 석사. 1994년 동 대학원 박사. 1994년~1997년 삼성테크원(주) 선임연구원 1997년~현재 충북대학교 지능로봇공학과 교수. 2000년~2001년 토론토 대학교 방문교수. 2012년~2017년 대한전기확회 로보틱스 및 자동차 연구회 위원장. 2020년~현재 과기정통부 지정 Grand ICT 연구센터(산업인공지능 연구센터) 센터장. 관심분야는 자율주행, 로보틱스, 산업인공지능 등.