LSTM을 활용한 보행 시 카메라 기반 하지관절각 추정 오차 보정법

Copyright© ICROS 2025

Abstract

This study proposes a method to enhance the accuracy of vision-based human joint angle estimation by correcting errors that occur during the process of estimating the positions and angles of human joints from videos captured with a monocular camera using long short-term memory (LSTM). The proposed method assumes joint angle data collected using a Vicon motion capture system as ground truth and trains an LSTM model to adjust the camera-based joint angle estimates to match the Vicon values. The test result demonstrates the potential of upgrading the performance of low-cost camera-based joint angle estimation methods to a level comparable with high-cost motion capture systems.

Keywords:

gait analysis, joint angle estimation, sequence data correction, motion capture, LSTMI. 서론

인간의 보행 특성을 분석하면 개인의 신체 상태, 신경계, 근골격계 건강, 그리고 전반적인 건강 상태를 반영하는 중요한 지표이다. 보행 분석(gait analysis)은 근골격계와 신경계 건강 상태를 평가하고, 심혈관 기능과 대사 건강을 측정하며, 노화 및 낙상 위험을 예측하는 데 유용하다. 또한 정신 건강 상태를 반영하고 운동 및 피트니스 수준을 진단하며, 비만이나 대사 증후군과 같은 문제를 조기에 발견할 수 있다[1].

보행 분석에서 많이 사용하는 지표로는 보행 속도, 보폭, 균형, 대칭성 등이 있으며, 이는 파킨슨병, 관절염, 우울증, 심부전 등의 질환을 진단하거나 재활 과정의 치료 효과를 평가하는 데 활용된다[2]. 한편, 보행 분석 시 하지 관절각의 궤적을 추정할 수 있으면 보행의 미세한 이상을 정밀하게 감지하고, 재활 및 치료 효과를 정량적으로 평가할 수 있으며, 부상 예방과 운동 수행 최적화에 기여할 수 있다[3]. 그리고 관절 움직임의 비정상적인 변화를 통해 관절염, 신경계 손상, 대사 이상 등의 질병을 조기에 진단할 수 있으며, 이를 바탕으로 더욱 개인화된 보행 분석과 맞춤형 건강 관리가 가능하다.

보행 시 하지 관절각을 측정하기 위해 모션 캡처 기술을 도입하고 있는데, 주로 마커/광학 시스템과 마커가 필요 없는 MLMC (Marker-less Motion Capture) 시스템으로 나뉜다[4]. 마커/광학 시스템은 인체의 생체역학 및 모션 분석의 최고 기준(golden standard)으로 사용되는 Vicon 시스템이 대표적이며, 여러 대의 적외선 카메라와 반사 마커를 활용하여 신체 주요 관절의 3차원 위치를 측정하고, 삼각측량법을 통해 마커의 3차원 위치를 계산하여 인체의 관절 좌표와 움직임을 높은 정확도로 추정 및 분석한다[5]. 그러나, Vicon 시스템은 가격이 비싸고, 카메라를 배치하기 위해 넓은 공간이 확보되어야 하며, 결과의 정확도를 보장하기 위해 숙련된 전문가에 의한 정밀한 캘리브레이션 과정이 요구된다.

반면에 MLMC 시스템은 마커가 필요 없어 운영 절차가 간소화되고 비용이 저렴하며, 보행 시 트레드밀 분석과 같은 단순한 작업에 적합해 점점 더 인기를 얻고 있다. 특히, MLMC 시스템은 보행 분석을 통해 파킨슨병과 같은 신경학적 상태를 식별하는 데 활용될 수 있다. MLMC 분야에서 최근 많은 연구가 이뤄지고 있는 분야가 단일/다중 카메라로 모션을 촬영하여 수집한 2D/3D 영상 데이터를 분석하여 포즈를 추정하는 인체 포즈추정(HPE, Human Pose Estimation) 기술이며, OpenPose [6], MediaPipe Pose [7], HybrIK [8], SMPLify-X [9] 등의 기법들이 있다.

카메라 기반 HPE 기술은 딥러닝 기반으로 개발되어 정확도와 실행속도가 개선되고 있지만, 환경 조건에 따라 정확도가 떨어지는 한계가 있다. 즉, 영상의 해상도가 낮거나, 저조도 환경에서 촬영되었다면 관절의 위치를 정확하게 식별하기 어렵다. 그리고 피사체가 빠르게 움직이는 경우 모션 블러(motion blur)가 발생하여 관절 좌표를 정확히 추적하기 어려울 수 있으며 카메라의 위치나 각도에 따라 관절 일부가 가려져 정확한 위치를 추정하기 어려울 수 있다. 또한, 추정한 관절의 3차원 좌표로부터 관절각을 계산하는 과정에서 역기구학(inverse kinematics, IK) 계산식이나 최적화 과정에서 추가적으로 오차가 발생할 수 있다. 결과적으로, 인체를 뼈와 관절을 이용한 단순화된 스틱 다이어그램(stick diagram)으로 표현함으로써 실제 인체의 복잡성을 완전히 반영하지 못하기에 카메라 기반 HPE 기술에서 관절각 계산에 오차가 발생하는 것은 피할 수 없다.

본 논문에서는 이렇게 카메라 영상 기반으로 인체 관절각을 추정할 때 발생하는 오차를 교정하기 위해 순환신경망(recurrent neural network)의 일종인 LSTM (Long Short-Term Memory) [10,11]을 이용하여 카메라 기반 HPE 기술로 추정(estimate)한 관절각을 Vicon으로 측정(measure)한 관절각에 최대한 일치하도록 교정 하는(correct) 모델을 제안한다. 그리고 제안한 모델의 성능을 테스트하기 위해 다항 회귀(Polynomial Regression) 모델과 비교 실험을 진행하였으며, 모델 훈련에 포함하지 않은 보행 데이터를 사용하여 두 종류의 관절각 간 일치도를 비교했다.

II. 영상 기반 추정 관절각 오차 교정 모델

본 논문에서 제안하는 영상 기반 추정 관절각 교정 방법은 관절각 궤적 데이터 준비, 데이터 전처리, 모델 설계 및 훈련의 단계로 구성된다.

1. 데이터 준비

본 논문에서는 모델 훈련과 검증을 위해 보행 시 Vicon 시스템과 단안 카메라 기반 보행분석 시스템(MCGAS, Monocular Camera-based Gait Analysis System)에서 동시에 측정 및 추정한 하지 관절각(고관절과 슬관절 각도) 궤적 데이터를 사용하였다. MCGAS는 본 연구자들이 최근 개발한 방법으로, 인체 모션을 촬영한 RGB 영상에 포즈 AI (MediaPipe Pose와 HybrIK 등)를 적용하여 매 프레임에서 2차원/3차원 관절 위치 정보를 추출하고, 23자유도 휴머노이드 모델의 주요 관절 위치가 이 관절 위치와 최대한 비슷하도록 고속 최적화 알고리즘인 uDEAS (univariate Dynamic Encoding Algorithm for Searches)를 사용하여 카메라 정보(카메라와 대상인 간 상대적 각도와 거리)와 주요 인체 관절각을 추정하는 시스템이다[12,13].

모델 훈련 및 검증에 사용한 데이터는 표 1과 같이 남성 2명과 여성 2명 피험자로부터 수집한 것이다. 피험자는 Vicon 카메라가 설치된 환경에서 전신 마커를 부착한 상태로 트레드밀 위를 걸었다. 단안 카메라는 피험자 뒤쪽 2.3m 거리에서 고정된 상태로 뒷모습을 촬영했다. 보행 실험은 각각 2.8km/h, 3.5km/h, 4.2km/h의 속도로 60초간 진행했다.

2. 데이터 전처리

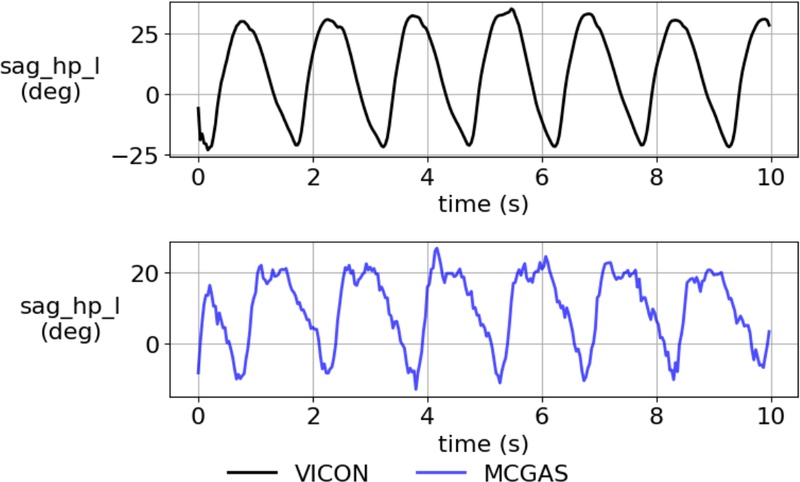

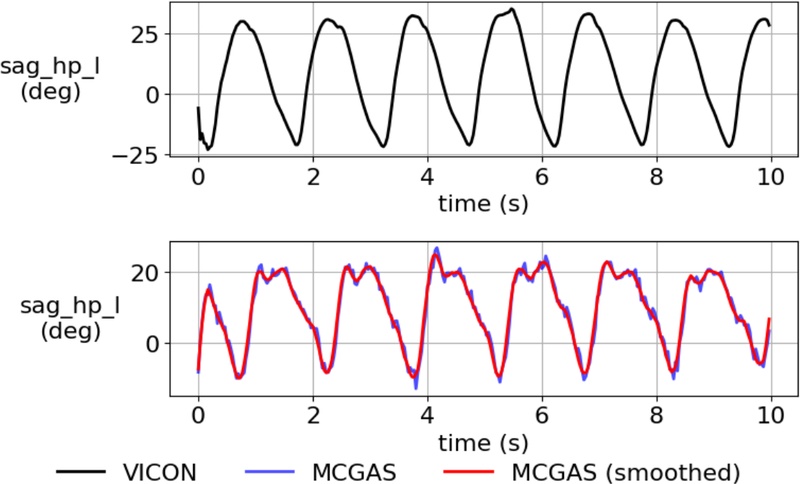

모델 훈련에 앞서 Vicon으로 측정한 관절각 궤적과 카메라 영상으로 추정한 관절각 궤적 간 샘플링 속도와 시간 축을 일치시키는 동기화(synchronization) 작업이 필요하다. Vicon 시스템은 초당 100Hz, 카메라 영상은 초당 30Hz의 샘플링 속도를 가지므로 두 데이터를 동기화하기 위해 Vicon 시스템의 관절각 데이터를 30Hz로 다운샘플링(down sampling) 하였다. 다운샘플링은 과학 기술 컴퓨팅에 사용되는 Python 라이브러리인 SciPy의 resample 함수를 사용하여 진행하였다[14]. 이 함수는 입력 신호를 주어진 샘플 수에 맞게 재샘플링하여, 데이터의 길이를 조정하면서도 신호의 주파수 정보를 최대한 유지하는 데 사용된다. 샘플 수는 두 데이터 간 샘플링 속도비를 고려하여 Vicon 데이터 길이의 약 1/3만큼 지정하였다. Vicon 데이터를 다운샘플링한 결과는 그림 1과 같다. 그림에서 y축 라벨의 sag_hp_l은 시상면(sagittal plane) 왼쪽(left) 고관절(hip joint)을 의미한다.

Results of sampling rate synchronization for the left hip joint angle (Top: Vicon results, Bottom: MCGAS results).

영상 데이터의 경우 관절 위치 추정 시 좌표가 흔들리는 현상이 발생하고, 이는 관절각 추정에도 영향을 주어 그림 1의 하단에서 보듯이 추정 관절각에 불규칙한 노이즈가 포함된다. 모델 훈련 과정에서 안정적인 학습을 돕기 위해 사비츠키-골레이(Savitzky-Golay) 필터를 사용하여 영상 추정 관절각 데이터를 평활화(smoothing) 하였다[15]. 사비츠키-골레이(Savitzky-Golay) 필터는 지정한 윈도우 크기의 데이터에 다항식(polynomial)을 최소제곱법으로 피팅하여 데이터를 평활화할 수 있어 신호 처리, 데이터 분석, 시계열 데이터의 노이즈 제거 등에 활용될 수 있다. 본 논문에서는 윈도우 크기를 10으로 지정하고 2차 다항식을 선택하였으며, Python 라이브러리 SciPy의 savgol_filter 함수를 사용하여 영상 추정 관절각 데이터에 평활화 필터를 적용하였다. 그림 2의 하단 그래프의 붉은색 부드러운 선이 사비츠키-골레이 필터 처리를 한 결과이다.

Data smoothing results of the estimated left hip joint angle trajectory (Top: Vicon results, Bottom: MCGAS results).

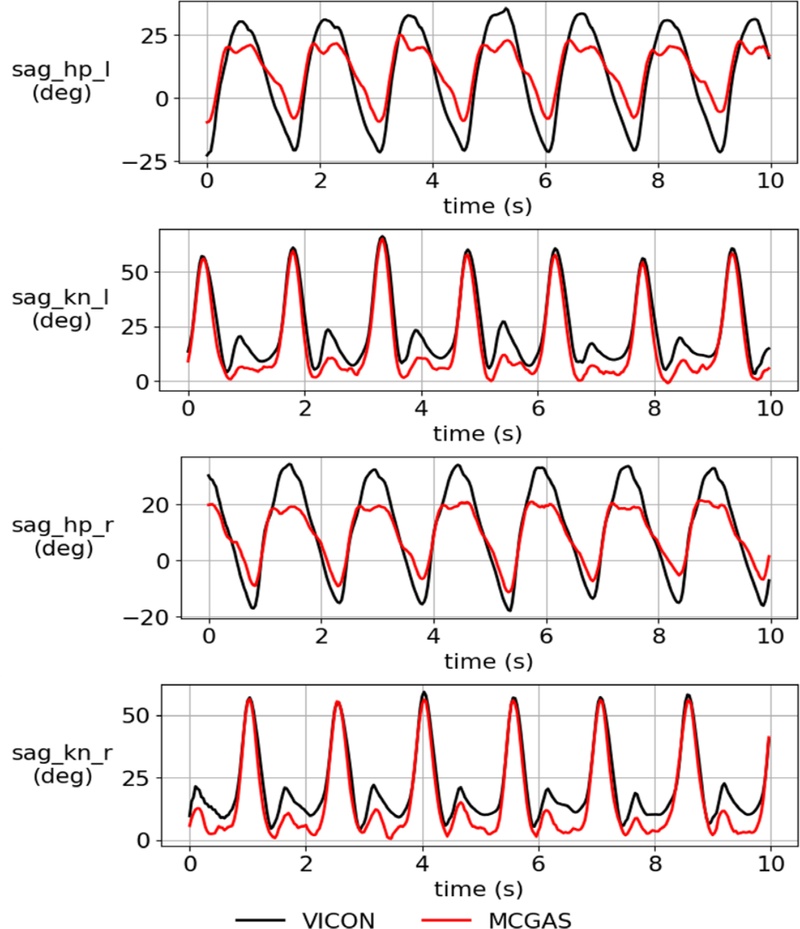

그림 2를 보면 아직 두 데이터의 시작점이 정확하게 일치하지 않음을 알 수 있다. 두 종류의 데이터가 동시에 측정되었지만 데이터 저장을 시작하는 순간 미세한 지연이 있었기 때문이다. 두 데이터의 시간 축을 동기화하기 위해 왼쪽 고관절 기준으로 국소 최솟값(valley)을 탐색한 뒤 첫 번째 최솟값에 맞춰 두 데이터의 모든 궤적을 정렬하였다.

국소 최솟값 탐색은 신호를 반전시킨 후, Python SciPy 라이브러리의 find_peaks 함수를 사용하여 최소 30 샘플 이상 간격과 폭이 5 샘플 이상인 국소 최솟값을 찾도록 하였다[16]. 그리고 데이터 동기화 후 더 짧은 길이를 가지는 데이터 기준으로 두 데이터의 길이를 동일하게 맞추었다. 그림 3은 Vicon과 MCGAS로 추정한 하지 주요 관절(고관절, 슬관절)에 대한 시간축 동기화 결과를 보인다. 그림에서 y축 라벨의 sag_hp_l과 sag_hp_r은 시상면 좌우 고관절(hip joint)을 의미하고, sag_kn_l과 sag_kn_r은 시상면 좌우 슬관절(knee joint)을 각각 의미한다.

3. 모델 설계

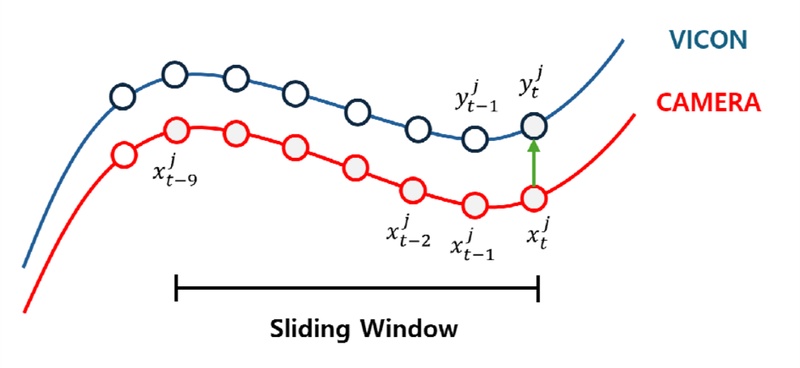

본 논문에서는 카메라 영상으로부터 추정한 관절각 궤적의 각 시점에서 이전 10개 샘플 데이터의 추세를 파악하고 이 정보를 이용하여 추정 관절각을 동일 시점의 Vicon 관절각 값으로 교정하는 것을 목표로 한다. 그림 4는 이 개념을 설명하는 것으로, 먼저 j 관절 t 인덱스의 각도 값인 값을 기준으로 크기가 10인 이동 창(sliding window)을 궤적에 씌워 최근 10개의 궤적 시퀀스()를 선택한다. 일반적으로 LSTM은 같은 궤적에서 그다음 값(그림 4의 경우 )을 추정하는 것을 목표로 하지만, 우리의 경우 t 시점에서 를 Vicon 측정값인 로 교정하는 것이 다르다.

Concept of generating the recent sequence of estimated joint angle trajectories and correcting them to the ground truth.

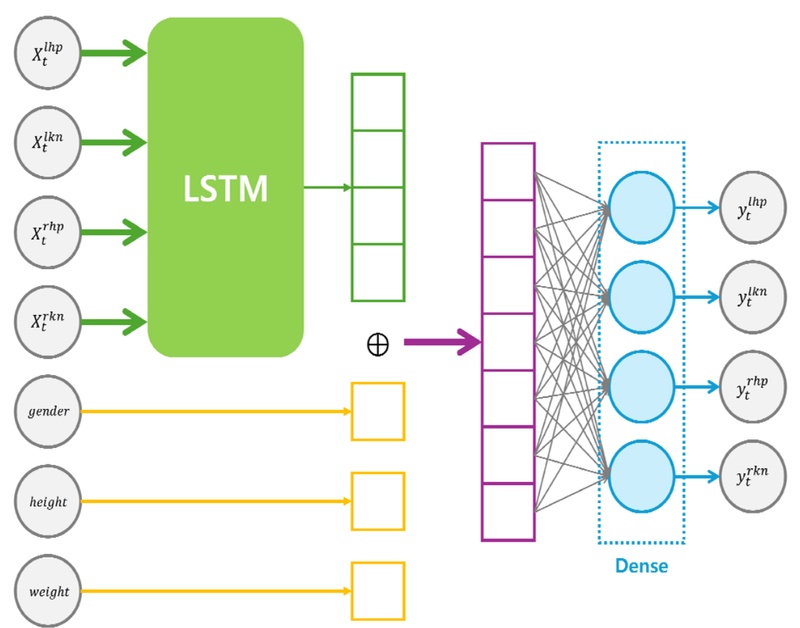

그림 5는 본 논문에서 제안하는 MCGAS 추정 관절각 오차 교정 딥러닝 모델로서, 입력은 네 종류의 관절 추정 각도의 궤적 시퀀스 데이터 과 3개의 속성값(성별, 키, 체중)이고, 출력은 네 종류의 추정 관절각 교정값 이다. 변수명에서 위첨자 은 각각 좌우 고관절과 슬관절을 의미한다. 상기 모델에서 전결합층(dense layer)의 입력은 LSTM 유닛의 출력 벡터에 상기 성별, 키, 체중 속성 데이터가 결합된 벡터이다.

딥러닝 모델에서 이렇게 좌우 네 개의 관절각 시퀀스 데이터를 동시에 입력하는 이유는 각 관절의 움직임이 다른 관절의 움직임과 관련성이 높기 때문이다. 이를 통해 모델은 시간에 따른 관절 사이의 상호작용과 기구적 연쇄 관계를 더 정확하게 학습할 수 있으며, 보행 패턴의 동적 변화를 반영하여 교정된 관절각을 보다 세밀하게 예측할 수 있다.

4. 모델 훈련

본 연구에서는 TensorFlow 프레임워크를 활용하여 그림 5에 제시한 모델을 구현하였다. 모델의 LSTM 유닛 수는 시행착오 끝에 500으로 설정하였으며, 학습률은 0.001, 배치 크기는 32로 설정하였다. 손실 함수로 그림 5의 딥러닝 모델 출력값 과 Vicon 출력값 과의 평균 제곱 오차(mean squared error, MSE)를 사용하였다. 여기서 N은 학습에 사용된 관절 궤적의 전체 데이터 수를 의미한다.

모델은 최대 200 에포크(epoch)에 걸쳐 반복 훈련하되, 검증 손실이 10회 연속으로 개선되지 않으면 조기 종료하도록 설정하였다. 그리고 5회 연속으로 검증 손실이 개선되지 않으면 학습률을 0.8 비율로 감소하는 스케줄링 기법을 적용하였다. 각 에포크에서 가장 좋은 성능을 보인 모델을 저장하여 최종 모델로 활용하였다.

모델 훈련에는 4명의 피험자가 각각 2.8km/h, 3.5km/h 속도로 보행한 데이터를 이어 붙여서 사용하였다. 훈련 데이터와 검증 데이터는 전체 데이터셋을 단순히 6:4의 비율로 나누지 않고, 측정 회차별 데이터를 먼저 6:4의 비율로 나눈 후 훈련용과 검증용으로 다시 결합하는 방식을 적용하였다. 이를 통해 데이터의 균형을 맞추고 특정 피험자의 데이터 특성이 과도하게 반영되는 것을 방지하였다. 또한, 관절각 궤적 시퀀스별로 하나의 데이터만을 사용하여 다른 측정 회차의 데이터가 섞이지 않도록 구성하여 각 데이터의 시계열 특성을 유지하였다.

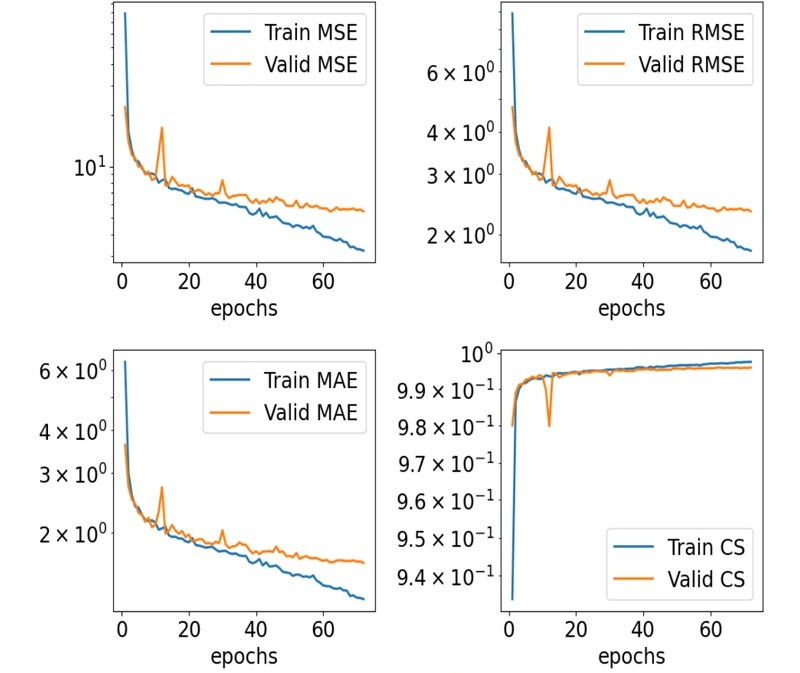

모델 훈련 결과, 72번째 에포크에서 조기 종료하였으며 62번째 에포크에서 가장 좋은 성능을 보였다. 학습률 스케줄링에 의해 최종 학습률은 4.1e-04까지 감소하였다.

그림 6은 훈련 과정에서 계산된 MSE, RMSE (Root Mean Squared Error), MAE (Mean Absolute Error), CS (Cosine Similarity)값 들을 나타낸 그래프이다. 이 중에서 CS는 예측값과 실제값 사이의 방향성을 비교하여 유사도를 측정하는 지표로, 1에 가까울수록 두 값이 서로 유사하다고 평가할 수 있다.

III. 실험 결과

본 논문에서 제안하는 모델의 성능을 확인하기 위해 성별, 키, 체중 등의 속성값을 제외한 4개의 관절각 시퀀스 데이터만을 사용하는 수학적 모델과 딥러닝 모델을 비교하여 관절각 교정 결과를 분석하였다.

1. 실험 방법

수학적 모델은 3차 다항 회귀(Polynomial Regression)를 사용하였으며, 학습률을 0.01로 고정하여 50,000 에포크에 걸쳐 훈련을 수행하였다. 딥러닝 모델은 제안한 모델의 구조에서 3개의 속성값 정보를 제외한 상태에서 동일한 조건으로 훈련을 진행하였다. 성능 비교는 모델 훈련에 사용되지 않은, 4명의 피험자가 각각 4.2km/h 속도로 보행한 데이터를 활용하였다.

실험에 사용된 3차 다항 회귀 모델은 입력 데이터를 다항식 형태로 확장한 후, 이를 기반으로 학습된 가중치와 결합하여 출력값을 생성한다. 즉, 식 (1)과 같이 입력값 MCGAS 추정 관절각 x에 대해 1차, 2차, 3차 다항식을 생성한 뒤, 이 다항식 항들을 가중치 Wj,n와 결합하여 출력값 을 예측한다.

| (1) |

여기서 j는 관절의 종류를 나타내며, n는 다항식의 차수를 의미한다. 모델 입력 x와 출력 는 식 (2)와 같다.

| (2) |

2. 실험 결과

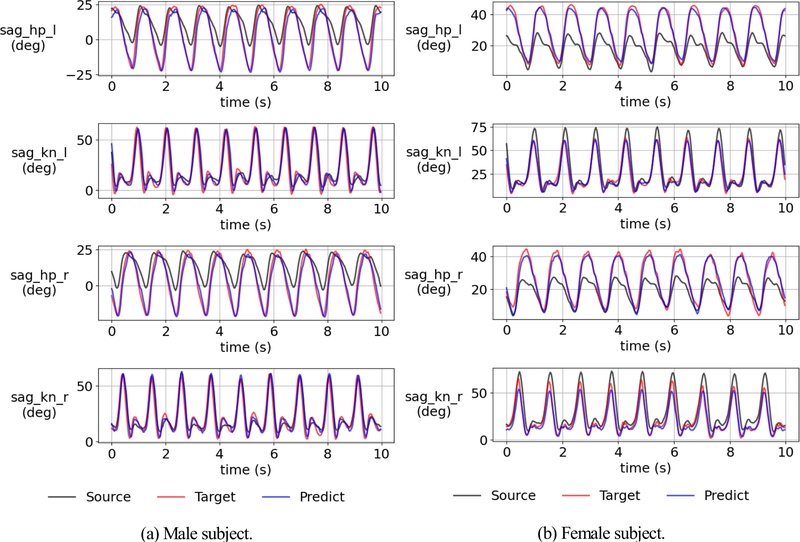

그림 7은 트레드밀에서 남성과 여성 실험자가 4.2km/h 속도로 60초간 보행한 영상에서 추출한 추정 관절각(source)과 Vicon 관절각(target), 그리고 본 논문에서 제안한 모델로 추정 관절각을 교정한 테스트 결과(predict)를 일부 나타낸 그래프이다. 그림을 보면 기본적으로 여성 실험자의 카메라 기반 관절각 추정 오차가 더 큼을 알 수 있는데, 이는 키 차이와 보행 스타일의 차이가 영상에 반영되기 때문으로 판단된다. 그림에서 보듯이 LSTM 모델로 교정한 관절각이 Vicon 관절각을 잘 추종함을 알 수 있다.

Comparison of joint angle trajectories: camera-based estimated joint angles (source), Vicon joint angles (target), and corrected estimated joint angles (predict).

표 2는 교정 이전의 관절각 추정값인 source 데이터와 바이콘 관절각(target 데이터) 간 평균절대오차(MAE)와 다항 회귀 모델과 2종류의 LSTM 모델을 사용하여 source 데이터를 교정한 후 target 데이터와의 MAE를 비교한 것이다. 교정 전 평균 MAE는 5.70°였으나 제안한 모델(LSTM w/Attr.)로 교정 후 평균 2.57°로 54.86% 감소하였다. 반면, 4개의 관절각 입력만을 이용해 3차 회귀 모델로 교정한 경우 평균 6.38% 감소에 그쳤으며, 3개의 속성값 없이 4개의 관절각 입력만을 이용해 LSTM 모델로 교정한 경우 (LSTM wo/ Attr.) 평균 52.46% 감소를 보였다. 이러한 결과를 통해 본 논문에서 제안한 관절각 시퀀스 교정법이 가장 효과적이라고 할 수 있다.

IV. 결론

본 논문에서는 LSTM을 활용하여 단안 카메라로 촬영한 영상으로 인체 관절의 각도를 추정하는 과정에서 발생하는 오차를 보정함으로써 영상 기반 인체 관절각 추정 기술의 정확도를 높이는 방법을 제안하였다. 제안하는 방법은 Vicon 모션 캡처 장비로 수집한 관절각 데이터를 참값으로 가정하고, 저자가 기 개발한 방법으로 추정한 카메라 기반 관절각이 Vicon 값과 유사하게 교정되도록 4개 관절각의 이동 창 데이터와 3개의 피험자 속성값을 LSTM의 입력으로 넣어 학습하는 것이다. 영상 기반 추정 관절각을 교정하기 전 Vicon 값과의 MAE는 5.70°였으나, 교정 후 평균 2.57°로 54.86%의 큰 감소 효과를 보였고, 코사인 유사도는 0.95에서 0.98로 3.15% 개선되었다. 이로써 저가의 카메라 기반 관절각 추정법의 성능을 고가의 모션 캡처 장비 수준으로 올릴 수 있는 가능성을 제시한다고 할 수 있다. 본 연구에서는 보행 시 고관절과 슬관절 등 하지 관절에 대해 관절각 추정 및 교정을 수행했으며, 향후에는 전신 관절로 확장하여 모델을 고도화할 계획이다.

Acknowledgments

본 논문은 대한민국 정부(산업통상자원부 및 방위사업청) 재원으로 민군협력진흥원에서 수행하는 민군기술협력사업의 연구비 지원으로 수행되었습니다(과제번호 24-SF-AI-01).

REFERENCES

-

A. Velusamy, J. Akilandeswari, P. Nareshkumar, D. Banumathy, V. Maheskumar, and P. Thiyagarajan, “Optimized machine learning model for disease prediction and treatment recommendation through gait analysis,” Proc. of the International Conference on Advancements in Power, Communication and Intelligent Systems, pp. 1-6, 2024.

[https://doi.org/10.1109/APCI61480.2024.10616729]

-

R. Das, S. Paul, G. K. Mourya, N. Kumar, and M. Hussain, “Recent trends and practices toward assessment and rehabilitation of neurodegenerative disorders: insights from human gait,” Frontiers in Neuroscience, vol. 16, pp. 1-26, 2022.

[https://doi.org/10.3389/fnins.2022.859298]

-

V. Bonnet, V. Joukov, D. Kulić, P. Fraisse, N. Ramdani and G. Venture, “Monitoring of hip and knee joint angles using a single inertial measurement unit during lower limb rehabilitation,” IEEE Sensors Journal, vol. 16, no. 6, pp. 1557-1564, March15, 2016.

[https://doi.org/10.1109/JSEN.2015.2503765]

-

M. A. Perrott, T. Pizzari, J. Cook, and J.A. McClelland, “Comparison of lower limb and trunk kinematics between markerless and marker-based motion capture systems,” Gait & Posture, vol. 52, pp. 57-61, 2017.

[https://doi.org/10.1016/j.gaitpost.2016.10.020]

- Vicon, https://www.vicon.com/, .

-

Z. Cao, T. Simon, S.-E. Wei, and Y. Sheikh, “Realtime multi-person 2D pose estimation using part affinity fields,” Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, pp. 7291-7299, 2017.

[https://doi.org/10.1109/CVPR.2017.143]

- MediaPipe Pose, https://github.com/google-ai-edge/mediapipe/blob/master/docs/solutions/pose.md

- J. Li, C. Xu, Z. Chen, S. Bian, L. Yang, and C. Lu, “Hybrik: A hybrid analytical-neural inverse kinematics solution for 3d human pose and shape estimation,” Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, pp. 3383-3393, 2021.

-

G. Pavlakos, V. Choutas, N. Ghorbani, T. Bolkart, A. A. Osman, D. Tzionas, and M. J. Black, “Expressive body capture: 3D hands, face, and body from a single image,” Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, pp. 10975-10985, 2019.

[https://doi.org/10.1109/CVPR.2019.01123]

-

S.M. Seong and S. Jeong, “A calibration method for IMU attatched to a mobile robot using LSTM network,” Journal of Institute of Control, Robotics and Systems (in Korean), vol. 29, no. 6, pp. 488-494, June. 2023.

[https://doi.org/10.5302/J.ICROS.2023.23.0034]

-

M.-S. Chae, M.-H. Ha, and T.-H. Park, “LSTM based forecasting and evaluation of sensor signals containing anomaly data,” Journal of Institute of Control, Robotics and Systems (in Korean), vol. 29, no. 12, pp. 1060-1066, Dec. 2023.

[https://doi.org/10.5302/J.ICROS.2023.23.0182]

-

J.-W. Kim, J.-Y. Choi, E.-J. Ha, and J.-H. Choi, “Human pose estimation using mediapipe pose and optimization method based on a humanoid model,” Applied Sciences, vol. 13, no. 4, pp. 2700, 2023.

[https://doi.org/10.3390/app13042700]

-

J.-Y. Choi, E. Ha, M. Son, J.-H. Jeon, and J.-W Kim, “Human joint angle estimation using deep learning-based three-dimensional human pose estimation for application in a real environment,” Sensors, vol. 24, pp. 3823, 2024.

[https://doi.org/10.3390/s24123823]

- resample, https://docs.scipy.org/doc/scipy/reference/generated/scipy.signal.resample.html

- savgol_filter, https://docs.scipy.org/doc/scipy/reference/generated/scipy.signal.savgol_filter.html

- find_peaks, https://docs.scipy.org/doc/scipy/reference/generated/scipy.signal.find_peaks.html

2023년 동아대 전자공학과 졸업. 2025년 동 대학원 석사. 관심분야는 Human-Centered AI, Intelligent Agent, Social Robotics, Human-Robot Interaction.

2022년 동아대 전자공학과 졸업. 2024년 동 대학원 석사. 2024년~현재 동 대학원 박사. 관심분야는 Robotics, Computer Vision, Pose Estimation, and Human-Robot Interaction.

1997년 포항공대 전자전기공학과 졸업. 2000년 동 대학원 석사. 2004년 동 대학원 박사. 2006년~현재 동아대 전자공학과 교수. 관심분야는 Humanoid Robotics, Global Optimization Method, AI, AI/Robot Ethics.