3D-2D 구면 투영을 활용한 매니퓰레이터 기반 미탐사 영역 능동 탐사 전략

Copyright© ICROS 2025

Abstract

The rapid aging of the agricultural workforce and the continued shrinkage of the rural population have heightened the need for affordable autonomous robotic solutions in agriculture. Visual simultaneous and localization mapping systems are widely used for environmental perception and localization, but their narrow field of view (FOV) limits their ability to map complex agricultural environments comprehensively. While multi-camera systems can address FOV limitations, their high costs and increased computational demands make them impractical for cost-sensitive applications. Herein, a low-cost and efficient methodology that employs active exploration using a robotic manipulator has been proposed to address these challenges. This unique approach reduces computational complexity while retaining essential environmental details by converting 3D point cloud data into 2D depth images through spherical projection. Such a transformation allows the system to effectively identify unexplored regions within the depth images, guiding the manipulator to explore these areas autonomously. As a result, this method enables comprehensive environmental mapping with minimal sensor requirements, offering a practical solution for agricultural automation.

Keywords:

visual SLAM, active exploration, spherical projection, manipulator controlI. 서론

농업 분야의 심각한 인구 구조 변화로 인해 노동력 부족 문제가 더욱 악화되고 있다. 통계청 자료에 따르면, 국내 농업 가구 수는 연평균 2.3% 감소하여 2023년 기준 100만 가구를 밑돈 것으로 집계되었다. 특히 농업 종사자의 고령화가 가속화되면서, 65세 이상 인구가 전체 농업 종사자의 50%를 넘어선 것으로 나타났다[2]. 이러한 구조적 문제를 해결하기 위해 농업 분야에서 로봇 자동화 시스템에 대한 수요와 시장 규모가 지속적으로 확대되고 있으며, 이에 따라 관련된 많은 연구들이 활발히 이루어지고 있다[3,4,5].

농업 분야의 자동화 요구를 충족하기 위한 대표적인 로봇 시스템으로 모바일 매니퓰레이터가 주목받고 있다. 이 시스템은 자율 이동이 가능한 모바일 플랫폼과 작업용 매니퓰레이터를 결합한 형태로, 다관절 링크 구조를 통해 인간의 팔과 유사한 동작을 모사하여 다양한 농작업을 수행할 수 있다. 모바일 매니퓰레이터가 자율적으로 작업을 위해서는 주변 환경 인식과 자기 위치 추정이 필수적이며, 이를 구현하기 위해 SLAM (Simultaneous Localization and Mapping) 기술이 활용된다.

그러나 현재 널리 사용되는 비전 기반 SLAM (Visual SLAM) 시스템은 카메라의 제한된 시야각으로 인해 로봇 플랫폼의 기동성에 제약을 초래하는 한계를 가지고 있다. 기존 연구에서는 다중 카메라 시스템을 도입하여 이러한 문제를 해결하고자 했으나, 이는 여러 가지 실용적 제약을 수반한다. 다중 카메라 시스템은 하드웨어 구성 비용을 증가시킬 뿐만 아니라, 대용량 센서 데이터를 실시간으로 처리하기 위해 고성능 연산 장치를 요구한다. 이는 시스템의 전력 소비를 증가시켜 배터리 기반 모바일 로봇의 운용 시간을 크게 단축시키는 주요 요인으로 작용한다. 특히 농업 현장에서는 비용 효율성이 중요한 요소로 작용하며, 고가의 다중 카메라 시스템은 실제 적용에서 경제적 제약을 초래할 가능성이 크다. 본 연구는 이러한 문제를 해결하기 위해 데이터 차원 축소를 통한 경량화된 처리 방식을 제안한다. 또한, 모바일 베이스에서 작성된 3차원 지도의 탐사 누락 영역을 매니퓰레이터 기반의 능동적 환경 탐사를 통해 보완함으로써, 최소한의 카메라로 시야각 제한 문제를 극복할 수 있는 방법론을 제안한다.

구체적으로, 본 연구는 3차원 포인트 클라우드 맵을 구면 투영법을 활용하여 2차원 깊이 영상으로 변환한 뒤, 이를 기반으로 미탐사 영역을 식별하고 매니퓰레이터의 탐사 경로를 생성하는 방법론을 제안한다. 이러한 접근법은 고비용이 소요되는 포인트 클라우드 처리 과정을 효과적으로 간소화하였다.

본 논문의 구성은 다음과 같다. 제2장에서는 농업용 모바일 매니퓰레이터와 Visual SLAM 기반 환경 탐사에 대한 선행 연구를 검토한다. 제3장에서는 구면 투영 기법을 활용해 3차원 지도를 2차원 깊이 이미지로 변환하는 방법을 제시한다. 제4장에서는 깊이 이미지 처리를 통해 미탐사 영역을 식별하고 탐사 경로 생성을 위한 작업점(task point)을 추출하는 과정을 설명한다. 제5장에서는 도출된 결과를 바탕으로 매니퓰레이터의 탐사 경로 생성 및 제어 전략을 제안한다. 마지막으로, 제6장에서는 연구의 결론과 향후 연구 방향을 제시한다.

II. 관련 연구

1. 모바일 매니퓰레이터 기반 농업용 로봇

농업용 로봇은 센서를 활용한 환경 인식과 상황 판단을 통해 자율적으로 작업을 수행하며, 지능화된 서비스를 제공함으로써 농업 분야의 수작업을 대체할 수 있는 효율적인 자동화 시스템이다[6]. 그러나 농업 환경은 지속적으로 변화하며, 다수의 작물이 있는 환경으로 인해 이동에 제약이 따르는 특성이 있다. 이러한 이유로 전통적인 농업 로봇은 주로 레일과 같은 제한된 자유도를 갖는 이동 방식을 채택해왔다[7].

최근에는 이러한 제약을 극복하기 위해 바퀴 기반으로 이동 가능한 모바일 베이스와 매니퓰레이터를 결합한 모바일 매니퓰레이터를 활용한 다양한 연구가 이루어지고 있다. J. Martin et al.은 온실 내 병해충을 식별하고 방제하기 위한 모바일 매니퓰레이터 시스템을 제안하였으며[8], 이 시스템은 해충 탐지 및 방제 조작 전략, 시스템 모니터링, 인간-로봇 GUI 인터페이스를 포함한 ROS 기반 제어 아키텍처로 구성되어 있다. 또한, X. Hu et al.은 감귤 수확을 위한 모바일 매니퓰레이터 시스템을 개발하였으며[9], 이는 자율 주행 플랫폼, 과실의 3D 좌표 측정, 그리고 수확 제어 시스템으로 구성되어 있다.

2. SLAM (Simultaneous Localization and Mapping)

SLAM[10]은 로봇이 미지의 환경에서 주변 지도를 작성하는 동시에 해당 지도에서 자신의 위치를 추정하는 기술이다. 이 중, 가장 활발히 연구되고 있는 분야는 LiDAR 센서를 활용한 LiDAR SLAM [11]과 카메라를 사용하는 비전 센서 기반의 Visual SLAM이다[12].

LiDAR 센서는 높은 정밀도와 넓은 시야각을 제공하여 단일 센서만으로도 주변 환경을 상세히 파악할 수 있는 장점을 가지고 있다. 그러나 높은 비용이 실제 시스템 구현에 있어 주요 제약 요인으로 작용한다. 반면, Visual SLAM은 상대적으로 저렴한 카메라를 활용하며, 인간의 시각 시스템과 유사한 비전 데이터를 획득할 수 있어 객체 인식과 같은 고차원 환경 인식 작업에 유리하다. 이러한 특성 덕분에 Visual SLAM은 다양한 로봇 응용 분야에서 널리 활용되고 있다.

그러나 Visual SLAM은 카메라의 제한된 시야각으로 인해 환경 인식에 한계가 있으며, 이를 개선하기 위한 다양한 연구가 진행되고 있다. Y. Dong et al.은 대형 모바일 로봇을 위한 다중 단안 카메라 기반의 SLAM 시스템을 제안하였다[13]. 이 시스템은 DispNet을 개선한 심층 정밀화 네트워크를 활용해 깊이 정보를 추정함으로써 인식 성능을 향상시켰다. 또한, C. Häne et al.은 자율주행 차량에 4개의 어안 카메라를 적용한 3D 인식 파이프라인을 제시하여, 시각적 중복을 최소화하면서도 효과적인 환경 인식이 가능함을 입증하였다[14]. 그러나 이러한 다중 카메라 기반 접근 방식은 다수의 센서를 필요로 하며, 이는 높은 구현 비용으로 이어져 상용화에 제약을 초래할 수 있다. 특히 농업용 로봇에 적용되는 센서는 농작업 환경의 특수성으로 인해 고성능과 높은 내구성이 요구되어 상당한 비용이 발생한다. 이에 따라, 센서 수를 최소화하는 것은 비용 효율성과 실용성을 확보하기 위한 중요한 기술적 고려사항이다. 또한, 다중 카메라 시스템은 하드웨어 구성의 복잡성과 높은 계산 비용을 요구하여 현실적인 제한이 크다. 이에 본 연구에서는 매니퓰레이터를 활용한 능동적 환경 스캐닝 방법을 제안한다. 이를 통해 최소한의 카메라만으로도 시야각 제약을 효과적으로 극복하며, 동시에 계산 효율성과 시스템 단순성을 확보하고자 한다.

III. 구면 투영 기반 3D-2D 맵 변환

1. 시스템 구성

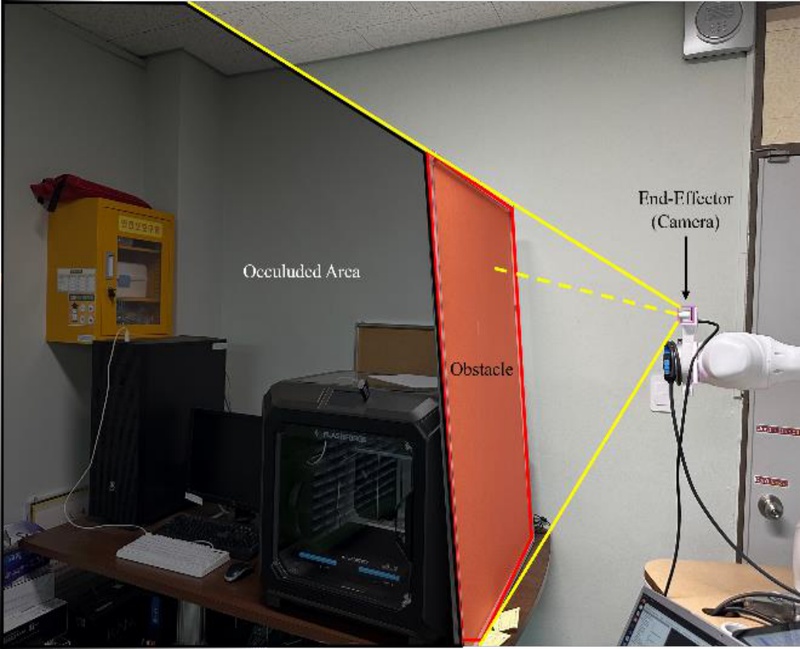

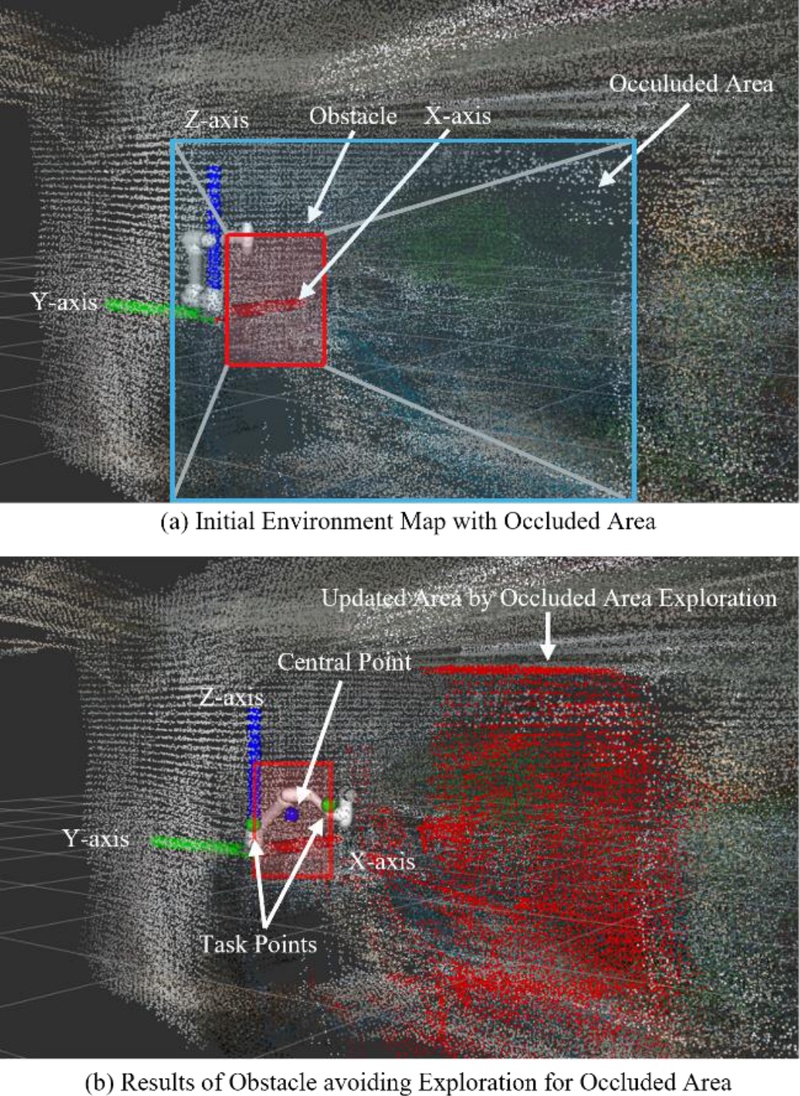

포인트 클라우드 연산은 고차원 데이터 처리로 인해 높은 계산 자원을 요구하므로, 본 연구에서는 계산 효율성 개선을 위해 구면 투영 기법을 활용한다. 미탐사 영역이나 장애물로 가려진 영역 등 추가 탐사에 필요한 정보를 추출하기 위해, 전체 3D 포인트 클라우드 맵에서 로봇의 현재 위치를 기준으로 매니퓰레이터 작업 영역 내 탐사 가능한 영역을 선별한다. 구체적으로, RTAB-Map [15]을 활용하여 생성된 3D 포인트 클라우드 맵에서 작업 영역 내 탐사 가능 영역을 2D 깊이 이미지 맵으로 변환한다. 이를 통해 데이터 차원을 축소하고 연산 비용을 절감하면서도 필요한 정보를 효과적으로 추출할 수 있다. 이 때 2D 깊이 이미지 맵의 픽셀 강도는 깊이 값을 의미하며, 이미지 맵에 경계 검출 기법을 적용해 배경 영역, 미탐사 영역, 그리고 장애물 영역을 분리한다. 미탐사 영역은 아직 탐사되지 않은 미확인 영역을 의미하며, 장애물 영역은 그림 1과 같이 장애물에 의해 카메라의 시야가 차단되어 탐지가 불가능한 폐색 영역을 발생시키는 영역을 의미한다. 마지막으로, 매니퓰레이터의 기구학적 제약 조건을 고려하여 해당 영역들에 대한 추가 탐사 작업을 수행한다.

2. 구면 투영

포인트 클라우드는 3차원 공간의 표면 형상을 이산 점들로 근사하여 표현하는 데이터 구조로, 각 점은 3차원 좌표계상의 위치 정보를 포함한다. 이 데이터 구조는 환경의 기하학적 특성을 고정밀로 표현하는 데 널리 사용된다. 그러나 포인트 클라우드 데이터의 고차원성과 대용량 특성으로 인해 실시간 처리에 높은 계산 비용이 요구되며, 특히 연산 능력과 전력에 제약이 있는 모바일 로봇 플랫폼에서는 실시간 처리에 어려움이 발생할 수 있다.

이를 해결하기 위해, 먼저 로봇의 현재 위치를 기준으로 매니퓰레이터가 도달 가능한 영역 내 관측 가능한 점들을 추출한다. 이 과정에서 카메라 센서의 유한한 측정 거리와 장애물로 인한 가시성 제한 등 물리적 제약을 고려하여 데이터를 필터링한다. 이후, 구면 좌표계의 점과 포인트 클라우드 간 일대일 대응 관계를 형성하고, 현재 위치에서 탐사 가능한 지점을 분석하기 위해 좌표계의 각 방향 벡터를 따라 로봇 베이스로부터 가장 가까운 점만을 선택한다. 이를 통해 처리해야 할 데이터 양을 줄임으로써 대용량 데이터로 인한 연산 부담을 완화할 수 있다.

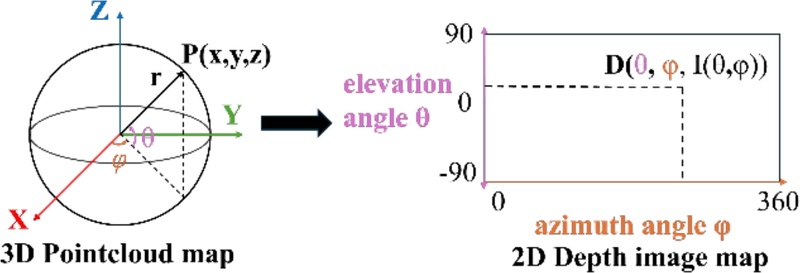

마지막으로, 구면 투영을 적용하여 3차원 데이터를 2차원 깊이 이미지 맵으로 변환한다. 변환 과정에서 방위각(azimuth angle, 𝜑)은 2차원 이미지의 x축, 고도각(elevation angle, 𝜃)은 y축, 거리는 픽셀 강도(I(𝜃, 𝜑))로 매핑한다. 변환 전 3차원 좌표계와 변환 후 2차원 좌표계는 그림 2와 같다.

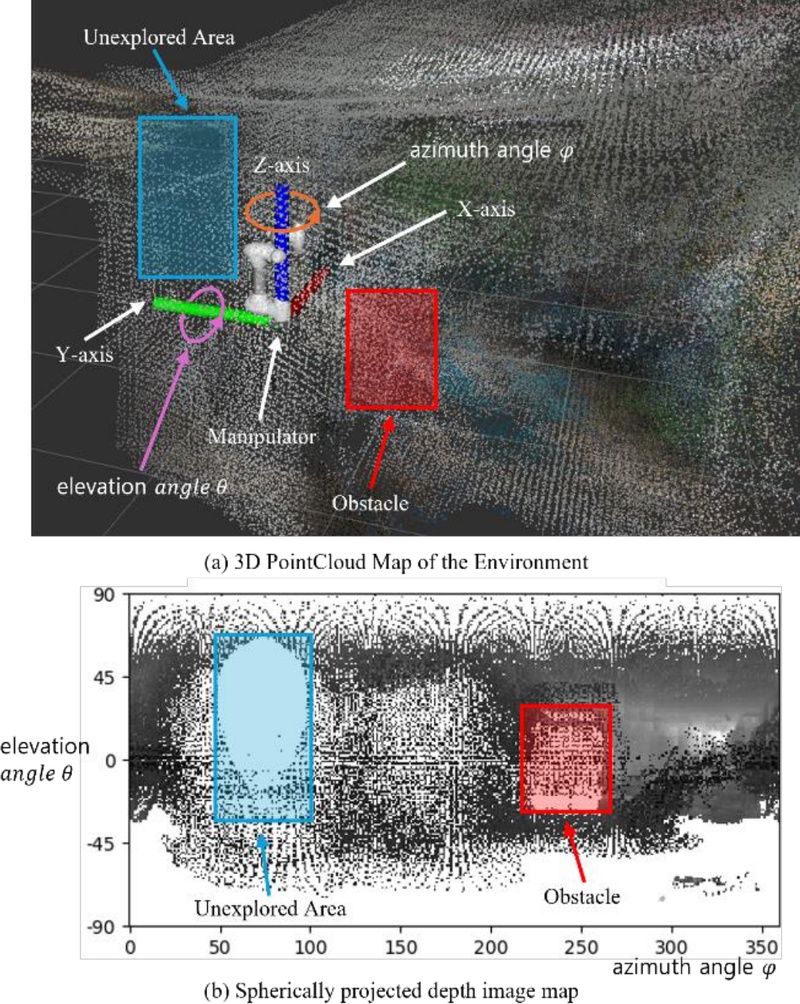

이러한 변환은 3차원 데이터를 2차원으로 축소하여 고차원 데이터로 인한 연산 부담을 줄이는 데 기여한다. 그림 3(a)는 매니퓰레이터의 베이스 프레임 좌표계를 기준으로 한 3D 포인트 클라우드 맵을 나타내고, 그림 3(b)는 구면 투영을 통해 변환된 결과를 나타낸다.

IV. 이미지 처리 기반 영역 식별 및 탐사 경로 생성

1. 영역 식별

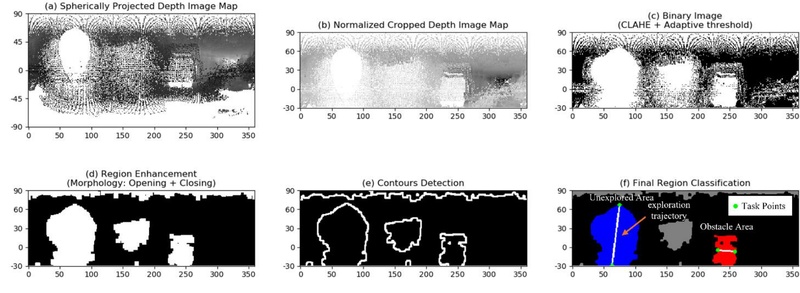

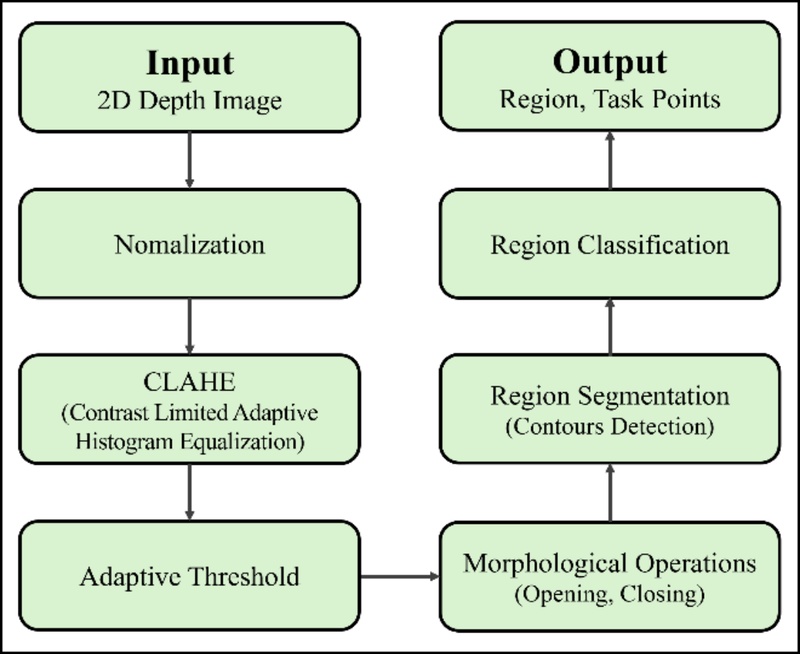

본 장에서는 그림 5의 과정을 통해 2D 깊이 이미지 맵에서 미탐사 영역과 폐색 영역을 식별하는 방법을 제안한다. 이 때, 매니퓰레이터가 설치된 테이블을 바닥으로 가정하고 테이블 아래 영역은 분석 대상에서 제외한다. 먼저, 제안한 방법의 첫 번째 단계는 깊이 이미지의 픽셀 강도값을 [0, 255] 범위로 정규화하는 것이며, 그 결과는 그림 4(b)와 같다. 다음으로, 정규화된 이미지는 지역적 대비를 향상시키기 위해 CLAHE (Contrast Limited Adaptive Histogram Equalization) [16]을 적용한 후 관심 영역인 미탐사 영역과 장애물 영역의 거리에 대해 적응적 이진화를 각각 적용해 배경 영역과 구분한다. 그 결과 그림 4(c)와 같이 배경 영역은 0(검정색), 관심 영역은 1(흰색)로 표현된다.

다음 단계는 전처리된 이미지에서 관심 영역과 배경 영역을 명확히 분리하는 것이다. 이를 위해 먼저 모폴로지 열림 연산(morphological opening)을 적용하여 이산적인 점 형태의 노이즈를 제거한 후 닫힘 연산을 적용하여 잔여 노이즈를 제거한다. 이를 통해 그림 4(d)와 같이 관심 영역과 배경 영역을 명확히 구분할 수 있다. 다음으로 OpenCV [17] findContours 알고리즘을 적용하여 그림 4(e)와 같이 각 영역의 외곽선을 추출하고, 이를 기준으로 각 영역을 분리한다.

최종적으로 검출된 각 영역은 미탐사 영역, 장애물 영역, 그리고 위양성 영역으로 분류된다. 미탐사 영역은 그림 3(b)에 보이는 것과 같이 포인트가 거의 검출되지 않아 평균 픽셀 강도가 빈 공간과 유사한 값을 보인다. 이를 기반으로 미탐사 영역과 장애물 영역의 픽셀 강도 임계값을 설정하여 두 영역을 식별한다. 평균 픽셀 강도가 임계값 이상이면 미탐사 영역, 임계값 미만이면 장애물 영역으로 분류된다. 여기서 위양성 영역은 근접한 벽면을 장애물 영역으로 분류한 경우를 의미한다.

분류된 장애물 영역은 실제 장애물 영역과 위양성 장애물 영역을 모두 포함한다. 장애물 영역은 장애물과 배경 사이의 거리 값이 급격히 변화하는 반면에 근접한 벽면에 대한 위양성 영역은 벽면의 연속된 구조로 인해 영역 경계 근처에서 급격한 거리 변화가 발생하지 않는다. 따라서, 2D 깊이 이미지 맵의 픽셀 강도의 변화율을 분석함으로써 실제 장애물 영역과 위양성 장애물 영역을 구분할 수 있다. 최종적으로 분류된 미탐사 영역(파란색), 장애물 영역(빨간색), 위양성 영역(회색)은 그림 4(f)와 같다.

2. 탐사 경로 생성

미탐사 영역을 탐사하기 위한 경로는 그림 4(f)와 같이 영역의 중앙점(Central Point)을 지나는 직선과 영역의 외곽선이 만나는 두 점 사이의 선분 중 최대 거리를 갖는 선분으로 설정한다. 이 경로는 가장 넓은 시야를 제공하여 포괄적인 탐사가 가능하게 한다. 여기서 탐사 경로의 양 끝점을 탐사를 위한 작업점으로 설정하고 둘 중 근거리에 있는 작업점으로부터 경로를 따라 맞은편 작업점까지 이동하며 탐사를 수행한다.

다음으로 장애물에 의해 가려진 폐색 영역을 탐사하기 위한 경로는 장애물을 회피해 폐색 영역을 탐사할 수 있는 위치까지 최단 거리로 이동할 수 있는 경로로 설정한다. 이를 위해 그림 4(f)와 같이 장애물 영역의 중앙점을 지나는 직선과 영역의 외곽선이 만나는 두 점 사이의 선분 중 최단 거리를 갖는 선분의 양 끝 점을 작업점으로 설정한다. 이 두 개의 작업점 중 근거리에 있는 작업점을 폐색 영역 탐사 기준으로 선정함으로써 탐사를 위한 매니퓰레이터의 이동 거리를 최소화할 수 있다.

V. 매니퓰레이터 제어

1. 로봇 하드웨어 구성

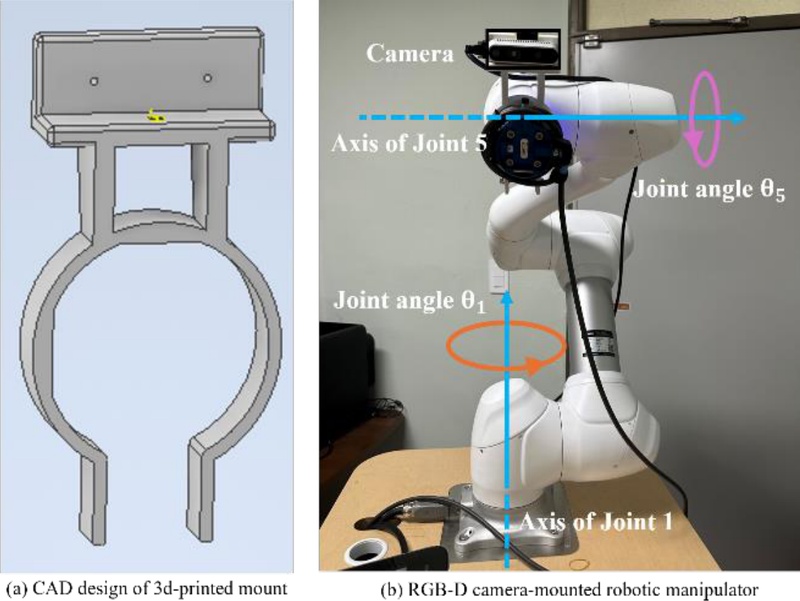

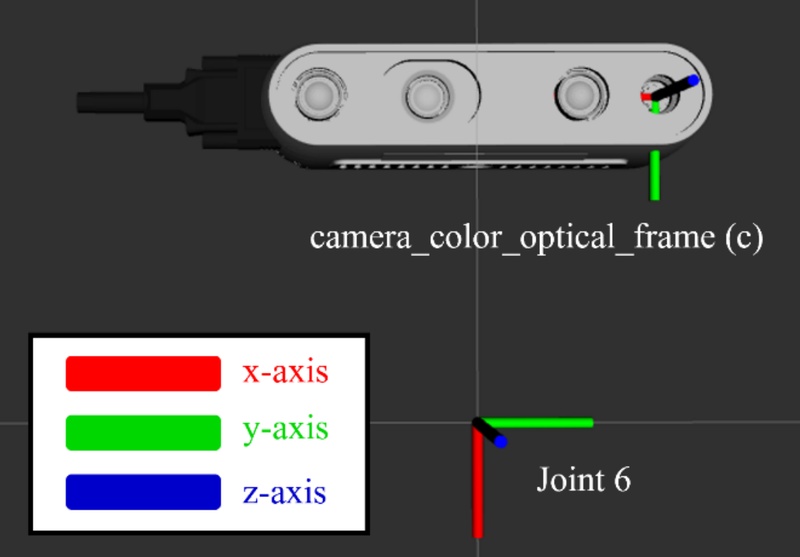

로봇 실험에 사용된 하드웨어는 6자유도 협동 로봇 Doosan M0609 매니퓰레이터와 깊이 카메라 Intel RealSense D435i로 구성된다. 깊이 카메라는 그림 6에서 보이듯 3D 프린터로 제작된 마운트를 이용해 매니퓰레이터 말단에 장착되었다. 매니퓰레이터의 베이스 프레임과 깊이 카메라의 광학 프레임 간 기구학적 변환 관계는 식 (1)과 같이 정의되며, 조인트 6과 카메라 광학 프레임의 좌표계는 그림 7과 같다.

| (1) |

여기서, 거리 단위는 m이다.

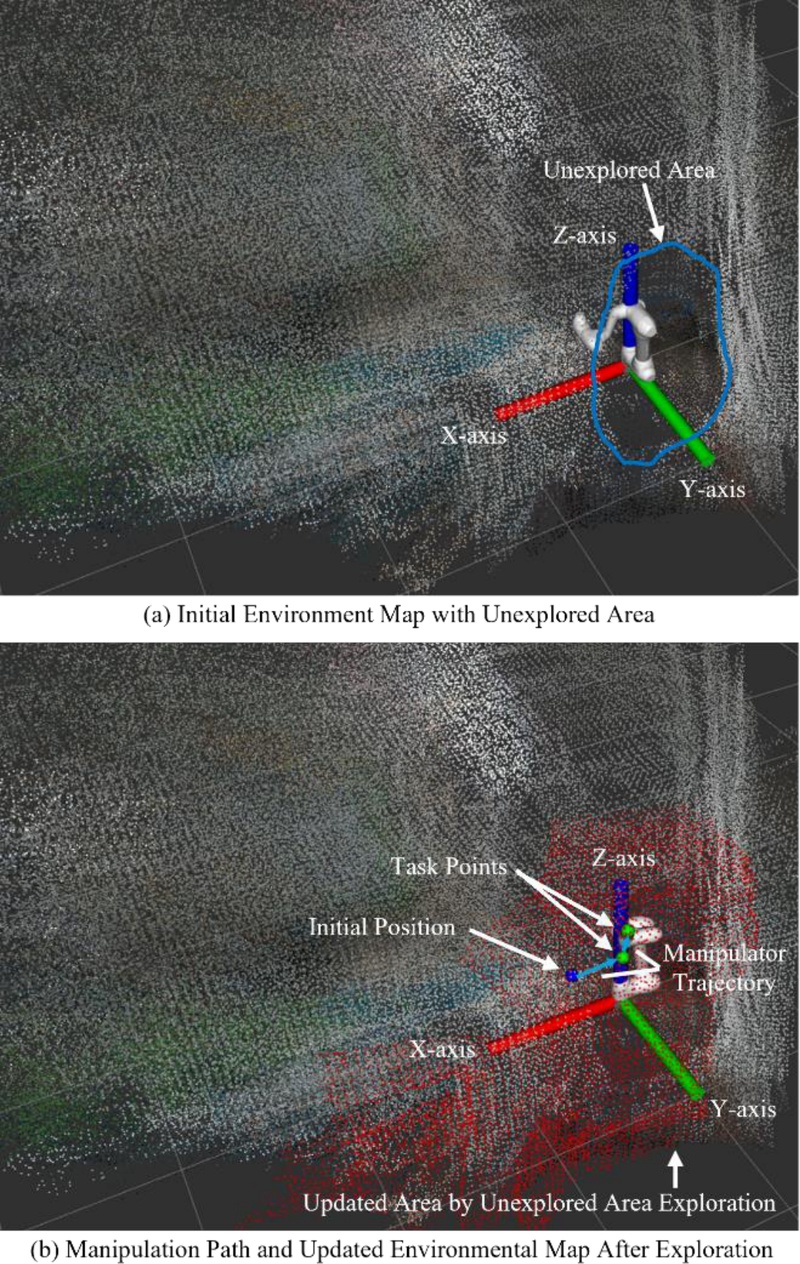

2. 미탐사 영역 탐사

그림 8(a)와 같은 미탐사 영역이 검출되면 이를 탐사하기 위한 경로와 작업점을 그림 4(f)와 같이 구한다. 탐사 경로는 미탐사 영역의 중앙점을 지나며 영역을 가로지르는 선분 중 최대 거리를 갖는 선분으로 설정하여 가장 넓은 시야를 제공한다. 효율적인 탐사를 위해 매니퓰레이터는 그림 8(b)와 같이 초기 위치에서 두 작업점 중 근접한 작업점(하부 작업점)으로 먼저 이동한 후, 경로를 따라 맞은편 작업점까지 이동하며 탐사를 진행한다. 이 때, 탐사 경로는 그림 4(f)에 보이듯이 2D 깊이 이미지 맵에서 방위각과 고도각 변화만으로 정의되며, 그림 6(b)에 보이는 6자유도 매니퓰레이터의 기구학적 특성상 1축과 5축 조인트만을 제어함으로써 탐사 경로 추종이 가능하다. 탐사를 위한 매니퓰레이터 자세는 식 (2)와 같이 조인트 공간에서 정의된다.

| (2) |

여기서, 방위각은 𝜑 = 𝜃1, 고도각은 𝜃 = −𝜃5으로 정의된다. 이 두 관절 각도를 제외한 나머지 관절들은 미탐사 영역의 효율적 탐사를 위해 사전 정의된 고정값을 유지한다. 이러한 기구학적 구성은 복잡한 역기구학 연산을 배제하고 두 관절의 직접적인 제어만으로 미탐사 영역 탐사를 위한 경로 추종이 가능하도록 한다. 결과적으로 경로 계획 및 실행 과정이 단순화되어 전체 시스템의 계산 효율성이 현저히 향상된다. 탐사 경로를 따라 추가로 탐사된 미탐사 영역은 그림 8(b)의 포인트 클라우드(붉은색)로 표시되어 있다.

3. 폐색 영역의 탐사

그림 1과 같이 장애물이 검출되면 장애물에 의해 가려진 폐색 영역을 탐사하기 위한 대체 관측 위치를 설정하고 매니퓰레이터를 제어해 대체 관측 위치로 이동한다. 그림 4(f)에서 장애물 영역의 중앙점을 지나며 영역을 가로지르는 선분 중 최단 거리를 갖는 선분의 양 끝점 중 근거리의 점을 작업점으로 정의했다. 대체 관측 위치는 작업점에서 영역의 중심점 반대 방향으로 일정 거리만큼 떨어진 지점으로 설정한다. 이를 통해 매니퓰레이터는 장애물과의 충돌 없이 대체 관측 위치로 이동해 폐색 영역 탐사가 가능하게 된다. 이때, Levenberg-Marquardt [18] 알고리즘을 기반으로 매니퓰레이터의 역기구학을 구하고 MoveIt [19]을 활용하여 매니퓰레이터를 이동시킨 후 폐색 영역을 스캔한다. 이 과정을 통해 추가된 폐색 영역에 대한 포인트 클라우드(붉은색)는 그림 9(b)에 표시되어 있다.

VII. 결론

본 논문에서는 매니퓰레이터의 제한된 화각을 최소한의 카메라로 극복하기 위해, 구면 투영 기반 깊이 이미지를 활용한 능동적 미탐사 영역 탐사 전략을 제안한다. 기존 Visual SLAM 연구는 화각 제한 문제를 해결하기 위해 다중 카메라를 활용하여 사각지대를 최소화하는 데 초점을 맞혀왔다. 그러나 다중 카메라 기반 접근법은 다수의 고성능 센서를 요구하며, 이는 높은 비용을 초래하여 농업 로봇의 상용화를 저해할 수 있는 요인으로 작용한다. 아울러, 다중 카메라 시스템은 하드웨어 구성을 복잡하게 하고 계산 비용을 증가시키는 단점이 있다.

이에 본 연구에서는 계산 효율성을 향상시키기 위해 구면 투영 기법을 활용하여 3D 포인트 클라우드 맵을 2D 깊이 이미지로 변환하고, 이미지 처리 기법을 통해 미탐사 영역과 장애물 영역을 식별하였다. 식별된 영역에 대해 매니퓰레이터 기반 스캔 방법을 제안하였으며, 실험을 통해 제안된 방법의 유효성을 검증하였다. 이를 통해 농업용 모바일 매니퓰레이터의 센서 및 프로세서 사양을 최적화하여, 비용 효율적인 농업 자동화 구현에 기여할 것으로 기대된다.

향후 연구에서는 모바일 베이스를 결합한 모바일 매니퓰레이터 시스템으로 확장하여, 실제 농작업 환경과 유사한 조건에서 환경 인식 및 탐사 성능을 검증하는 연구를 진행할 계획이다.

Acknowledgments

본 연구는 2024년 정부(교육부)의 재원으로 한국연구재단의 지원을 받아 수행된 기초연구사업과 지자체-대학 협력기반 지역혁신 사업의 결과입니다. (RS-2019-NR040079, RS-2023-00248666, 2023RIS-008).

상기 논문은 2023년도 ICROS-KROS 호남제주 그랜드 합동 학술대회에서 초안이 발표되었음[1].

REFERENCES

- B. S. Choi, “RTAB-MAP based dense 3D map building using manipulator,”Proc. of 2023 ICROS-KROS Honam Jeju Regional Conference (in Korean), Gunsan, Jeonbuk, Korea, Dec. 2023.

- J. H. Choi, “Agriculture, Forestry and Fishery Survey in 2023,” Statistics Korea, Republic of Korea, Report, 2023.

- Markets and Markets, “Agriculture robots markets.” https://www.marketsandmarkets.com/Market-Reports/agricultural-robot-market-173601759.html?gadsource=1, (Accessed on Nov. 10, 2024)

-

S. Lim, M. Kim, D. Lee, and M. Won, “Vision-based farmland boundary detection algorithm for automation of an agricultural tractor,” Journal of Institute of Control, Robotics and Systems (in Korean), vol. 29, no. 3, pp. 208–216, May 2023.

[https://doi.org/10.5302/J.ICROS.2023.22.0226]

-

M. Kim, S. Lim, and M. Won, “Seedling area recognition algorithm for autonomous rice planter based on deep learning and image processing,” Journal of Institute of Control, Robotics and Systems (in Korean), vol. 29, no. 3, pp. 245–251, May 2023.

[https://doi.org/10.5302/J.ICROS.2023.22.0223]

- K. Kim, J. Kim, B. Yoo, and S. Lee, “Core technologies of agricultural robots,” Korea Robotics Society Review (in Korean), vol. 9, no. 3, pp. 3-9, Jul. 2012.

-

K. Fue, W. Porter, E. Barnes, and G. Rains, “An extensive review of mobile agricultural robotics for field operations: Focus on cotton harvesting,” AgriEngineering, vol. 2, no. 1, pp. 150–174, Mar. 2020.

[https://doi.org/10.3390/agriengineering2010010]

-

J. Martin, A. Ansuategi, I. Maurtua, A. Gutierrez, D. Obregón, O. Casquero, and M. Marcos, “A generic ROS-based control architecture for pest inspection and treatment in greenhouses using a mobile manipulator,” IEEE Access, vol. 9, pp. 94981-94995, Jul. 2021.

[https://doi.org/10.1109/ACCESS.2021.3093978]

-

X. Hu, H. Yu, S. Lv, and J. Wu, “Design and experiment of a new citrus harvesting robot,” 2021 International Conference on Control Science and Electric Power Systems (CSEPS), Shanghai, China, pp. 179-183, May. 2021.

[https://doi.org/10.1109/CSEPS53726.2021.00043]

-

H. Durrant-Whyte and T. Bailey, “Simultaneous localization and mapping,” IEEE Robotics & Automation Magazine, vol. 13, no. 2, pp. 99-110, Jun. 2006.

[https://doi.org/10.1109/MRA.2006.1638022]

-

L. Huang, “Review on LiDAR-based SLAM Techniques,” 2021 International Conference on Signal Processing and Machine Learning (CONF-SPML), Stanford, CA, USA, pp. 163-168, Nov. 2021.

[https://doi.org/10.1109/CONF-SPML54095.2021.00040]

-

A. Merzlyakov and S. Macenski, “A Comparison of modern general-purpose visual SLAM approaches,” 2021 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS), Prague, Czech Republic, pp. 9190-9197, Sep. 2021.

[https://doi.org/10.1109/IROS51168.2021.9636615]

-

Y. Dong, H. Ding, F. Zha, and M. Li, “A practical multi-camera SLAM system for large mobile robots,” 2022 2nd International Conference on Big Data, Artificial Intelligence and Risk Management (ICBAR), Xi'an, China, pp. 179-184, Nov. 2022.

[https://doi.org/10.1109/ICBAR58199.2022.00041]

-

C. Häne, L. Heng, G. Lee, F. Fraundorfer, P. Furgale, T. Sattler, and M. Pollefeys, “3D visual perception for self-driving cars using a multi-camera system: Calibration, mapping, localization, and obstacle detection,” Image and Vision Computing, vol. 68, pp. 14-27, Dec. 2017.

[https://doi.org/10.1016/j.imavis.2017.07.003]

-

C. M. Labbé and F. Michaud, “RTAB-map as an open-source LiDAR and visual simultaneous localization and mapping library for large-scale and long-term online operation,” J. Field Robot, vol. 36, no. 2, pp. 416–446, Mar. 2019.

[https://doi.org/10.1002/rob.21831]

-

S. M. Pizer, E. P. Amburn, J. D. Austin, R. Cromartie, A. Geselowitz, T. Greer, B. M. ter Haar Romeny, J. B. Zimmerman, and K. Zuiderveld, “Adaptive histogram equalization and its variations,” Computer Vision, Graphics and Image Processing, vol. 39, pp. 355–368, Sep. 1987.

[https://doi.org/10.1016/S0734-189X(87)80186-X]

- L. Culjak, D. Abram, T. Pribanic, H. Dzapo, and M. Cifrek, “A brief introduction to OpenCV,” 2012 Proceedings of the 35th International Convention MIPRO, pp. 1725-1730, May. 2012.

-

D.W. Marquardt. “An algorithm for least-squares estimation of nonlinear parameters,” Journal of the Society for Industrial and Applied Mathematics, vol. 11, no. 2, pp. 431-441, Jun. 1963.

[https://doi.org/10.1137/0111030]

-

M. Görner, R. Haschke, H. Ritter, and J. Zhang, “MoveIt! Task constructor for task-level motion planning,” 2019 International Conference on Robotics and Automation (ICRA), Montreal, QC, Canada, pp. 190-196, May. 2019.

[https://doi.org/10.1109/ICRA.2019.8793898]

2023년 전북대학교 전자공학부 졸업. 2023년~현재 전북대학교 대학원 전자정보공학부 석사과정 재학 중. 관심분야는 로보틱스, 자율주행, 인공지능.

2022년 전북대학교 전자공학부 졸업. 2024년 전북대학교 대학원 전자정보공학부 석사 졸업. 관심분야는 로보틱스, 자율주행, 인공지능.

2000년 성균관대학교 전기·전자 및 컴퓨터공학부 학사 졸업. 2002년 서울대학교 전기·컴퓨터공학부 석사 졸업. 2006년 서울대학교 전기·컴퓨터공학부 박사 졸업. 2006~2007년 서울대학교 전기·컴퓨터공학부 BK21 박사 후 연구원. 2007~ 현재 전북대학교 전자공학부 교수. 관심분야는 원격 이동로봇 제어, 다중이동로봇제어, 이동로봇 전복회피제어, 인공지능.