실내 모바일 로봇 조작을 위한 손 제스처 조작 방식 제안 및 구현

Copyright© ICROS 2025

Abstract

Mobile robots are widely used and provide convenience to people in places like restaurants and airports. However, there are situations in which their limited autonomy necessitates additional user interaction. While existing studies suggest using hand gestures to manipulate mobile robots, the practical application of such an approach is limited, as they cannot fully address the needs of the user needs and can just primarily be operated in teleoperation environments. In this work, a novel hand gesture operation method has been proposed that can operate a wheeled mobile robot through a manipulation method. In addition to implementing the suggested gesture recognition technique, representative hand gestures were selected by conducting experiments to identify natural gestures based on context for improving usability. A combination of the YOLOv8-based object recognition and pose recognition models was employed to achieve the hand gesture recognition function. Finally, a wheeled mobile robot was also designed to evaluate the hand gesture manipulation system for performing appropriate movements according to the gesture. The overall system was evaluated through experiments and interviews with participants about the workload and usability of the gesture manipulation system.

Keywords:

hand gesture recognition, wheeled mobile robot, embedded system, computer visionI. 서론

1. 연구배경

최근 로봇 기술의 발전으로 로봇은 활용 분야는 주로 제조 분야에서 인간과 직접 상호작용하며 생활하는 서비스 분야로 변화하고 있다. 그 중에서 MR (Mobile Robot)은 고정된 위치에서 작동하는 로봇과 달리 특정 공간 내에서 이동하는 로봇을 의미하며, 특히 바퀴로 지면을 이동하는 WMR (Wheeled Mobile Robot)은 설계, 모델링, 구성 및 프로그래밍이 MR 로봇 중에서 상대적으로 간단하다는 장점이 있다. 따라서 WMR은 식당 서빙, 청소 등 실내 환경에서 사람들의 생활반경 내 다양한 역할을 수행하고 있다. 그러나 사람과 WMR 간의 상호작용 방법의 한계로 인해 활용 영역이 제한되는 경우가 많다. 이에 사람과 로봇 간 상호작용에 대한 연구는 WMR의 적용 범위를 넓힐 수 있는 응용 가능성을 가지고 있으며 효율성 측면에서 중요하다.

2. 연구목적

NUI (Natural User Interface)는 키보드나 마우스와 같은 기존의 물리적 컨트롤러를 사용하지 않고 제스처, 음성, 터치와 같은 인간의 자연스러운 행동을 통해서 기기를 제어하는 것이다. 따라서 사람이 물리적 장치 없이도 몸만으로 로봇을 제어할 수 있는 장점이 있다. NUI의 단순성은 학습이 쉽고 직관적인 상호 작용을 지원하며, 최근 컴퓨팅 성능의 발전으로 인해 NUI 기술의 정확성과 반응성이 향상되어오고 있다. 그 중 제스처는 사람이 널리 사용하는 상호작용 중 하나이며, 특히 모바일 로봇 분야에서 많은 연구가 이루어지고 있다[1-12]. 그러나, 주로 원격 조작 방법을 사용한 연구가 대부분이며, 직접 조작 방법에 대한 실용적인 연구는 충분히 이루어지지 않았다. 이에 본 연구에서는 사용자로부터 파생된 손 제스처를 이용하여 실시간으로 WMR을 직접 제어하는 연구를 수행하여 그 사용성에 대해 평가하고자 한다.

3. 연구방법

자연스러운 손 제스처를 파악하기 위해 사용자로부터 시나리오에 따른 손 제스처를 조사하여 대표 제스처를 선정한다. 선정된 손 제스처를 인식하기 위해 손 모양 인식 모델과 사전 훈련된 포즈모델을 결합한 방식을 사용하였는데, 손 모양 인식 모델의 경우 기존 객체 인식 모델에 추가학습을 진행하여 미세조정을 수행하였다. 손 모양이 인식된 후 해당 프레임에 대해 포즈 모델을 사용하여 포즈 정보를 취득하고 제스처 분류조건을 통해 사용자가 의도한 손 제스처를 파악한다. 인식되는 제스처에 따라 적절한 움직임을 수행할 수 있도록 선행 연구 AngGo Pro [13]의 후속작인 AngGo Z를 제작하였으며 그림 1과 같다. 구현된 시스템을 바탕으로 설계한 실험 시나리오에 따라 작업부하 및 사용성 평가를 통해 제스처 평가를 진행하였다.

II. 기존연구

1. 원격 조작

원격 조작은 사람과 로봇이 다른 공간에 위치한 상태의 상호작용을 의미한다. 관련 연구로 Leap-Motion 카메라를 사용하여 손의 롤, 피치, 요 값을 해석하여 로봇의 움직임을 제어하거나 로봇과 다른 공간에서 카메라로 촬영한 손동작을 통해 로봇의 움직임을 제어한 연구가 있다[2-6]. 구체적인 사례로는 손 제스처 인터페이스를 사용하여 폭발물 처리 작업을 원격으로 수행하기도 한다[16]. 또한, 일부 연구에서는 손의 특정 부분을 사용하여 로봇을 제어했는데 검지의 각도를 사용해 선형 및 각속도를 조절하거나[12], 손바닥의 중심점과 엄지의 방향 및 길이를 사용하여 로봇 움직임을 제어하는 방법도 사용된다[7,11]. 이러한 연구들은 원격 조작 환경에서 손동작을 통해 로봇을 원격으로 제어할 수 있는 가능성을 보여준다. 하지만 최근에 서빙 로봇, 배송 로봇 등 로봇의 활발한 보급에 따라 일상 환경에서도 로봇을 비교적 쉽게 접할 수 있게 되었고, 대면 환경에서 자연스런 로봇 조작 방식에 대한 필요성이 증가하였다. 그럼에도 불구하고 일상에서 로봇을 직접 마주치는 사용자를 고려한 조작 방식에 대한 연구는 부족한 실정이다. 이에 대면 상황에서 로봇 제어에 대한 접근 장벽을 낮출 수 있는 직접 조작 방식에 대한 연구가 필요하다.

2. 직접 조작

직접 조작은 로봇과 사람이 동일한 공간에서 얼굴을 맞대고 실시간 상호작용하는 것을 말한다. 예를 들어, 휠체어에 장착된 RGB 카메라로 손가락의 위치를 추적해 이동을 제어하거나[1], 팔 벡터를 계산하여 로봇의 이동 방향에 반영하는 방식이 있다. 이 방식은 사용자가 머리 근처의 손의 위치를 통해 로봇을 조작할 수 있도록 한다[2]. 또 다른 연구로는 손가락의 개수를 이용해 모바일 로봇의 움직임을 제어하거나[5, 6], 진동촉각피드백을 사용한 조작 방식이 있다[17]. 그러나 이러한 연구들은 사용자에게 적합한 제스처를 조사하는 것이 아니라, 연구진 임의로 손 제스처의 형태를 결정하기 때문에 실제 사용자가 사용하기에 부자연스러울 수 있다. 한편, 빔 프로젝터를 활용하여 지하 광산 환경을 시뮬레이션하고 제스처 기반 무인 차량 조작 방식의 가능성을 탐구한 연구가 있다[3]. 해당 연구는 사용자가 제스처를 통해 차량을 직접 조작하는 방식이 아니라 연구진이 다른 공간에서 사용자의 제스처를 관찰하고 이를 기반으로 원격 조작을 수행하는 형태였다. 이는 제스처 인식을 통한 조작 방식의 실용 가능성에 대한 평가가 이루어졌다고 보기 힘들다. 따라서, 로봇의 자연스러운 조작을 위해 사용자로부터 적합한 손 제스처를 탐색하는 것뿐만 아니라, 조사된 제스처로 직접 조작을 수행했을 때에 대한 사용성 평가가 필요하다. 이를 통해 제스처 기반 조작 방식의 실용성 및 효율성을 검증하고자 한다.

III. 제스처 조사

1. 제스처 조작 시나리오

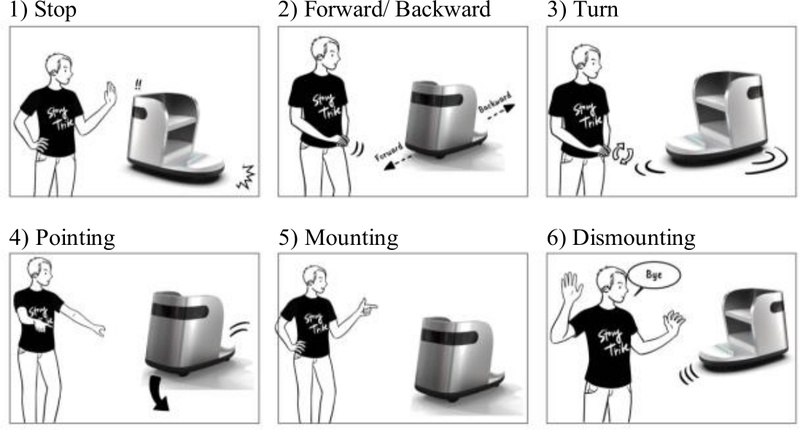

AngGo를 조작하기 위한 6가지 시나리오는 그림 2와 같다. ‘Stop’ 제스처는 사용자가 반 자율 주행 중인 AngGo를 멈추고 싶을 때 사용한다. ‘Forward’ 및 ‘Backward’ 제스처는 AngGo를 전진 및 후진하기 위해 사용한다. ‘Turn’ 제스처는 정지한 AngGo를 사용자 탑승방향으로 회전시키기 위해 사용한다. ‘Pointing’ 제스처는 특정 방향으로 AngGo가 이동하도록 할 때 사용한다. ‘Mounting’ 제스처는 사용자가 탑승을 원할 때 사용하는 것으로 정지와 회전의 역할이 결합된 제스처이다. ‘Dismounting’ 제스처는 사용자가 탑승을 종료하고 AngGo가 다시 반 자율 주행할 수 있도록 한다. 이러한 제스처를 통해 사용자는 AngGo와 떨어져 있어도 리모컨과 같은 추가적인 장치가 없어도 제어할 수 있다.

2. 제스처 분류

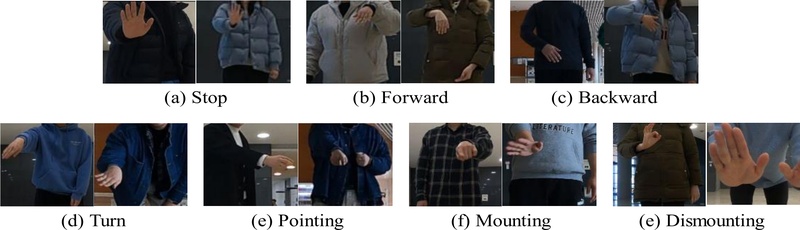

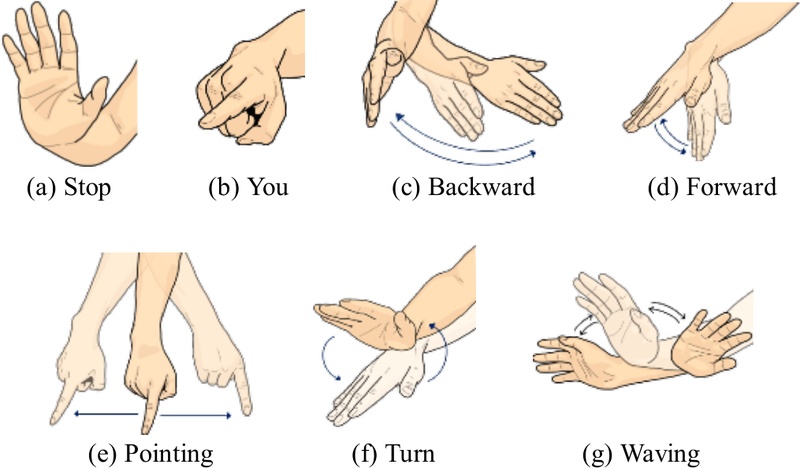

시나리오를 바탕으로 총 11 명의 참가자로부터 제스처 도출 연구를 수행하였다 (그림 3). ‘Stop’ 제스처는 팔을 곧게 펴고 손바닥이 앞을 향하며 다섯 손가락을 모두 펴는 동작이다. ‘Forward’ 제스처는 손가락 끝이 로봇을 향한 상태로 시작하며 몸 쪽으로 손을 당겨 손가락 끝이 바닥에 수직인 상태로의 동작을 반복한다. 이때 팔을 일직선으로 유지하면서 손목만 사용하는 경향이 있다. ‘Backward’ 제스처는 손이 몸과 평행을 이룬 상태에서 손가락 끝이 지면과 약 45도 각도를 이룬 상태에서 몸에서 멀어지고 가까워지는 것을 반복한다. ‘Turn’ 제스처는 주로 손목을 사용하여 손을 회전시킨다. ‘Pointing’ 제스처는 손가락과 팔을 사용하여 특정 지점을 가리킨다. 추가적으로 제스처 조작 의사 전달이 필요하여 ‘You’ 제스처를 추가하였고 검지를 AngGo에 가리키는 형태이다. 하지만, 그림 2의 시나리오 중 ‘Mounting’과 ‘Dismounting’ 제스처는 공통된 특징을 찾기가 어려웠는데, 인터뷰에서 대부분의 참가자들은 탑승과 하차를 나타내는 제스처가 익숙하지 않아 수행하기 어렵다고 답했다. 따라서, ‘Mounting’ 제스처는 ‘You’ 제스처로 대체하여 제스처 조작 모드의 시작과 탑승의 의미를 동시에 전달할 수 있도록 하였고, ‘Dismounting’ 제스처는 사용자로부터 파생된 제스처를 선택하는 대신 연구진이 지정한 ‘Waving’ 제스처로 대체하였다. ‘Waving’ 제스처는 ‘Stop’ 제스처와 동일한 손 모양을 유지한 상태에서 추가적으로 팔을 좌우로 흔드는 형태이다. 최종적으로 분류된 제스처는 표 1과 그림 4에서 볼 수 있다.

IV. 제스처 인식

본 연구에서는 제스처를 인식하기 위해 손 모양과 상체 포즈를 결합하는 방식을 사용한다. 객체 인식과 포즈 인식을 수행하기 위해 물체 인식 속도와 정확도가 높다고 알려진 컴퓨터 비전 인식 모델 YOLO를 채택하였으며, 특히 YOLOv8에서는 사람의 관절을 추적하는 포즈 추정 기능이 추가되었다[18]. 또한 실시간성을 보장하기 위해 NVIDIA의 Jetson Orin Nano를 사용했으며 YOLOv8의 경량 모델 버전인 YOLOv8m과 YOLOv8m-pose가 사용되었다.

1. 데이터 수집

YOLOv8m 모델은 사전 학습된 객체만 인식할 수 있기 때문에 특정 손모양을 감지하기위해 커스텀 데이터를 통한 미세 조정이 필요하다. 데이터 수집을 위해 Intel RealSense D455f 카메라를 사용하여 총 8명의 참가자로부터 이미지를 수집하였다. 객체 인식에 사용된 손모양은 그림 5에서 확인할 수 있다.

2. 모델 학습

특정 프레임에서 손 모양을 인식하기 위해 객체 인식 모델에 대해 학습이 진행되었다. 가로 세로 40×480 크기의 이미지 12,055개로 구성된 데이터 세트를 수집하여 scikit-learn 라이브러리를 사용하여 7:2:1의 비율로 훈련, 검증, 테스트 세트를 나누었다. 수집된 데이터는 모델이 다양한 환경에서도 잘 작동할 수 있도록 albumentations 라이브러리를 사용하여 밝기, 대비, 노이즈, 색조, 채도에 대한 증강을 수행하였다. 밝기와 대비는 −20%에서 20% 사이, 가우시안 노이즈 분산은 10에서 50 사이, 색조, 채도, 값 위치는 각각 20, 30, 20의 임계 값으로 설정하였다. 이를 각 이미지에 7회 무작위로 반복하여 8,728개의 데이터셋을 생성하였다. 1,214개의 테스트 데이터를 포함한 총 87,942개의 데이터 셋은 epoch 79, batch 371로 학습되었으며 mAP50은 0.9, mAP50-95는 0.9를 달성하였다.

3. 제스처 분류

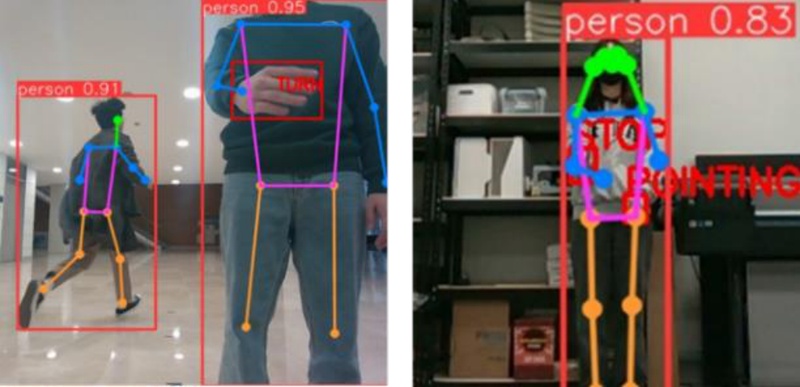

제스처를 분류할 때는 YOLOv8m을 통해 인식한 손 모양과 포즈 정보를 사용하였다. 사용된 포즈 모델은 YOLOv8m-pose로 2017년 COCO 데이터 세트를 기반으로 사전 학습되었으며 각 관절의 키포인트에서 위치 정보를 획득할 수 있다. 긴급히 정지를 해야 하는 상황을 대비하기 위해 우선적으로 인식되야 하는 ‘Stop’ 제스처를 제외한 모든 제스처에 대해 제스처 분류가 수행된다. 이때 각 프레임에 대한 제스처 분류를 수행하는 데 약 0.12초가 소요되며 sample rate는 약 8.33 Hz이다.

Intel RealSense D455f 카메라는 깊이 정보를 획득할 수 있기 때문에, 이를 사용하여 RGB 이미지에서 측정된 관절 위치 정보에 대한 깊이 정보를 분류에 활용할 수 있다. 손 제스처 조작 시 한 명의 사용자가 조작하는 상황을 가정했기 때문에 복수의 사용자에 대한 제스처가 감지되면 깊이 정보를 이용하여 AngGo와 가장 가까운 사용자의 제스처를 인식하도록 한다. 만약 그림과 같이 한 프레임에 여러 포즈가 감지되거나 여러 손모양이 감지되는 경우 인식되는 포즈박스 중심점 깊이 값이 작은 쪽을 활성 포즈로 분류할 수 있다. 마찬가지로 둘 이상의 손 모양이 감지되면 손 모양 박스 중심점 깊이 값이 더 작은 제스처를 활성 손모양으로 인식한다. 이는 보통 손 제스처를 수행하는 팔이 다른 팔보다 앞에 있기 때문이다. 여러 사람이 같은 거리에서 제스처를 수행할 경우, 조작의 시작을 의미하는 ‘You’ 제스처를 우선적으로 인식하고 제어 권한이 부여된다. 향후에는 ‘You’ 제스처를 수행한 사용자를 우선 추적함으로서 복수의 사용자가 있는 상황에서도 조작권에 대한 우선순위를 부여하고자 한다.

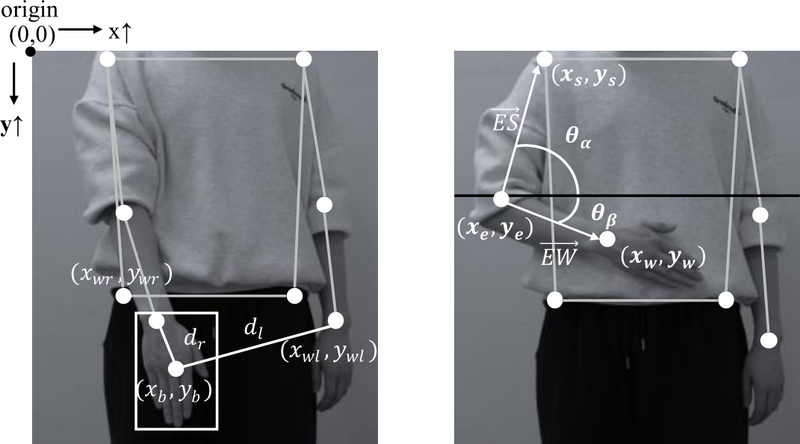

포즈정보에 따른 다른 알고리즘을 수행하기 위해서는 현재 제스처를 수행하는 손이 어딘지 정확히 알 필요가 있다. 이를 위해 인식된 손 모양과 양손의 손목 좌표 사이의 유클리드 거리를 비교하여 지배적인 손을 판단하였다. 이때 반대편 손모양이 감지되더라도 3.1의 분류를 통해 의도한 제스처를 선택할 수 있다. 그림 7 왼쪽에서 네모상자는 손 모양 감지 모델이 인식한 경계 상자를 나타내며 (𝑥𝑏, 𝑦𝑏)는 현재 인식된 손의 중심 좌표, (𝑥𝑤𝑟, 𝑦𝑤𝑟) 은 오른쪽 손목 좌표, (𝑥𝑤𝑙, 𝑦𝑤𝑙)은 왼쪽 손목 좌표를 의미한다. 이때 손의 중심과 양쪽 손목 사이의 유클리드 거리는 𝑑𝑙, 𝑑𝑟로 표현할 수 있다. 식 (1)과 같이 𝑑𝑙이 𝑑𝑟보다 크면 현재 제스처는 오른쪽 손목에 가깝고 지배적인 손이 오른손임을 의미한다.

| (1) |

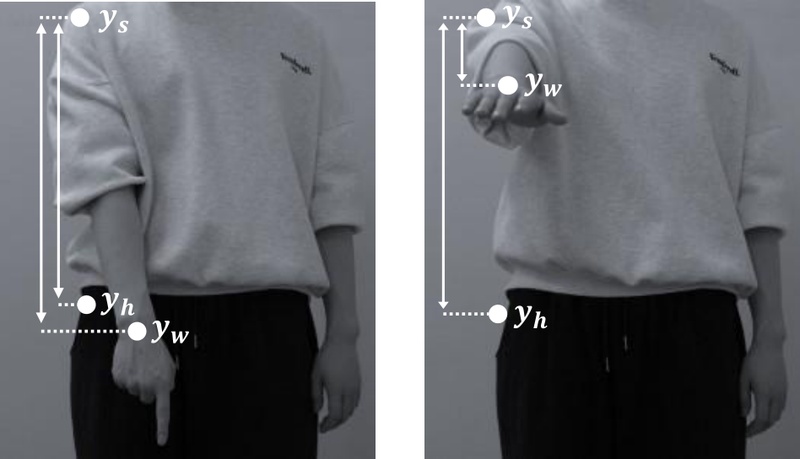

손 모양 감지 모델은 비슷한 모양의 ‘You’ 제스처와 ‘Pointing’ 제스처를 혼동하거나 ‘Turn’ 제스처 수행 중 ‘Forward’와 ‘Backward’ 제스처를 오인식 하는 경우가 존재한다. 이를 분류하기 위해 그림 8과 같이 사람의 어깨에서 엉덩이까지의 y값 차이와 어깨에서 손목까지의 y값 차이에 대한 비율을 활용하였다. 사람들은 제스처를 수행 시 팔을 앞으로 뻗는 특징이 있기 때문에 2차원 좌표를 사용하여 비율 을 측정할 수 있다. 𝑦𝑤는 손목의 y좌표, 𝑦𝑠는 어깨의 y좌표, 𝑦ℎ는 엉덩이의 y좌표일 때 두 값에 대한 비율을 구하는 방법은 식 (2)와 같다.

| (2) |

손 모양 객체 인식 모델이 손의 각도 차이에 따라 ‘Forward’ 제스처와 ‘Backward’ 제스처를 구별하여 학습하기 때문에 오인식이 발생할 수 있다. 이를 분류하기 위해 ‘Backward’ 제스처는 ‘Forward’ 제스처에 비해 팔꿈치 각도가 작다는 경향을 사용하였다. 팔꿈치 각도를 구하기 위해 어깨, 팔꿈치, 손목의 좌표는 각각 (𝑥𝑠, 𝑦𝑠), (𝑥𝑒, 𝑦𝑒), (𝑥𝑤, 𝑦𝑤)이며, 는 팔꿈치에서 어깨까지의 벡터이고, 는 팔꿈치에서 손목까지의 벡터로 나타낼 수 있다. 방향 각도 𝜃𝛼 , 𝜃𝛽 는 각각 두 벡터 , 와 x축 사이의 각도를 나타내며, 그림 7 오른쪽에서 팔의 각도에 대한 각 요소를 살펴볼 수 있다. 세 점 사이의 각도 𝜃𝑠𝑒𝑤를 구하는 식 (3)은 다음과 같다.

| (3) |

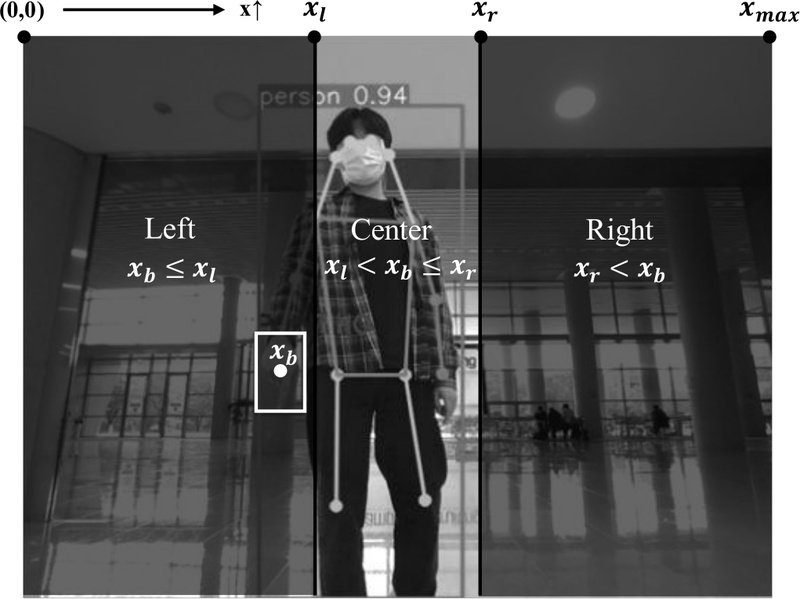

‘Pointing’ 제스처는 카메라 이미지 프레임 중심 x좌표에 대한 손 모양 박스 중심 x좌표의 위치에 따라 왼쪽, 중앙 또는 오른쪽으로 주행방향을 결정하며 위치 별 영역은 그림 9에서 볼 수 있다. 카메라 이미지의 최대 x좌표 값이 𝑥𝑚𝑎𝑥일 때 중심 x좌표는 이고 중심 좌표의 양쪽에 실험 결과에 의한 거리를 부여하여 기준 영역을 설정하였다. 양쪽의 영역을 나타내는 두 개의 x좌표는 𝑥𝑙, 𝑥𝑟이며, 손 상자의 중심 x좌표는 𝑥𝑏라 한다. 만약 𝑥𝑏가 𝑥𝑙보다 작거나 같으면 AngGo는 왼쪽으로 일정 거리를 이동하고, 𝑥𝑏가 𝑥𝑟보다 크거나 같으면 오른쪽으로 일정 거리를 이동한다. 손 상자의 중심이 가운데 영역에 있으면 AngGo는 앞으로 전진하게 된다. 식 (4)에서 ‘Pointing’ 박스 x좌표에 따른 AngGo의 방향이 어떻게 결정되는지 살펴볼 수 있다.

| (4) |

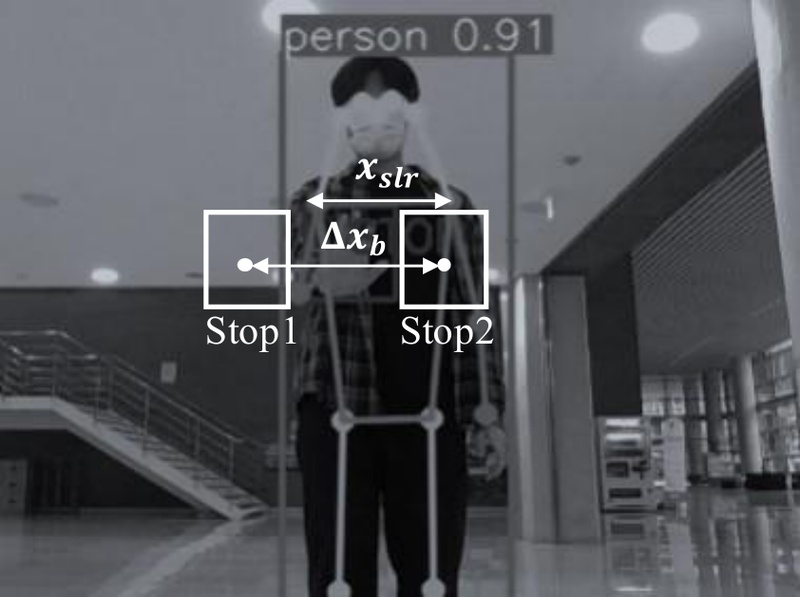

‘Waving’ 제스처는 그림 10과 같이 ‘Stop’ 손 모양 박스 중앙의 10 프레임 내 x좌표 변화량과 y좌표 변화량을 이용하여 인식한다. 손 모양 인식 거리에 따라 x좌표 변화량의 범위가 달라지기 때문에 양쪽 어깨의 x좌표 차이를 기준으로 임계값 𝑇𝑥를 설정하여 카메라와 사용자 사이의 거리에 따른 변화를 시스템이 일관적으로 인식할 수 있도록 한다. 또한 제스처를 수행하기 위해 갑작스레 손을 들었을 때 순간적인 x좌표의 변화로 인해 ‘Waving’ 제스처가 인식되는 것을 방지하기 위해 y좌표의 변화에 대한 임계 값 𝑇𝑦를 설정한다. 𝑥𝑠l은 왼쪽 어깨의 x좌표이고 𝑥𝑠r은 오른쪽 어깨의 x좌표일때, 두 어깨의 x값 차이는 𝑥𝑠lr로 표시되고, Δ𝑥𝑏는 x좌표의 변화를, Δ𝑦𝑏는 y좌표의 변화를 나타낸다. ‘Waving’ 제스처를 인식하는 수식은 식 (5)와 같다.

| (5) |

손 모양 인식 모델이 올바른 제스처를 인식하기 위한 후처리 조건은 표 2에서 확인할 수 있다. 식 (2)에서 구한 팔의 비율 𝑟이 0보다 작은 경우 혹은 사람 팔의 각도는 180도를 넘을 수 없으므로 𝜃𝑠𝑒𝑤가 180도보다 큰 경우 제스처로 인식하지 않는다. 이외에는 ‘Pointing’과 ‘You’ 제스처의 손 모양이 서로 비슷해 헷갈릴 수 있지만 𝑟 값을 사용해 구분할 수 있다. 또한 ‘Turn’ 제스처를 수행할 때 ‘Forward’와 ‘Backward’ 제스처의 손 모양이 혼동될 수 있는데, 이 경우 𝑟값을 사용하여 구분할 수 있다. 만약 𝑟이 0인 경우 제스처로 인식하지 않는다. ‘Forward’와 ‘Backward’ 제스처의 손 모양이 비슷한 것으로 인식되는 영역에서는 𝜃𝑠𝑒𝑤값을 사용하는 팔 각도 알고리즘을 통해 제스처를 명확하게 구분할 수 있다. 이러한 조건을 적용하면 손 모양의 오인식으로 인한 AngGo의 오작동을 방지할 수 있다. 그러나 사람마다 다른 신체 조건으로 모든 경우를 분류하기에는 한계가 존재했기 때문에, 사용자 평가 시 충분한 연습을 통해 사용자에게 제스처별 차이를 인지시킨 후 평가를 진행하였다.

사용자가 의도한 손동작을 정확히 파악하기 위해 동일한 제스처가 여러 번 인식될 때 제스처로 인식하는 알고리즘을 사용하였다. 특정 프레임에 특정 제스처가 인식되는 순간 1번 감지된 것으로 한다. ‘Turn’ 제스처를 제외하고 나머지 제스처의 경우 동일한 제스처가 세 번 연속 감지되면 최종 제스처로 설정된다. ‘Turn’ 제스처는 손 모양 특성상 손을 돌리는 과정에서 ‘Stop’, ‘Forward’, ‘Backward’ 제스처의 손모양으로 검출되는 경우가 생겨서 혼동될 확률이 높았다. 따라서, 다른 제스처가 연속 감지되지 않는다면, ‘Turn’ 제스처가 비연속적이라도 5회 감지 시 인식하도록 하였다.

하지만 반복 검증 알고리즘으로 인해 손 제스처 인식 시간 지연이 발생하는 경우가 있는데, 이는 사용자 별 신체조건 차이와 수행 범위가 상이하여 사전에 설정된 제스처 분류 조건을 만족하지 못하기 때문이다. 이는 추후 다양한 사용자의 학습 데이터를 수집하여 손 모양 인식 모델을 강화하고 다양한 신체조건을 바탕으로 한 손 제스처 인식 조건을 세밀하게 조정할 필요가 있다.

손 모양 감지 모델 학습을 위한 컴퓨팅 환경은 인텔 i7-12700K CPU, 32GB RAM, NVIDIA GeForce RTX 3060 Ti에서 실행되었다. 실시간 추론을 수행하기 위한 하드웨어로 Jetson Orin Nano를 사용하였는데 이는 edge 컴퓨팅환경에서 실시간 인공 지능 처리를 위해 설계된 엔지니어링 기기이다. 1,024개의 CUDA 코어와 32개의 tensor 코어를 갖추고 있으며 6코어 Arm Cortex-A78AE v8.2 64비트 CPU를 사용한다. 사용모델에는 8GB의 DDR5 메모리가 있어 대용량 모델을 로드하고 빠르게 실행할 수 있는 충분한 용량을 보장한다. 무선 전원 공급을 위해 19V 5A 배터리를 사용하였으며 손 제스처 모델을 약 5시간 동안 실행할 수 있었다. 모델을 실행하고 우분투 20.04 환경에서 실시간 후처리를 수행하기 위한 언어로는 Python을 사용하였다.

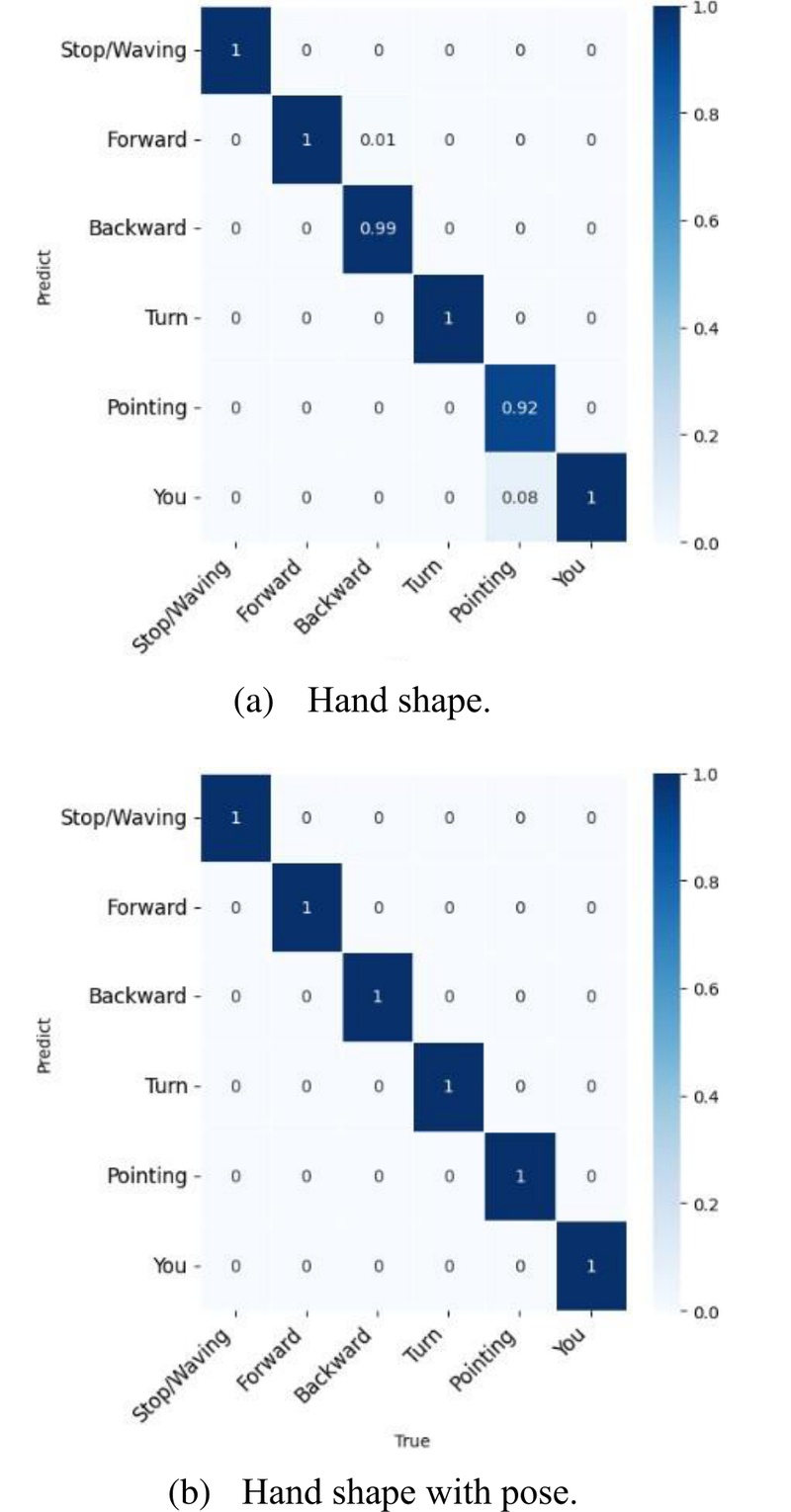

혼동 행렬은 1,214개의 테스트 데이터 세트로부터 계산되었다. 그림 11 (a)의 혼동 행렬은 손 모양 감지 모델만 사용한 경우 ‘Backward’ 제스처를 ‘Forward’ 제스처로 인식하거나 ‘Pointing’ 제스처 ‘You’ 제스처로 인식하는 오인식이 존재했다. 그림 11 (b)는 포즈 모델을 사용한 후처리를 수행 후 계산된 혼동 행렬이며 왼쪽 손 모양 감지 모델의 오인식을 올바르게 분류한 것을 볼 수 있다. 특정 순간 프레임에 대한 혼동 행렬을 보여주기 때문에 손 모양이 같은 ‘Stop’ 제스처와 ‘Waving’ 제스처가 같은 그룹으로 분류되었다.

V. 휠 모바일 로봇 구현

본 논문에서 실험에 사용하기 위해 개발한 로봇 AngGo는 반자율주행모드를 통해 특정 공간을 돌아다니며 잠재적 사용자를 탐색한다. 반자율주행 모드는 지도를 바탕으로 한 사전 경로를 반복 주행하는 것이 아니라 직선 경로에 대해 반복 주행하는 모드이다. 주행 중 하단에 배치된 3개의 ToF센서에 물체가 감지되면 장애물 회피 알고리즘을 통해 물체를 회피하고, 회피 시 IMU센서 값 변화량을 바탕으로 원래의 직선 경로로 복귀할 수 있다. 사용자가 손 제스처 조작방식을 사용하여 AngGo를 조작 후 탑승 시 오른쪽 팔걸이에 위치한 조이스틱 혹은 하단의 발판을 사용해 운전할 수 있다. 두 조작 모드 간의 전환은 조이스틱 스위치를 눌러 변경할 수 있으며 탑승 중 다른 사용자의 손 제스처에 의한 오작동을 방지하기 위해 손 제스처 조작 모드는 동작하지 않는다. 사용자가 AngGo 탑승을 완료하게 되면 탑승 완료 의사를 제스처를 통해 전달하여 AngGo를 반자율주행모드로 변경시킬 수 있다.

1. 장애물 회피 알고리즘

AngGo의 반자율주행 방향에 장착된 3개의 ToF 센서에서 측정되는 각 값에 가중치를 부여하여 양쪽 모터의 속도를 조절하여 장애물을 회피하는 방식이다. 이때 반자율주행 방향은 전방의 물체와 환경을 감지하기 위한 카메라와 ToF 센서가 부착된 면으로 정의한다. 이때 ToF 센서는 최대 2m 거리의 장애물을 감지하며 𝑆𝑚𝑎𝑥로 표시한다. 𝑆𝐿,𝐶,𝑅은 각각 ToF 센서의 왼쪽, 가운데, 오른쪽 측정값을 의미한다. 𝐾𝐿,𝐶,𝑅은 센서별 가중치를 부여하기 위한 비례 계수이다. 이를 바탕으로 두 모터의 속도 𝑉𝐿𝑅은 식 (6)으로 정의할 수 있다.

| (6) |

2. 인디케이터

시스템이 ‘You’ 제스처를 통해 제스처 조작 모드로 전환되면 카메라 아래 장착된 LED의 흰색 불빛이 점등된다. 이후 제스처가 인식될 때마다 흰색 LED가 깜박거리게 된다. 만약 ‘Waving’ 제스처를 통해 제스처 제어 모드를 종료하게 되면 점등된 LED의 불이 꺼지게 되며 사용자 제스처에 대한 AngGo의 인식 여부를 알려줄 수 있도록 하였다.

3. 통신방법

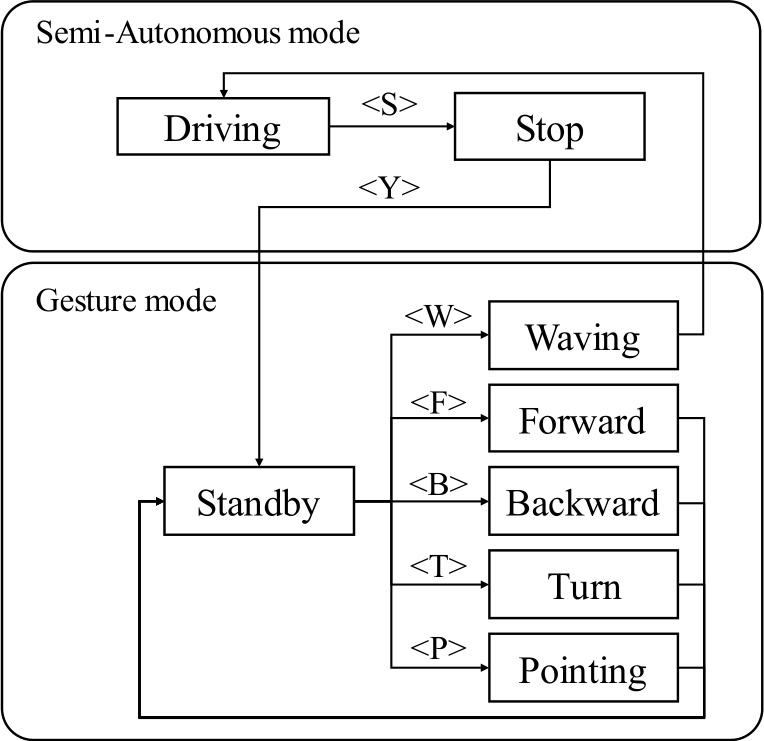

Jetson Orin Nano에서 인식된 사용자 제스처는 USB to UART를 통해 사전 구성된 형태의 패킷 시리얼로 전달된다. 그림 12에서 반자율주행모드 상태인 AngGo는 UART (Universal Asynchronous Receiver-Transmitter) 통신을 통해 전달받은 명령어를 통해 해당모드로 진입하게 된다. 예를 들어 ‘You’ 제스처를 감지 시 AngGo는 주행을 멈추고 Gesture 모드를 작동시켜 Standby 모드로 진입하게 된다. Standby 모드에서는 제스처 인식 시 LED가 깜박거리면서 제스처 인식에 대한 피드백을 사용자에게 전달할 수 있다. ‘Waving’ 제스처 외 제스처가 인식되면 해당 모드로 진입하여 동작을 수행하며 모든 동작은 한 번 인식되면 일정 거리를 정해진 패턴으로 움직이게 된다. ‘Waving’ 제스처를 인식하게 되면 AngGo는 다시 반자율모드로 변경된다. 이후 ‘You’ 제스처 이외의 제스처를 감지 시 AngGo는 이를 제스처 명령으로 인식하지 않는다. 이를 통해 주행 중 의도치 않은 제스처 인식을 방지할 수 있다.

VI. 손 제스처 조작 실험

1. 실험 설계

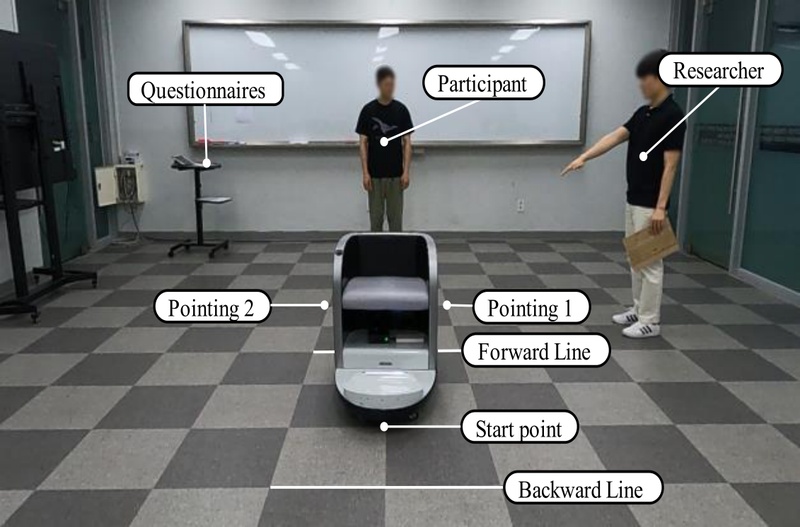

19세부터 37세 사이의 한국 국적 40명(남 19명, 여 21명, 평균 2세)으로부터 AngGo를 손 제스처로 조작하는 실험을 그림 13의 환경에서 진행하였다. 실험시간은 총 30분이며 제스처 연습, 개별 제스처 평가, 미션 수행을 통한 전체 제스처 평가로 구성되었다. 개별 제스처 평가에서는 NASA Task Load Index (NASA-TLX) 평가의 가지 항목에 대해 제스처 별 작업부하를 측정하였으며 0에서 100점까지의 점수를 측정하였다. 점수가 높을수록 영역에 대한 작업 부하가 높음을 의미한다. 전체 제스처 평가는 3분 동안 7개의 제스처를 이용해 지정된 미션을 수행하도록 구성되었으며 System Usability Scale (SUS) 평가를 통해 손 제스처 조작 시스템의 사용성에 대한 평가를 진행하였다. SUS는 10개의 질문으로 구성되어 각 항목은 5점 Likert 척도로 평가되며 계산식을 통해 100점 만점으로 측정되며 8점 이상일 경우 사용할 만한 시스템으로 평가된다.

2. 제스처 별 작업부하 및 시스템 사용성 평가

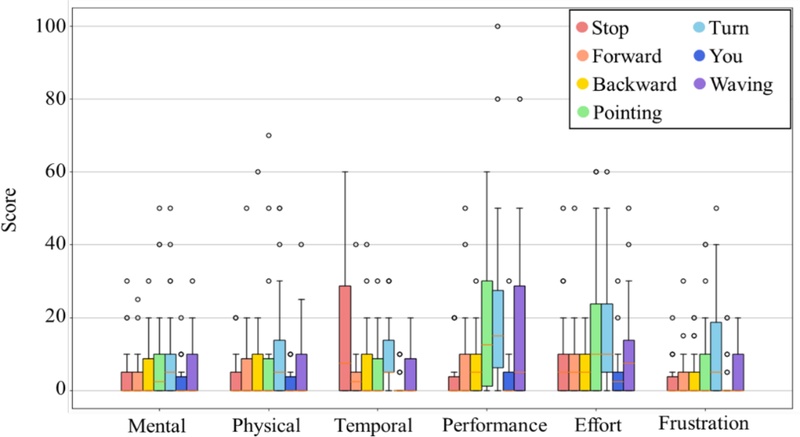

그림 14에서 NASA-TLX 각 영역에 대해 측정된 제스처별 작업부하 지표를 확인할 수 있다. 정신적 부하의 경우 제스처 간 큰 차이를 보이지 않았는데 이는 직관적인 제스처로 인해 정신적 요구가 낮았던 것으로 보인다. ‘Stop’, ‘You’와 같은 정적인 제스처는 동적 제스처에 비해 신체적 부하가 낮게 측정되었는데 이는 동적 제스처 인식을 위해 지속적인 움직임을 수행해야 했기 때문으로 보인다. 특히 ‘Turn’ 제스처의 경우 동작 중 다른 제스처의 손모양이 인식됨으로 인해 신체적 부하가 높게 측정된 것으로 보인다.

‘Stop’ 제스처와 같이 AngGo의 접근에 의해 심리적 부담이 느껴지는 제스처의 경우 시간적 요구가 높게 측정되었다. 이 경우 인식이 가장 유리한 제스처를 선정할 필요가 있다. 수행도와 노력의 경우 또한 ‘Pointing’, ‘Turn’, ‘Waving’과 같은 동적 제스처에 높은 부하가 측정되었는데 이는 동적 제스처의 인식률 개선이 필요함을 의미한다. 또한 좌절영역의 경우 제스처 수행 시 AngGo가 제스처를 인식했는지 사용자가 알기 어려워 높게 측정된 것으로 보인다. 이는 사용자의 제스처를 인식했다는 피드백 시스템에 대한 개선이 필요하다는 것을 의미한다.

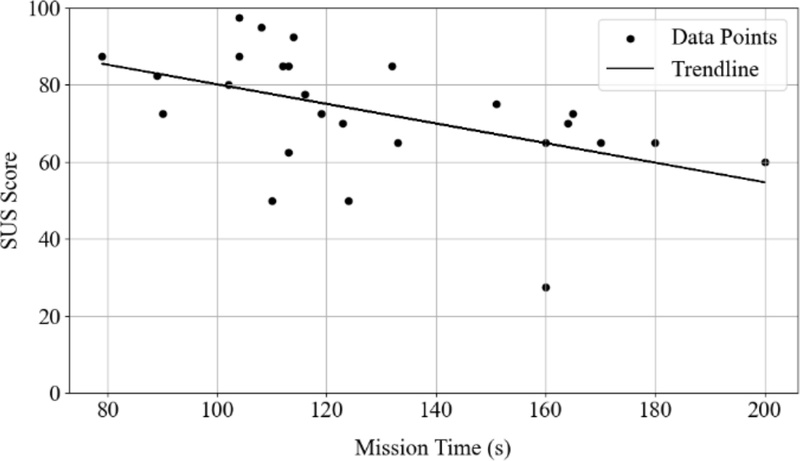

널리 사용되는 연구에 근거한 SUS 평가 점수표는 표 3과 같다[19]. 아웃라이어를 제외한 2 명의 최종 미션 평균 SUS 점수는 72.9점으로 사용성 수준은 ‘Good’으로 측정되었다. 이는 실시간 손 제스처 제어 방식이 사용할 만하다고 볼 수 있다. 그림 15의 산점도는 SUS 점수와 최종 미션 완료 시간 간의 상관관계를 보여준다. 최종 미션 완료 시간은 미션시작부터 미션완료 시간까지 측정한 시간이다. 각 점은 참가자의 데이터 포인트를 나타내며, 가로축에는 미션 완료 시간, 세로축에는 SUS 점수를 의미한다. 추세선은 SUS 점수와 미션 완료 시간 사이에 음의 상관관계가 있음을 나타 내며, 이는 미션 시간이 적을수록 사용성 점수가 높다는 것을 의미한다. 이를 바탕으로 사용성을 높이기 위해 제스처 인식에 대한 개선이 필요한 것을 알 수 있다.

사용자로부터 도출된 제스처를 적용했음에도 불구하고, 모든 사용자를 만족시키는 것은 어려운 경우가 있었는데, 이는 사람마다 자연스럽게 하는 제스처의 형태가 다르기 때문인 것으로 보인다. 흥미로운 점은 일부 참가자들이 AngGo를 제스처를 이용해 조작 시 즐거운 감정과 반려견과 소통하는 것처럼 경험했다는 점이다. 이는 AngGo가 사용자 시선보다 낮은 위치에 있다는 사실과 함께 제스처 인터랙션에서 파생된 장점이라 볼 수 있다. 이는 손 제스처 조작 시스템이 편의성뿐만 아니라 감정적 요소 또한 첨가될 수 있음을 보여준다. 하지만 제스처 수행 시 제스처 인식을 표시하는 시각적 피드백이 빈약하다고 사용자들이 느꼈으며 추가적인 인디케이터가 구현될 필요가 있다.

VII. 결론

WMR과 손 제스처 상호작용에 관한 연구가 많이 진행되었지만, 대부분 기술적인 측면에 집중되어 실용적인 단계에 대한 연구는 상대적으로 부족한 상황이었다. 본 연구에서는 이러한 문제를 해결하기 위해, 실제 환경에서 평가할 수 있는 시스템을 구현하고자 하였다. 이를 위해 특정 시나리오를 바탕으로 사용자로부터 도출된 손 제스처를 조사하고, 딥러닝 모델인 YOLOv8을 활용하여 손 제스처 조작 시스템을 구축하였다. 또한, 손 제스처에 따라 움직임을 수행하는 WMR을 직접 개발하였다. 구현된 시스템은 NASA-TLX의 각 영역에서 작업 부하 평가 결과를 통해 제스처 선정 및 시스템 구현 시 고려요소들을 알 수 있었으며, SUS 결과에서도 사용가능한 수준의 시스템으로 평가되었다. 비록 제스처 인식 시스템의 불완전성과 제스처 수집을 위한 표본 크기가 작다는 점은 연구의 한계로 지적될 수 있지만, 향후 연구에서는 인식률 개선과 도출된 장점을 바탕으로 더 나은 시스템을 개발하고자 한다.

Acknowledgments

본 연구는 2024년도 정부(산업통상자원부)의 재원으로 한국산업기술진흥원의 지원을 받아 수행된 연구임(P0012725, 2024년 산업혁신인재성장 지원사업).

이 논문은 2024 제39회 제어·로봇·시스템학회 학술대회에 초안이 발표되었음[20].

REFERENCES

-

M. S. Sadi, M. Alotaibi, Md. R. Islam, Md. S. Islam, T. Alhmiedat, and Z. Bassfar, “Finger-gesture controlled wheelchair with enabling IoT,” Sensors, vol. 22, no. 22, p. 8716, Nov. 2022.

[https://doi.org/10.3390/s22228716]

- A. R. Fardana, S. Jain, I. Jovančević, Y. Suri, C. Morand, and N. M. Robertson, “Controlling a mobile robot with natural commands based on voice and gesture,” IEEE International Conference on Robotics and Automation (ICRA) - Workshop on Human Robot Interaction for Assistance and Industrial Robots, May. 2013.

-

J. Fagerlönn, Y. Zhang, L. Orrell, and H. Rönntoft, “Interaction with automated heavy vehicles using gestures and external interfaces in underground mines,” Human-Computer Interaction (HCI) in Mobility, Transport, and Automotive Systems, vol. 14048, H. Krömker, Ed., in Lecture Notes in Computer Science, vol. 14048, Cham: Springer Nature Switzerland, pp. 255–267, 2023.

[https://doi.org/10.1007/978-3-031-35678-0_17]

-

A.-R. Kim and S.-Y. Rhee, “Motion control of a mobile robot using natural hand gesture,” Journal of Korean Institute of Intelligent Systems, vol. 24, no. 1, pp. 64–70, Feb. 2014.

[https://doi.org/10.5391/JKIIS.2014.24.1.064]

-

M. Correa, J. Ruiz-del-Solar, R. Verschae, J. Lee-Ferng, and N. Castillo, “Real-time hand gesture recognition for human robot interaction,” RoboCup 2009: Robot Soccer World Cup XIII, vol. 5949, Berlin, Heidelberg: Springer Berlin Heidelberg, pp. 46–57, 2010.

[https://doi.org/10.1007/978-3-642-11876-0_5]

-

Md. Repon Islam, Md. Saiful Islam, and M. S. Sadi, “Towards developing a real-time hand gesture controlled wheelchair,” Proceedings of International Conference on Trends in Computational and Cognitive Engineering, vol. 1309, vol. 1309, Singapore: Springer Singapore, pp. 355–366, 2021.

[https://doi.org/10.1007/978-981-33-4673-4_28]

-

S. Ikegami, C. Premachandra, B. H. Sudantha, and S. Sumathipala, “A study on mobile robot control by hand gesture detection,” 2018 3rd International Conference on Information Technology Research (ICITR), Moratuwa, Sri Lanka: IEEE, pp. 1–5, Dec. 2018.

[https://doi.org/10.1109/ICITR.2018.8736135]

-

L. Chen, C. Li, A. Fahmy, and J. Sienz, “GestureMoRo: an algorithm for autonomous mobile robot teleoperation based on gesture recognition,” Scientific Reports, vol. 14, no. 1, p. 6199, Mar. 2024.

[https://doi.org/10.1038/s41598-024-54488-w]

-

S. Ahmed, V. Popov, A. Topalov, and N. Shakev, “Hand gesture based concept of human - mobile robot interaction with leap motion sensor,” International Federation of Automatic Control-PapersOnLine, vol. 52, no. 25, pp. 321–326, 2019.

[https://doi.org/10.1016/j.ifacol.2019.12.543]

-

D. Sri, F. Rian, and Z. Ahmad, “Mobile robot motion control based on static hand gesture,” Journal of Physics: Conference Series, vol. 1500, no. 1, p. 012116, Apr. 2020.

[https://doi.org/10.1088/1742-6596/1500/1/012116]

-

A. M. Faudzi, M. H. K. Ali, M. A. Azman, and Z. H. Ismail, “Real-time hand gestures system for mobile robots control,” Procedia Engineering, vol. 41, pp. 798–804, 2012.

[https://doi.org/10.1016/j.proeng.2012.07.246]

-

D. Martinelli, A. L. Sousa, M. E. Augusto, V. C. Kalempa, A. S. de Oliveira, R. F. Rohrich, and M. A. Teixeira, “Remote control for mobile robots using gestures captured by the RGB camera and recognized by deep learning techniques,” 2019 Latin American Robotics Symposium (LARS), Rio Grande, Brazil: IEEE, pp. 98–103, Oct. 2019.

[https://doi.org/10.1109/LARS-SBR-WRE48964.2019.00025]

-

H. Park, S. Yun, J. Lee, B. Kim, S. Park, and H.-S. Lee, “Developing AngGo, a shared indoor smart mobility vehicle with driving mode switching interaction using ToF distance sensors,” Journal of Institute of Control, Robotics and Systems (in Korean), vol. 29, no. 5, pp. 426–434, May. 2023.

[https://doi.org/10.5302/J.ICROS.2023.23.0020]

-

J. P. Sahoo, S. P. Sahoo, S. Ari, and S. K. Patra, “Hand gesture recognition using densely connected deep residual network and channel attention module for mobile robot control,” IEEE Transactions on Instrumentation and Measurement, vol. 72, pp. 1–11, 2023.

[https://doi.org/10.1109/TIM.2023.3246488]

-

Y.-H. Nho, J.-W. Seo, W.-J. Seol, and D.-S. Kwon, “Emotional interaction with a mobile robot using hand gestures,” 2014 11th International Conference on Ubiquitous Robots and Ambient Intelligence (URAI), Kuala Lumpur, Malaysia: IEEE, pp. 506–509, Nov. 2014.

[https://doi.org/10.1109/URAI.2014.7057471]

-

D. Vilcapaza Goyzueta, J. Guevara Mamani, E. Sulla Espinoza, E. Supo Colquehuanca, Y. Silva Vidal, and P. P. Pinto, “Evaluation of a NUI interface for an explosives deactivator robotic arm to improve the user experience,” HCI International 2021 - Late Breaking Posters, vol. 1498, pp. 288–293, Nov. 2021.

[https://doi.org/10.1007/978-3-030-90176-9_37]

-

J.-W. Lee, K.-J. Kim, and K.-H. Yu, “Implementation of a user-friendly drone control interface using hand gestures and vibrotactile feedback,” Journal of Institute of Control, Robotics and Systems (in Korean), vol. 28, no. 4, pp. 349–352, Apr. 2022,

[https://doi.org/10.5302/J.ICROS.2022.22.8004]

-

J. Redmon, S. Divvala, R. Girshick, and A. Farhadi, “You only look once: Unified, Real-time object detection,” 2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Las Vegas, NV, USA: IEEE, pp. 779–788, Jun. 2016.

[https://doi.org/10.1109/CVPR.2016.91]

-

J. R. Lewis and J. Sauro, “The factor structure of the system usability scale,” Human Centered Design in Lecture Notes in Computer Science, vol. 5619, Berlin, Heidelberg: Springer Berlin Heidelberg, pp. 94–103, 2009.

[https://doi.org/10.1007/978-3-642-02806-9_12]

- S. Yun, H. Park, and H.-S. Lee, “Controlling wheeled mobile robot movement with hand gestures,” Proceeding of 2024 39th ICROS Annual Conference (ICROS 2024), Daejeon, Korea, pp. 892–893, Jul. 2024.

2021년 경상대학교 제어계측공학과 학사, 2024년 UNIST 디자인학과 석사. 관심분야는 임베디드 시스템, 모바일 로봇, HRI, 비전 인식.

2018년 한동대학교 전산전자공학부 학사, 2019년 한동대학교 정보 통신공학과 석사, 2020년 ~ 현재 UNIST 창의디자인공학과 박사 과정. 관심분야는 로봇 인터랙션, 모빌리티.

2020년 안동대학교 전자공학과 학사, 2022년 UNIST 창의디자인공학과 석사, 2022년~현재 LIG 넥스원 연구원. 관심분야는 HRI, 스마트 모빌리티, 임베디드 시스템.

2024년 UNIST 전기전자공학과 학사. 2024년~현재 UNIST 전기전자공학과 석사과정. 관심분야는 모바일 로봇, 최적제어, 충돌회피.

2000년 KAIST 전기및전자공학과 학사, 2002년 KAIST 전기및전자공학과 석사, 2008년 KAIST 전기및전자공학과 박사, 2008 ~ 2010년 삼성전자 책임연구원, 2010 ~ 2017년 현대자동차 책임연구원, 2017 ~ 현재 UNIST 디자인학과 부교수. 관심분야는 임베디드 시스템, 서비스 로봇, 스마트 모빌리티.