CNN 기반 모듈형 정밀착륙 시스템을 활용한 UAM 축소기의 시뮬레이션 및 비행시험

Copyright© ICROS 2025

Abstract

Urban air mobility (UAM) requires precise take-off and landing maneuvers in urban environments. This study proposes an algorithm that uses a convolutional neural network to recognize an H-shaped unknown landing marker as a landing target and issue it as a precision guidance command in a fixed 3D body coordinate system. The UAM can make precise landings through this approach, even on existing landing pads without any landing guide facility. The algorithm was developed and verified through a software-in-the-loop simulation. It was then implemented and modularized on a companion computer to be applied to all flight control computers operating on MAVROS. In addition, the modular precision landing system was mounted on the UAM scaled model and verified through a flight test. Consequently, precision landing performance was verified in both simulation and flight tests.

Keywords:

urban air mobility, convolutional neural network, image recognition, modular precision landing system, SITL (Software In The Loop simulation), flight testI. 서론

UAM (Urban Air Mobility)은 도심과 도심, 혹은 도심환경 내에서 승객 및 화물의 효율적인 수송을 위해 전기 수직 이착륙(eVTOL, electric Vertical Takeoff and Landing) 항공기의 형태로 활발한 연구가 수행되고 있다. 특히, 승객 수송과 같은 임무의 특성 상 버티포트 (Verti-port) 혹은 기존 헬리콥터 랜딩패드에서의 정밀한 이착륙 성능이 요구된다. 기존의 무인항공기 혹은 UAM의 착륙 유도 방식에는 대표적으로 착륙 목표지점의 위/경도 및 고도를 알고 있을 때 항공기에 탑재된 GNSS (Global Navigation Satellite System)의 위치정보를 기반으로 착륙하는 방식이 있으나, 상업용 GNSS는 수직∙수평 해상도에 따른 위치 오차가 존재하고, 수신 감도가 약하거나 사용할 수 없을 경우에는 정밀한 착륙유도가 제한되는 단점이 있다. 이러한 문제를 해결하기 위해 적외선 비콘(infrared ray beacon)과 이를 탐지하는 센서를 기반으로 정밀착륙 유도를 실시하는 기술[1-3]이 상용화되어 사용되고 있다.

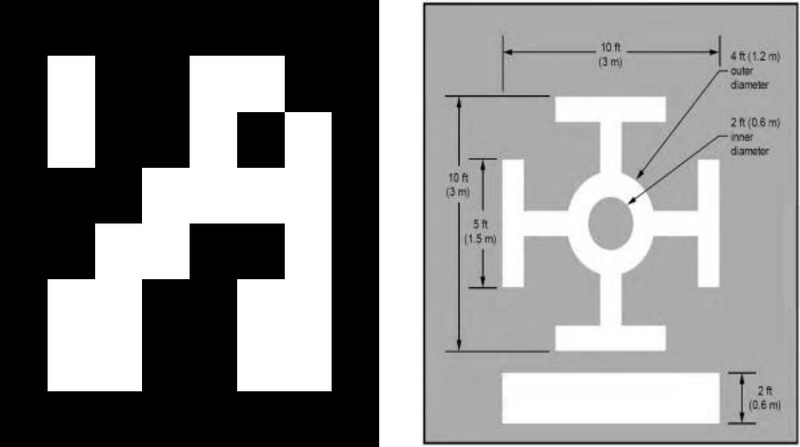

최근에는 OpenCV와 같은 영상 처리 기술[22]의 발달로 그림 1(a)의 ArUco Marker, AprilTag 등과 같이 기준 마커(fiducial marker)를 활용한 정밀착륙 관련 연구[4]가 활발히 진행되고 있으며, 미 연방항공청(FAA, Federal Aviation Administration)에서는 버티포트에 대한 기술지침(Engineering brief No. 105) [5]에서 착륙 유도를 위한 기준 마커를 그림 1(b)와 같이 제시하였다.

S. M. Nogar [6]은 Fractal ArUco Marker를 사용하여 GNSS 정보가 제한된 상황에서 움직이는 지상 차량 위로 UAV가 정밀착륙 하는 연구를 수행하였으며, Y. Jung [7]은 DLS (Direct Least Square) 기반의 Ellipse fitting method를 통해 강건한 마커 추적 알고리듬을 적용한 UAV의 정밀착륙 연구를 수행하였다. 또한 Y. H. Park[8]은 카메라의 FOV(Field Of View)를 고려하여 내∙외부의 ArUco marker를 설계하고, 선형 칼만필터를 통해 기준 마커와 카메라 간의 상대 위치를 추정하여 이를 기반으로 정밀착륙하는 알고리듬을 비행시험을 통해 검증하였다.

하지만 기준 마커 기반의 정밀착륙 시스템은 사전에 정의된 특정 마커에 대해서만 인식이 가능하며[9], 마커의 문양이 다르거나 문양이 손상된 경우 인식을 할 수 없다는 단점[10]이 있다. 본 연구에서는 CNN [21] 기반 객체 탐지 모델인 YOLOv5를 활용하여 다양한 헬리패드 및 기준 마커 이미지 데이터를 학습시킨 모델을 만들고, 미지의 착륙 마커를 인식해 정밀착륙 하는 방법을 제안한다. 이러한 방법은 기준 마커 기반의 기존 선행 연구와 달리 UAM 기체가 마커의 형상에 관계없이 정밀착륙이 가능하도록 하여 별도의 지상 유도 설비 구축이 필요하지 않으며, UAM 전용 버티포트가 아닌 기존에 구축되어 있던 헬리패드에도 정밀착륙 성능이 보장된다. 또한 제안하는 정밀착륙 시스템을 모듈화하여 MAVROS 기반 FCC를 사용하는 모든 형태의 무인항공기 및 UAM에 적용이 가능하다.

II. CONVOLUTIONAL NEURAL NETWORK

본 장에서는 정밀착륙을 위한 CNN 기반 객체 탐지 모델의 구조와 객체 예측 과정, 손실 함수, 데이터 학습 그리고 후처리 조건 설정에 대해 기술한다.

1. CNN 기반 객체 탐지 모델 구조

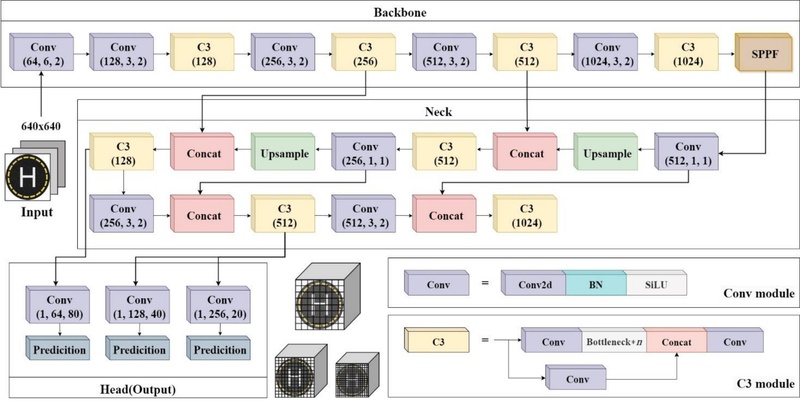

CNN은 여러 층의 합성곱 연산을 통해 입력 이미지의 지역적 특징을 추출하고, 이를 바탕으로 객체를 인식하는 딥러닝 모델이다. 본 연구에서 사용한 모델은 CNN 기반으로 한 YOLOv5이며, 객체 탐지를 단일 네트워크 패스(forward pass)로 수행한다[11]. 이는 속도와 효율성 면에서 다른 객체 탐지 알고리듬에 비해 우수하다.

CNN 기반 객체 탐지 모델의 구조는 그림 2와 같다. 모델은 Backbone, Neck 그리고 Head로 이루어져 있다. Backbone은 입력된 이미지에서 중요한 특징을 추출하는 부분이며, 여러 단계의 합성곱 레이어와 C3 모듈로 구성된다. 이는 점차적으로 채널 수를 증가시키며 공간 해상도를 줄이는 방식으로 작동하며[12], SPPF (Spatial Pyramid Pooling-Fast)모듈은 다양한 크기의 Max-Pooling층을 사용해 다중 스케일의 특징을 통합함으로써, 모델의 인식 능력을 극대화하면서 동시에 연산 속도를 유지할 수 있다[13]. Neck은 Backbone에서 추출된 특징들을 융합하고 업샘플링(Up-sampling)하여, 다중 스케일의 객체를 탐지하기 위한 정보를 생성한다. 이 과정에서 서로 다른 해상도의 특징들을 결합하고, 업샘플링 과정을 통해 해상도가 증가하면서 작은 객체부터 큰 객체까지 다양한 스케일의 객체를 효과적으로 탐지한다. 마지막으로 Head는 Neck에서 처리된 다중 스케일 특징 맵을 사용해 BBox (Bounding Box)의 파라미터와 클래스 확률을 계산한다. 이 과정에서는 위치 정보(𝑥, 𝑦) , 크기 정보(𝑤, ℎ) , 그리고 신뢰 점수(Confidence Score)를 포함한 다차원 배열을 생성하여 최종 탐지 정보를 출력하게 된다. 저해상도, 중해상도, 고해상도 출력으로 나뉘어 있어, 모델이 다양한 스케일의 객체를 동시에 탐지할 수 있도록 설계되었다.

따라서 본 연구에서 사용한 CNN 기반 객체 탐지 모델의 구조는 입력 이미지로부터 특징을 효과적으로 추출하고, 이를 다중 스케일에서 분석하여 최종적으로 객체의 위치와 클래스를 정확히 탐지할 수 있도록 동작한다.

2. 객체 예측 과정

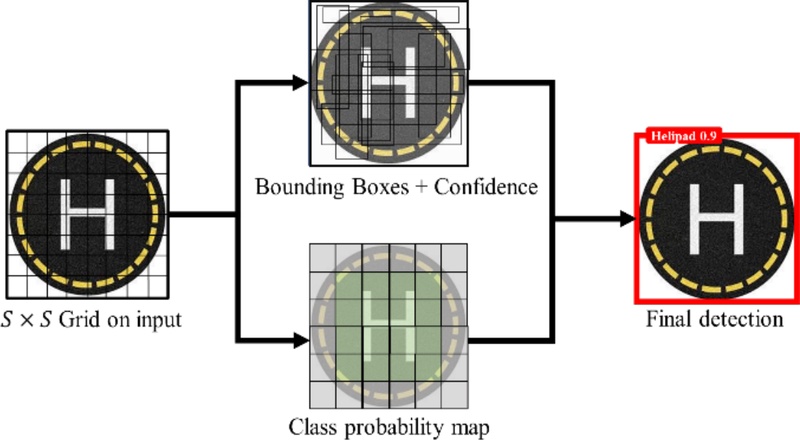

객체 예측은 모델이 이미지에서 착륙 마커의 위치를 정확히 추정하는 과정이다. 해당 과정은 Head에서 수행되며, 다음과 같은 절차를 따른다.

그림 3과 같이 입력 이미지를 S × S격자 셀로 나눈 뒤, 각 셀은 객체의 존재 여부와 함께 BBox의 x, y축 최소·최대 픽셀 좌표 및 클래스 레이블을 예측한다. 모델은 셀 내에서 상대적인 위치를 예측하고, 시그모이드(sigmoid) 함수를 통해 정규화 후 실제 좌표로 변환한다.

3. 손실 함수(Loss Function)

입력 이미지의 각 그리드 셀에서 여러 개의 BBox를 예측하지만, 정탐(True Positive)의 손실을 계산하기 위해서는 탐지된 객체를 가장 정확하게 포함하는 단일 박스를 선택해야 한다. 이를 위해, 실제 값(ground truth)과 예측된 BBox의 IoU(Intersection Over Union)를 계산하여 가장 높은 값을 가진 박스를 선택하고, 이를 통해 객체의 크기와 비율에 대한 예측 정확도를 높인다. 손실 함수는 Location Loss, Objectness Loss, Classes Loss로 나뉘며, Location Loss는 예측된 BBox와 실제 BBox 간의 픽셀 좌표 오차를 정밀하게 측정한다[14]. BBox의 중심점 거리, 크기 비율, 방향성 등을 고려하여 비행 중 착륙 마커의 위치를 정확히 감지하고, 이를 바탕으로 정밀하게 착륙할 수 있도록 한다. Objectness Loss는 각 그리드 셀의 객체 포함 여부를, Classes Loss 클래스 분류 정확도를 측정한다. 최종 손실 함수는 위의 세 가지 손실 항목을 각각의 가중치와 함께 합산하여 식 (1)과 같이 표현할 수 있다.

| (1) |

여기서 λ1, λ2, λ3는 각각 Classes Loss, Objectness Loss, 그리고 Location Loss에 대한 가중치를 의미하며, 모델이 예측한 결과와 실제 레이블 간의 차이를 측정하여 학습을 최적화하는 데 사용하였다. 특히, 본 연구에서는 착륙 마커를 인식하고 정확하게 착륙하는 것이 중요한 목표이므로 Location Loss에 대한 가중치 λ3를 상대적으로 높게 설정하여 모델이 착륙 마커의 픽셀 좌표를 더욱 정확하게 예측할 수 있도록 조정하였다. 이는 손실 함수의 가중치 조정이 객체 탐지 성능을 개선하는 데 효과적임을 보여준 연구[15]를 참고하여 진행하였다.

4. 데이터 학습 및 후처리 조건 설정

영상인식의 정확성을 높이기 위해 데이터 전처리를 수행하였다. 특히, 실내와 실외 환경, 착륙 패드의 방향 등 다양한 요소를 고려하여 학습을 수행하였다. 모델을 학습시키기 위해 약 1,000장의 착륙 마커 이미지를 사용하였으며, 데이터 준비 과정에서 실내와 실외를 포함한 다양한 환경에서 촬영된 이미지를 수집하였다. 더불어 이미지 증강 기법을 활용하여 회전, 확대, 축소 등의 변화를 적용함으로써 데이터의 다양성을 증가시켰다. 또한, 품질이 낮거나 잘못 레이블링된 이미지는 제거하여 데이터의 신뢰성을 확보하였다.

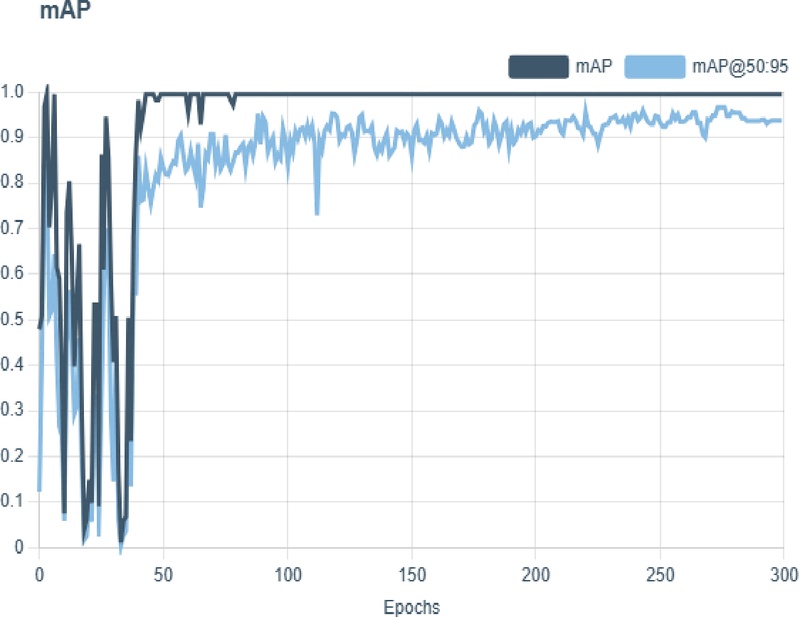

모델 학습 결과, 1,000장의 데이터만으로도 높은 성능을 얻을 수 있었다. 아래의 그림 4에 해당되는 그래프에서 볼 수 있듯이, mAP (mean Average Precision) 값은 약 40 Epoch 이후 90% 이상으로 안정되었으며, mAP@50:95 또한 높은 성능을 유지하고 있음을 확인할 수 있다. 이는 상대적으로 적은 데이터 양으로도 목표 성능을 달성할 수 있음을 의미한다.

객체 감지 모델의 성능을 향상시키기 위해 후처리 과정에서 mAP 평가 지표를 활용하였다. Confidence threshold는 모델이 마커를 감지했을 때, 마커가 실제로 존재할 확률을 판단하는 기준 값이다. 모델의 출력에서 각 객체 감지에 대한 신뢰도를 평가하며, 이 값이 특정 임계 값 이상일 때만 감지된 마커로 간주된다.

표 1과 같이 Confidence Threshold의 기준 값은 0.75로 설정하였다. 이는 모델이 마커를 감지했을 때, 최소한 75%의 확신을 가진 경우에만 결과를 신뢰하고, 이를 감지된 마커로 포함시키도록 한다. IoU threshold는 예측된 BBox와 실제 BBox 간의 중첩도를 평가하는 기준 값이다. IoU Threshold의 기준 값은 0.45로 설정하였다. 이는 모델이 예측한 BBox와 실제 BBox의 중첩 비율이 45% 이상일 때, 두 박스가 동일 객체를 나타내는 것으로 간주한다.

III. 정밀착륙 알고리듬

본 장에서는 CNN 영상인식을 통해 획득한 착륙 마커의 픽셀 좌표를 기반으로 정밀 착륙을 유도하는 알고리듬에 대해 기술한다.

1. 객체 Bounding Box 중앙 픽셀 좌표 추출

앞서 2장에서 설명한 CNN 기반 객체 탐지 모델을 통해 착륙 마커를 인식하고, 객체의 BBox를 획득한다.

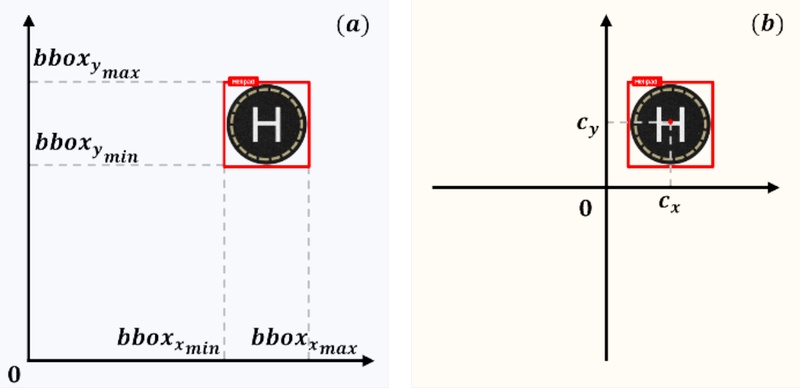

이 때 픽셀 좌표는 그림 5(a)의 2차원 카메라 좌표계에서 나타내어지며, BBox의 x, y축에 대한 최소∙최대 픽셀 좌표는 식 (2)를 통해 중앙 픽셀 좌표로 변환한다.

| (2) |

여기서 cx, cy 는 객체 BBox의 중앙 픽셀 좌표이며, 그림 5(b)의 2차원 데카르트 좌표계(Cartesian coordinate system)에서 표현된다. 또한 wimage, himage는 카메라 좌표계에서 획득한 이미지의 픽셀 해상도(Pixel resolution)이며, 본 연구에서는 CNN 객체 인식 간 계산소요를 줄여 시간지연을 최소화하기 위해 wimage = 480 px, himage = 320 px의 이미지 해상도로 촬영하도록 설정하였다.

2. Focal length를 고려한 정밀착륙 유도 명령 발행

기체 하부에 부착되는 카메라의 FOV (Field Of View)와 Focal length에 의해 지면 좌표계(local coordinate)에서 착륙 마커와 기체가 일정한 수평 위치오차를 유지하더라도, 상대 고도에 따라 cx, cy가 다르게 인식된다[16]. 본 연구에서 사용한 정밀착륙 모듈 카메라 센서의 사양은 표 2와 같다.

본 카메라 센서를 통해서는 1.5 m의 직경을 가지는 착륙 마커를 기체 고정 좌표계 기준 수직거리는 최대 25 m, 수평 거리는 최대 18.2 m에서부터 최초 CNN 영상 인식 및 객체 지속 추적이 가능하다.

이 때, 2차원 데카르트 좌표계에서 픽셀 좌표 c = [cx, cy]와 f (Focal length)를 통해 식 (3)과 같이 표현할 수 있다.

| (3) |

여기서 d̂ = [d̂x, d̂y]는 Focal length를 고려하여 추정된 지면 좌표계에서 정밀착륙 모듈과 착륙 마커 간의 상대 거리이며, h는 상대 고도이다. d̂은 데카르트 좌표계에서 기체고정 좌표계로 변환되며, 비례 제어를 통해 식 (4)과 같이 속도 명령으로 발행된다. 이 때 최초 명령 인가 시점을 제외하고 기체의 자세(Euler Angle)가 ± 1° 이내의 작은 값을 보이기에, 자세에 따른 픽셀위치 보정은 별도로 수행하지 않는다.

| (4) |

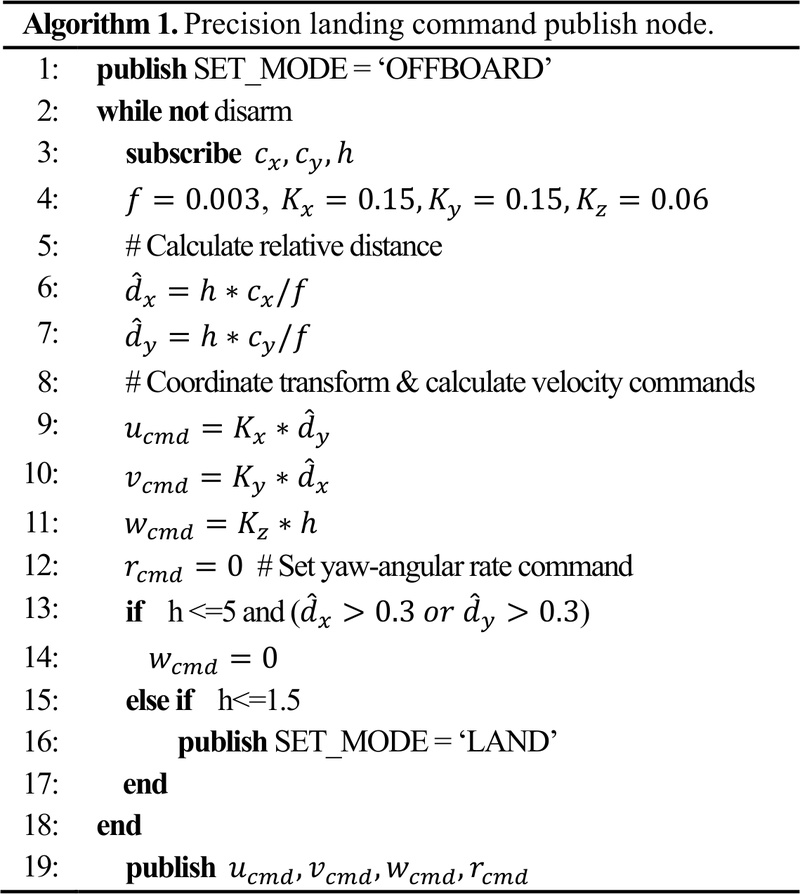

Kx, Ky, Kz > 0는 속도 명령 발행을 위한 상수이며, 본 알고리듬에서 사용한 값은 그림 6의 Line 4에서 병기하였다. UAM은 식 (4)의 수평 속도 명령 ucmd, vcmd 을 통해 착륙 마커와의 수평 위치오차를 0으로 수렴시키게 되며, 수직 속도 명령 wcmd를 통해 상대 고도를 좁히게 된다. 이 때, 상대 고도 5 m 이내에서 d̂ > 0.3 m일 경우엔 wcmd = 0을 발행한다. 이후 착륙 마커와 UAM간의 상대 고도가 1.5 m 이하가 되면 최종적으로 착륙을 결심하고 지면과 접지 후 비행을 종료한다. 본 정밀착륙 명령은 SISO (Single Input Single Output) 구조로 생성 및 발행되며, 노드의 알고리듬을 그림 6에서 pseudo code 형태로 나타내었다.

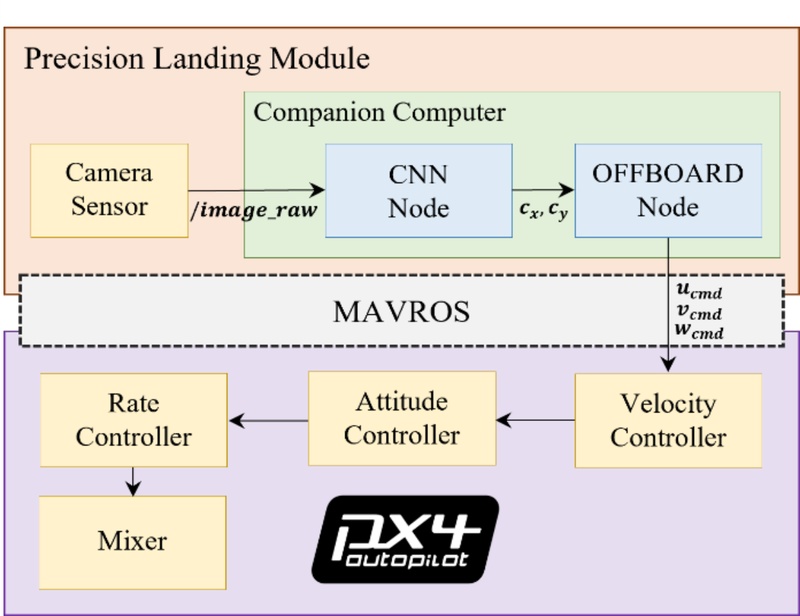

3. 정밀착륙 시스템 모듈화

본 연구에서 제안하는 CNN 기반 모듈형 정밀착륙 시스템은 ROS 환경을 기반으로 구축하였으며 FCC는 오픈소스 비행 제어 플랫폼인 Pixhawk를 사용하였다. 또한, 보조 컴퓨터(companion computer)로는 NVIDIA 사의 Jetson NANO Orin 컴퓨팅 보드를 사용하였다. 정밀 착륙 시스템의 구조도는 그림 8과 같다.

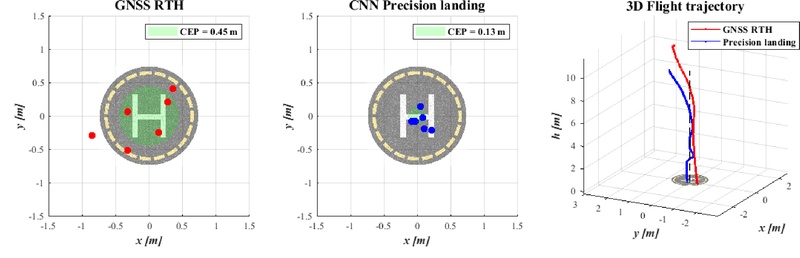

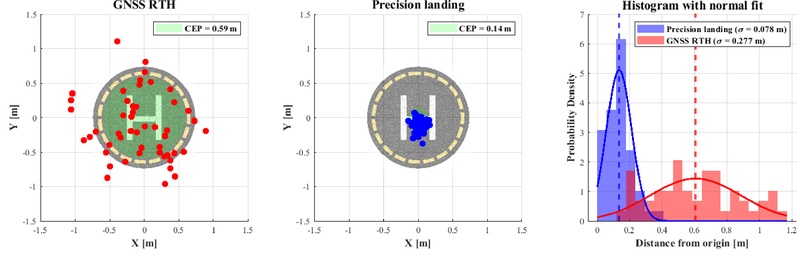

Monte Carlo simulation results.(a) GPS RTH.(b)CNN Precision landing; and (c) Histogram of simulation results.

카메라 센서와 보조 컴퓨터는 하나의 시스템으로 설계되어 어느 비행체 플랫폼에나 탈착이 가능하도록 모듈화되었으며, 보조 컴퓨터의 Node들은 Linux OS의 ROS 환경에서 동작한다. 20 Hz의 주기를 갖는 OFFBOARD Node에서 정밀착륙 유도를 위한 속도 명령이 Serial 통신을 통해 MAVLINK [17] 프로토콜로 발행되며, MAVROS 기반으로 동작하는 모든 비행 제어 플랫폼에 적용할 수 있다. 정밀착륙 속도 명령은 그림 8과 같이 PX4의 속도제어기로 발행된다. 이후 자세 제어기와 각속도 제어기를 거쳐 가상의 조종면 명령이 생성되며, Mixer를 통해 각 모터에 PWM (Pulse Width Modulation) 신호를 송출한다. 이 때 PX4의 제어기는 Cascade 형태로 구성되며 속도 제어기는 PID 구조를, 자세 및 각속도 제어기는 P-PID 구조를 가진다. PID 제어기의 구조는 식 (5)와 같다.

| (5) |

여기서 𝒖(𝒕)는 PID 제어기를 통해 생성된 하위 Node의 제어 입력이다. 또한 𝒆(𝒕) 는 상태 오차이며, 𝑲𝒑 > 0 그리고 𝑲𝒊, 𝑲𝒅 ≥ 0은 각 PID 제어 성분 별 게인이다. 적분기의 경우 PX4의 ARW (Anti-Reset Windup) 기능을 포함하여 적분 포화 현상을 방지하였다.

IV. SOFTWARE IN THE LOOP SIMULATION

본 장에서는 CNN 기반 모듈형 정밀착륙 시스템을 시뮬레이션으로 사전 검증한 내용에 대해 기술하였다. 시뮬레이션은 Linux OS 환경에서 Gazebo Simulator를 통해 수행되었다.

1. Gazebo Simulation

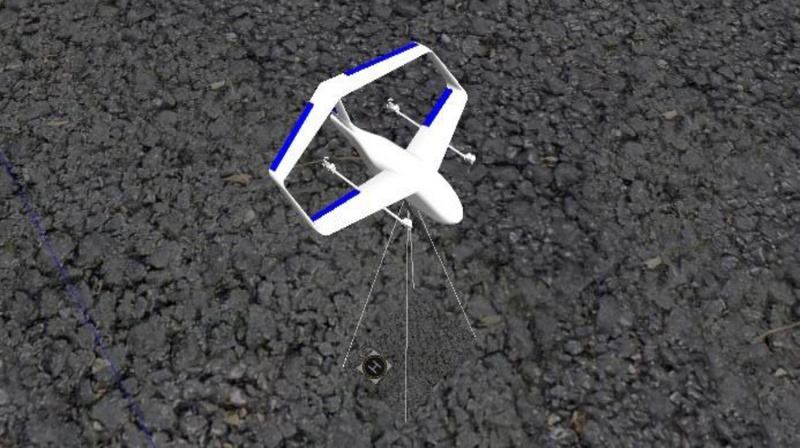

Gazebo Simulator [18]는 매니퓰레이터, 지상차량, UAV 등과 같은 로봇 플랫폼을 시뮬레이션 하기 위한 오픈소스 소프트웨어로, 시뮬레이션 모델을 설계하고, 물리 엔진과 더불어 각종 플러그인을 통해 실제 하드웨어와 유사한 거동을 모사할 수 있다. 본 연구에서는 비행시험에 사용할 UAM 축소기를 XML 기반의 SDFormat으로 모델링 하였으며, OPEN VSP와 CATIA V5 프로그램을 통해 획득한 공력∙구조 해석 결과를 바탕으로 실제 모델의 역학적 특성을 고려할 수 있도록 하였다. 또한 UAM 축소기에 적용된 항전장비를 모사하기 위해 센서의 노이즈와 GNSS 해상도, 구동기 딜레이 등을 적용하여 시뮬레이션 환경을 보다 엄밀하게 구현하였으며, 그림 8의 정밀착륙 시스템 구조도와 동일하게 동작할 수 있도록 하였다. 최종적으로 구현한 시뮬레이션 모델은 그림 9과 같다. 또한 그림 11은 Gazebo Simulator에서 CNN Node의 학습 모델이 이미지의 착륙 마커를 인식한 결과이다. 데이터셋 구축 시 학습시키지 않은 미지 형상의 착륙 마커에 대해서도 원활히 객체 인식이 가능함을 확인하였다.

2. Monte Carlo Simulation Result

시뮬레이션의 초기 조건은 착륙 마커와의 상대고도가 10m가 되도록 설정하였으며, 카메라 FOV 내에 착륙 마커가 인식될 수 있는 반경 내에서 임의의 수평 거리오차를 인가하였다. 이후 터미널을 통해 PX4의 Offboard mode로 비행 모드를 전환하여 OFFBOARD Node에서 발행되고 있는 속도 명령을 비행제어컴퓨터가 구독한 뒤 시뮬레이션 모델을 제어할 수 있도록 하였다. 그림 7은 각 착륙 유도 알고리듬에 대해 50회의 몬테카를로 시뮬레이션을 수행한 결과이다. 그림 7(a)에서 GNSS RTH (Return To Home)는 GNSS 오차 등으로 인해 CEP (Circular Error Probability) 0.59 𝑚의 수준을 보였으나, 그림 7(b)의 CNN 기반 정밀착륙 알고리듬은 CEP 0.14 𝑚로 나타나 약 75%의 착륙 오차 감소율을 보였다. 추가적으로 그림 7(c)의 히스토그램에서 GNSS RTH는 0.277 𝑚의 표준편차를 보인 반면에 CNN 기반 정밀착륙 알고리듬은 0.078 𝑚의 표준편차를 나타내어 상대적으로 더 낮은 분산을 보였다. 이를 통해 본 연구에서 제안하는 CNN 기반 모듈형 정밀착륙 시스템이 기존의 GNSS RTH에 비하여 정밀하고 일관적인 착륙 성능 확보가 가능함을 수치적으로 확인하였다.

V. FLIGHT TEST

본 장에서는 CNN 기반 모듈형 정밀착륙 시스템을 UAM 축소기에 탑재하여 비행시험을 통해 실증한 내용을 다룬다.

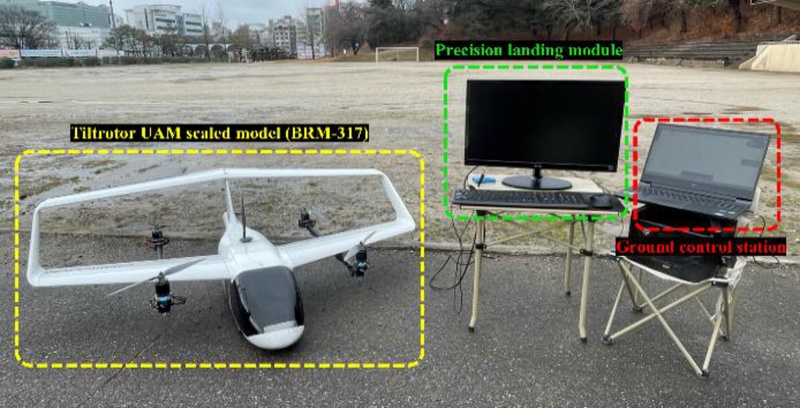

1. 시험환경 구축

기존에 본 연구팀에서 개발한 UAM 축소기를 활용하여 정밀착륙 비행시험을 수행하였다. 상세 제원은 표 3과 같다.

또한 CNN 기반 모듈형 정밀착륙 시스템을 모니터링 및 제어하기 위한 장비와, 상용 GCS (Ground Control Station)를 통해 UAM 축소기를 제어하고 정밀착륙 명령을 인가하였다. 그림 12에서는 비행시험에 사용된 장비를 전체적으로 나타낸다. 비행시험은 공역이 확보되고, 지면이 평탄하며, 지면과의 색상 대비를 통해 착륙 마커가 명확히 인식될 수 있는 환경에서 수행하였다.

CNN 객체인식을 위한 착륙 마커는 반경 0.75 𝑚의 헬리패드를 평평한 지면에 설치하였으며, 4장의 시뮬레이션 조건과 동일하도록 헬리패드를 이륙지점으로 설정하고, 상대고도 10 𝑚에서 하방 카메라 센서의 FOV (Field Of View)를 고려하여 임의의 수평 거리오차를 설정하였다. 이후 GCS를 통해 PX4의 비행 모드를 Offboard mode로 변경, UAM 축소기에 정밀착륙 유도 명령을 인가하여 각 모듈에서 발행하는 비행데이터를 수집하였다.

2. 비행시험 결과

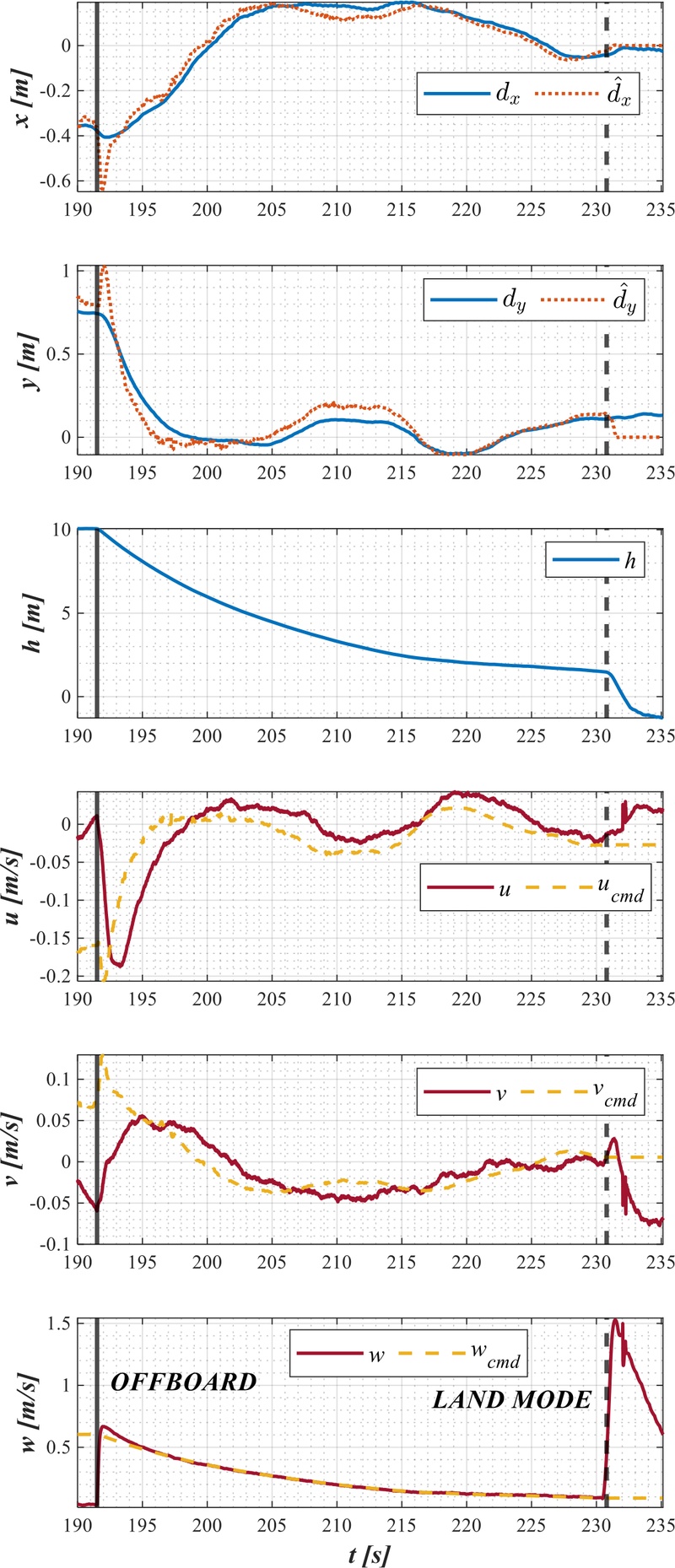

비행시험은 각 착륙 유도 알고리듬 별로 6회씩 실시하였다. 그림 13는 OFFBOARD Node에서 발행한 추정 상대거리와 속도명령을 비행데이터와 비교한 그래프이다. 상대고도 ℎ는 PX4의 Odometry Estimator 모듈을 통해 획득하였으며, 식 (4)을 바탕으로 추정된 상대거리 d̂ = [d̂x, d̂y]는 실측 값과 매우 유사한 경향을 보인다. 추정된 상대거리는 식 (5)를 통해 정밀착륙 유도를 위한 속도명령을 발행된다.

비행시험 결과 그림 10(a)에서 GNSS RTH는 CEP 0.45 𝑚 수준을 보였으나, 그림 10(b)의 CNN 기반 정밀착륙 알고리듬은 CEP 0.13 𝑚로 나타나 약 71%의 착륙 오차 감소율을 보였다. 이는 4장의 시뮬레이션 결과인 75%와 유사한 것을 확인할 수 있다. 또한 그림 10(c)에서 GNSS RTH와 CNN 영상인식 기반 정밀착륙 알고리듬은 초기 접근(approach) 과정에서는 유사한 궤적을 그리지만, 착륙 마커에 근접하였을 때는 정밀착륙 유도를 위한 속도명령에 의해 중앙 정렬을 수행하며 하강하는 비행 궤적을 확인할 수 있다.

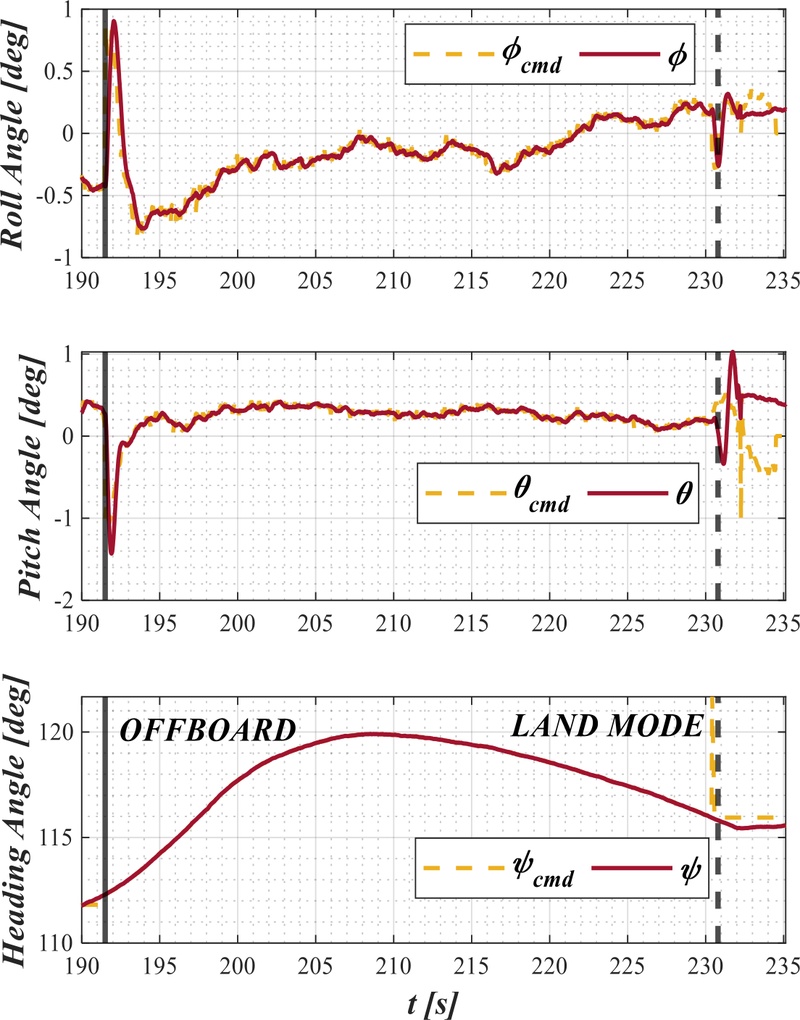

또한 그림 14에서는 정밀착륙 중 기체의 자세(euler Angle)를 나타내었다. OFFBOARD MODE 변경을 통한 최초 명령 인가 시점에서는 위치 오차 상쇄를 위해 최대 𝜙 (Roll Angle) = +0.9°, 𝜃 (Pitch Angle) = −1.4° 수준의 자세명령이 인가되지만, 착륙 마커에 접근하여 상대 거리 오차가 상쇄되며 Roll, Pitch 모두 ±0.5° 이내의 자세 반응을 보였으며, 지면과 접지를 위한 최종 착륙 결심(LAND MODE) 시점에서는 최대 𝜙 = −0.3°, 𝜃 = 1.1° 수준의 자세 반응을 보였다. 이를 통해 정밀착륙 및 지면과의 접지 과정에서 우수한 안전성을 확인하였다.

VI. 결론

본 연구에서는 무인항공기 혹은 UAM이 미지의 착륙 마커에 정밀한 착륙 유도가 가능한 CNN 기반 모듈형 정밀착륙 시스템을 제안하였다. 이는 별도의 착륙 유도 설비를 필요로 하지 않으며, 모듈 형태로 설계되어 MAVROS 기반의 비행 플랫폼에 쉽게 적용할 수 있기에 범용성이 높다. 또한 제안한 시스템을 실제 모델의 역학적 특성을 반영한 STIL을 수행하였고, UAM 축소기를 활용한 비행시험을 통해 시스템을 실증하여 타당성을 검증하였다. 차후에는 CNN 영상인식 알고리듬을 통해 비행체와 착륙 마커 간 상대고도를 추정하는 방법을 연구하고, 이를 기반으로 카메라 센서만 단독으로 사용하여 미지의 착륙 마커에 무인항공기 혹은 UAM가 정밀착륙하도록 유도하는 시스템을 개발할 계획이다. 본 연구에서 수행한 시뮬레이션과 비행시험에 대한 영상은 참고문헌 [20]의 링크를 통해 시청할 수 있다.

Acknowledgments

본 논문은 정부(산업통상자원부)의 재원으로 한국산업기술평가관리원의 지원을 받아 수행된 연구임 (No.20016463).

이 성과는 정부(과학기술정보통신부)의 재원으로 한국연구재단의 지원을 받아 수행된 연구임(No. NRF-2021R1A2C2013363).

이 성과는 정부(과학기술정보통신부)의 재원으로 한국연구재단의 지원을 받아 수행된 연구임(No. 2021R1A5A1031868).

이 논문은 2024 제 39 회 제어·로봇·시스템학회 학술대회에 초안이 발표되었음.

REFERENCES

-

J. Janousek and P. Marcon, “Precision landing options in unmanned aerial vehicles,” International Interdisciplinary PhD Workshop (IIPhDW), Poland, pp. 58-60, 2018.

[https://doi.org/10.1109/IIPHDW.2018.8388325]

-

H. J. Lee and S. S. Hwang, “Obstacle avoidance method for indoor autonomous UAV using an infrared sensor and front image information,” Journal of Institute of Control, Robotics, and Systems (in Korean), vol. 23, no. 9, pp. 803-809, Sep. 2017.

[https://doi.org/10.5302/J.ICROS.2017.17.0076]

-

S.Y. Kim, J.Y. Choi, and M.-H. Lee, “Indoor positioning system using the incidence angle of infrared sensors,” Journal of Institute of Control, Robotics and Systems (in Korean), vol. 16, no. 10, pp. 991-996, Oct. 2010.

[https://doi.org/10.5302/J.ICROS.2010.16.10.991]

- H. J. Heo and K. M. Lee, “Trends in research and development of precision landing technology for urban air traffic," Journal of Institute of Control, Robotics, and Systems (in Korean), pp. 20-30, Mar. 2024.

- M. A. P. Meyers, “Engineering brief No. 105, Vertiport design,” Memorandum, Federal Aviation Administration, Sep. 2022.

-

S. M. Nogar, “Autonomous landing of a UAV on a moving ground vehicle in a GNSS denied environment,” IEEE International Symposium on Safety, Security, and Rescue Robotics (SSRR), Abu Dhabi, United Arab Emirates, pp. 77-83, 2020.

[https://doi.org/10.1109/SSRR50563.2020.9292607]

-

Y. Jung, H. Bang, and D. Lee, “Robust marker tracking algorithm for precise UAV vision-based autonomous landing,” 15th International Conference on Control, Automation and Systems (ICCAS), pp. 443-446, 2015.

[https://doi.org/10.1109/ICCAS.2015.7364957]

-

Y. H. Park, C. H. Park, W.S. Song, C. Y. Lee, J. S. Kwon, J. H. Park, G. M. Noh, and D. W. Lee, “Fiducial marker-based autonomous landing using image filter and Kalman filter,” International Journal of Aeronautical and Space Sciences, vol. 25, pp. 190-199, 2024.

[https://doi.org/10.1007/s42405-023-00635-y]

-

O. Kedilioglu, T. M. Bocco, M. Landesberger, A. Rizzo, and J. Franke, “ArUcoE: Enhanced ArUco marker,” 21st International Conference on Control, Automation and Systems (ICCAS), pp. 878-881, 2021.

[https://doi.org/10.23919/ICCAS52745.2021.9650050]

-

H. C. Kam, Y. K. Yu, and K. H. Wong, “An improvement on ArUco marker for pose tracking using Kalman filter,” 19th IEEE/ACIS International Conference on Software Engineering, Artificial Intelligence, Networking and Parallel/Distributed Computing (SNPD), Busan, Korea, pp. 65-69, 2018.

[https://doi.org/10.1109/SNPD.2018.8441049]

-

J. Tao, H. Wang, X. Zhang, X. Li, and H. Yang, “An object detection system based on YOLO in traffic scene,” 6th International Conference on Computer Science and Network Technology (ICCSNT), Dalian, China, pp. 315-319, 2017.

[https://doi.org/10.1109/ICCSNT.2017.8343709]

-

J. Gao, X. Chen, and D. Lin, “Insulator defect detection based on improved YOLOv5,” IEEE 5th Asian Conference on Artificial Intelligence Technology (ACAIT), pp. 61-65, 2021.

[https://doi.org/10.1109/ACAIT53529.2021.9731270]

-

H. Tang, S. Liang, D. Yao, and Y. Qiao, “A visual defect detection for optics lens based on the YOLOv5-C3CA-SPPF network model,” Optics Express, vol. 31, no. 2, pp. 2628-2643, Jan. 2023. PMID: 36785272

[https://doi.org/10.1364/oe.480816]

-

S. Du, B. Zhang, P. Zhang, and P. Xiang, “An improved bounding box regression loss function based on CIOU loss for multi-scale object detection,” IEEE 2nd International Conference on Pattern Recognition and Machine Learning (PRML), Chengdu, China, pp. 92-98, 2021.

[https://doi.org/10.1109/PRML52754.2021.9520717]

-

T. Kvietkauskas, E. Pavlov, P. Stefanovič, and B. Pliuskuvienė, “The efficiency of YOLOv5 models in the detection of similar construction details,” Applied Sciences, vol. 14, no. 9, 3946, 2024.

[https://doi.org/10.3390/app14093946]

-

T. Kim, D. Kim, S. Kim, Y. Kim, and S. Han, “Improved optical sensor fusion in UAV navigation using feature point threshold filter,” International Journal of Aeronautical and Space Sciences, vol. 23, no. 1, pp. 157-168, Jan. 2022.

[https://doi.org/10.1007/s42405-021-00423-6]

-

S. Atoev, K. R. Kwon, S. H. Lee, and K. S. Moon, “Data analysis of the MAVLink communication protocol,” International Conference on Information Science and Communications Technologies (ICISCT), Tashkent, Uzbekistan, pp. 1-3, 2017

[https://doi.org/10.1109/ICISCT.2017.8188563]

-

H. J. Kim, S. Kang, and D. Kim, “Development of autonomous driving algorithm for robots in high-rise buildings using Gazebo simulator," Journal of Institute of Control, Robotics and Systems (in Korean), vol. 28, no. 8, pp. 758-767, Aug. 2022.

[https://doi.org/10.5302/J.ICROS.2022.22.0093]

- S. H. Park, Y. C. Yang, J. H. Min, J. H. Park, N. K. Kim, B. Seo, S. K. Kim, and J. Y. Seok, “Precision landing algorithm of a UAM scaled model based on CNN image recognition,” Proc. of 2024 39th ICROS Annual Conference (in Korean), Daejeon, Korea, pp. 393-394, Jul, 2024.

- CNU_UASG, “Precision Landing of Scaled Tilt-Rotor UAM Aircraft Using Artificial Intelligence Image Recognition,” https://www.youtube.com/watch?v=BwqEm0_bvjY

-

H. J. Lee and Y. B. Hwang, “CNN-based machine vision classifier using channel-wise fusion of multiple illuminations,” Journal of Institute of Control, Robotics, and Systems (in Korean), vol. 28, no. 10, pp. 855-861, Oct. 2022.

[https://doi.org/10.5302/J.ICROS.2022.22.0110]

-

S. H. Kim, “Semantic Image Segmentation-Based Safe Landing Point Determination Method for VTOL UAVs,” Journal of Institute of Control, Robotics, and Systems (in Korean), vol. 28, no. 10, pp. 897-902, Oct. 2022.

[https://doi.org/10.5302/J.ICROS.2022.22.0118]

2024년 충남대 항공우주공학과(공학사), 2024년~현재 충남대 항공우주공학과 석사과정 재학 중. 관심분야는 무인항공기 최적제어, 유도법칙, 체계종합 및 비행시험.

2024년 충남대 항공우주공학과(공학사), 2024년~현재 충남대 항공우주공학과 석사과정 재학 중. 관심분야는 무인항공기 유도제어, 충돌회피, 체계종합 및 비행시험.

2024년 한서대 항공소프트웨어공학과(공학사), 2024년~현재 충남대 항공우주공학과 석사과정 재학 중. 관심분야는 무인항공기 유도제어, 딥러닝, 컴퓨터 비전.

2017년 충남대 항공우주공학과(공학사), 2019년 충남대 항공우주공학과(공학석사), 2019년~현재 충남대 항공우주공학과 박사과정 재학 중. 관심분야는 VTOL 천이제어, 동축 반전 헬리콥터 자세 제어, 충돌회피.

2002년 서울대 기계항공공학부(공학사), 2008년 서울대 기계항공공학부(공학박사), 2008~12년 영국 Cranfield University 연구원/조교수, 2012년~현재 충남대 항공우주공학과 교수. 관심분야는 소형비행체, 비선형/지능제어, 의사결정.

1992년 서울대 항공우주공학과(공학사), 1994년 서울대 항공우주공학과(공학석사), 1998년 서울대 항공우주공학과(공학박사) 2001년~현재 충남대 항공우주공학과 교수. 관심분야는 무인항공기 비행제어 및 응용.