저조도 장면 합성을 위한 밀도 주도 NeRF

Copyright© ICROS 2025

Abstract

Neural Radiance Fields (NeRF) shows impressive results in novel view synthesis under normal illumination. However, in low-light scenes, the limited pixel values reduce the influence of volume density in rendering, leading to inaccurate radiance field learning. To address this issue, we propose a Density-Driven NeRF that improves performance in low-light conditions. Our method uses a pre-trained NeRF on normal-light images as a density teacher and applies the L2 loss to encourage the student network to match the teacher’s predicted density. This leads to accurate volume rendering despite limited visual cues. Experimental results on synthetic low-light datasets show that our approach improves RGB image quality evaluated by PSNR, SSIM and LPIPS, and yields better geometric consistency assessed by RMSE and δ-accuracy of the predicted density.

Keywords:

neural radiance fields (NeRF), novel view synthesis, low-light scene synthesisI. 서론

장면 재구성은 가상 현실(virtual reality), 증강 현실(augmented reality), 혼합 현실(mixed reality), 메타버스, 디지털 컨텐츠 제작 등 다양한 분야에서 핵심 기술로 활용되고 있다. 기존에는 라이다(lidar) 센서 또는 멀티 뷰 스테레오를 기반으로 한 포인트 클라우드와 메시(mesh) 기반의 3D 재구성 기술이 주로 사용되었다. 그러나 이러한 방식은 복잡한 전처리 과정과 정밀한 센서 장비를 요구하며, 시점에 따라 일관된 시각 정보를 제공하는 데 한계가 있다.

이러한 한계를 극복하기 위해 신경 방사장(neural radiance fields, NeRF [1])이 제안되었으며, 3D 공간을 명시적으로 복원하는 것이 아니라 주어진 카메라 시점에서의 장면을 연속적으로 합성하는 새로운 패러다임을 제시하였다. NeRF는 체적 렌더링 기반의 학습을 통해 장면의 색상과 밀도를 추정함으로써 다양한 시점에서의 이미지를 고품질로 생성할 수 있다. NeRF의 등장 이후 관련 연구가 많이 진행되었다[2]. 그러나 NeRF는 연산 속도가 느리고, 정적인 광원에 대해서만 최적화가 가능하다는 단점이 있다. 연산 속도를 개선하기 위해 Plenoxels [3], TensoRF [4], Instant-NGP [5] 등이 연구되었으며, 광원과 방해물 등 다양한 환경의 장면을 활용해 새로운 장면을 합성하는 NeRF-W [6]도 등장하였다. 또한 도시 수준의 큰 규모에서의 장면 합성을 위한 MatrixCity [7], 합성한 장면을 수정할 수 있는 NeRF-Art [8], Blending-NeRF [9], Neural Radiance GAN [10] 등이 등장하였으며, Aleth-NeRF [11], LLNeRF [12]와 같이 저조도 장면의 밝기를 개선해 정상 조명 장면을 합성하는 연구도 진행되었다.

이처럼 NeRF의 등장으로 다양한 작업에 신경 방사장이 응용되고 있다. 그러나 이러한 연구들은 저조도 환경을 유지하는 것이 아닌 정상 조명 조건으로 개선하는 것이 목표이며, 저조도 환경 그대로 사실적인 장면을 표현하는 데에는 한계가 있다. NeRF는 주로 정상 조명 조건에서 높은 성능을 보이며, 저조도 환경에서는 성능이 급격하게 저하되는 문제가 있다. 저조도 이미지의 경우 전체적인 픽셀 밝기가 낮고 색상 정보가 제한적이기 때문에 방사장(radiance field)을 구성하는 데 필수적인 밀도 학습이 제대로 이루어지지 않는 경향이 있다.

이를 해결하기 위해 본 논문에서는 저조도 환경에서도 강인하게 동작할 수 있는 NeRF 모델을 제안한다. 정상 조명 이미지로 학습한 NeRF의 밀도 정보를 활용하여 저조도 이미지 기반 NeRF의 밀도 학습을 유도한다. 특히, 정상 조명 NeRF를 교사 네트워크(teacher network)로 설정하고, 이로부터 생성된 밀도 정보를 지도 신호(supervision signal)로 활용함으로써 저조도 NeRF가 보다 정확한 체적 렌더링(volume rendering)을 수행할 수 있도록 한다.

II. 관련 연구

1. 새로운 시점 합성(novel view synthesis)

새로운 시점 합성은 3D 장면 재구성과 컴퓨터 그래픽스에서 중요한 연구 주제로서, 주어진 시점 외의 새로운 시점에서의 장면을 렌더링하는 기술이다. 초기에는 이미지 기반 렌더링 기법을 활용하여 두 시점의 이미지들을 보간하여 중간 시점의 이미지를 생성하는 시점 보간[13] 방식이 사용되었다.

최근에는 딥러닝 기반의 새로운 시점 합성이 많이 연구되고 있으며, 합성곱 신경망(convolutional neural networks) 기반의 모델인 DeepStereo [14]와 생성적 적대 신경망(generative adversarial networks) [15] 기반의 모델인 Pix2Pix [16] 등이 새로운 시점 합성에 적용되었다. 가장 최근에는 장면을 연속적인 공간으로 표현하는 방식의 NeRF와 3D Gaussian Splatting [17]이 주목받고 있다.

2. NeRF

NeRF (Neural Radiance Fields)는 장면을 3D로 모델링하지 않고, 새로운 시점에서 바라보는 장면을 생성하는 방식이다. NeRF는 여러 각도에서 촬영한 이미지들에 대한 카메라 파라미터(x, y, z)를 다층 퍼셉트론(multi-layer perceptron)에 통과시켜 해당 위치에서의 색상(R, G, B)과 밀도(σ)를 예측하는 방식으로 학습이 진행된다.

기존의 3D 렌더링 방식과는 다르게 장면을 연속적인 공간으로 표현하기 때문에 시점의 이동이 자연스럽고 3D 모델을 만들 필요가 없으므로 저장 공간에 제약이 없다.

하지만, 색상만을 지도 신호로 활용하는 NeRF의 특성으로 인해 제한된 색상 범위를 가지는 저조도 이미지에 대해서는 밀도를 제대로 학습하지 못하고, 결과적으로 방사장을 올바르게 구성하지 못하기 때문에 저조도 이미지에 대해 새로운 장면을 합성하는 데에 한계가 있다.

III. 제안 방법

1. 정상 조명 이미지의 저조도화

본 연구에서는 동일한 카메라 위치, 각도에 대한 정상 조명-저조도 이미지 쌍을 구축하기 위해 주-야간 도메인 적응 모델[18]의 암화(darkening) 모듈을 이용하여 정상 조명 이미지를 저조도 이미지로 변환한다.

해당 모듈은 정상 조명 이미지와 저조도 이미지 간의 픽셀 유사성은 최소화하고, 특징 유사성을 최대화하도록 학습한다. 이를 통해 이미지의 특징을 유지하면서도 자연스러운 저조도 이미지를 획득할 수 있다.

2. 밀도 주도 NeRF

NeRF는 평균제곱오차 손실을 사용하여 목표 이미지와 생성된 장면을 비교하여 평가한다. 이때, 두 이미지의 픽셀 값(색상)만으로 계산하기 때문에 방사장 상에서 밀도가 제대로 예측되었는지 알기 어렵다.

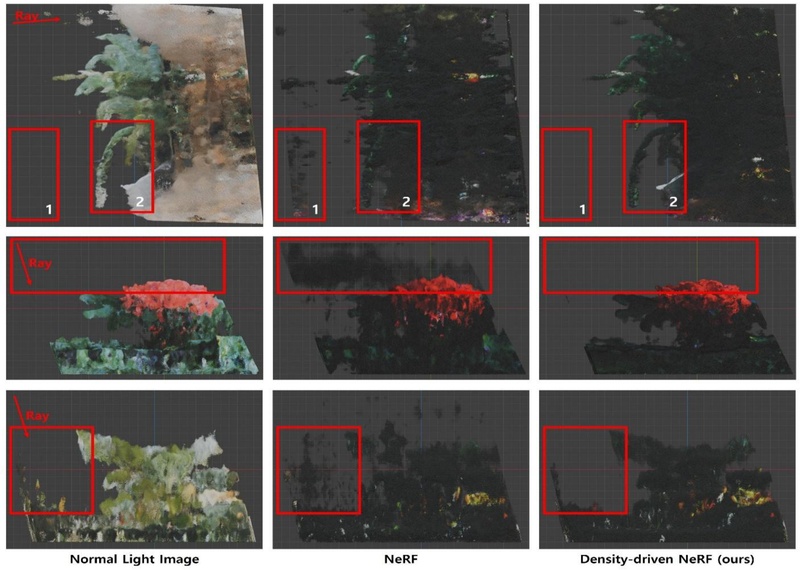

검은색에 가까운 픽셀에 대해 방사장 상에서 단순히 카메라와 가장 가까운 점을 높은 밀도로 예측하거나 물체가 없다고 판단하여, 모든 점에 대해 낮은 밀도로 예측하는 등 올바른 방사장을 구성하지 못하고 노이즈가 발생하는 것을 확인할 수 있다(그림 1 참조).

Result of visualizing the radiance field of NeRF trained on normal illumination and low-light images as a point cloud.

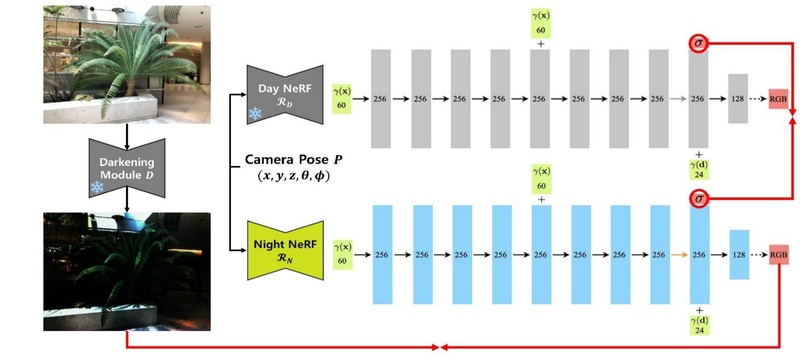

이러한 문제를 해결하기 위해 정상 조명 이미지로 학습한 Day-NeRF를 교사 네트워크로 설정하고, 해당 네트워크로 예측한 정상 조명 이미지의 밀도와 저조도 이미지의 색상을 지도 신호로 활용하여 저조도 환경과 공간의 밀도를 모두 유지하는 밀도 주도 NeRF를 제안한다. 제안하는 네트워크의 구조는 그림 2와 같다. 눈송이 모양은 사전 학습된 모델을 의미하며, 화살표의 방향은 두 정보 간의 손실을 최소화하는 방향이다.

IV. 실험 및 결과

1. 데이터세트

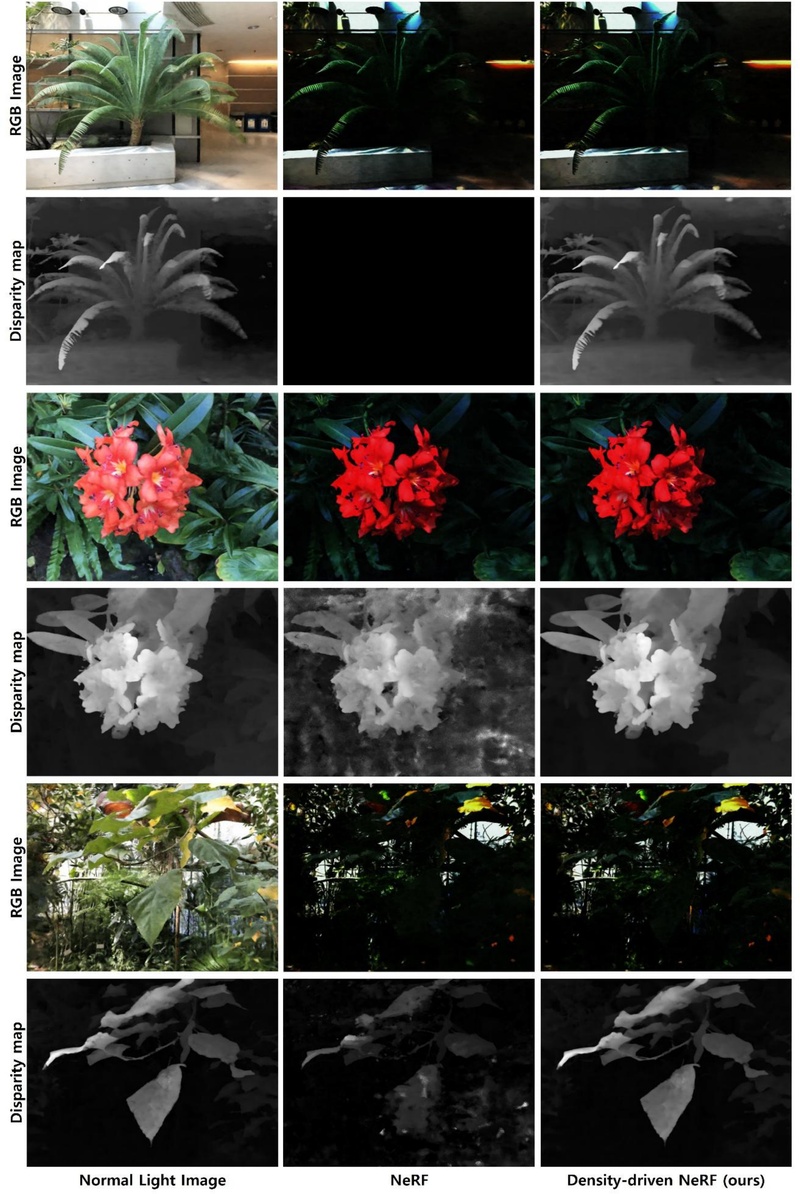

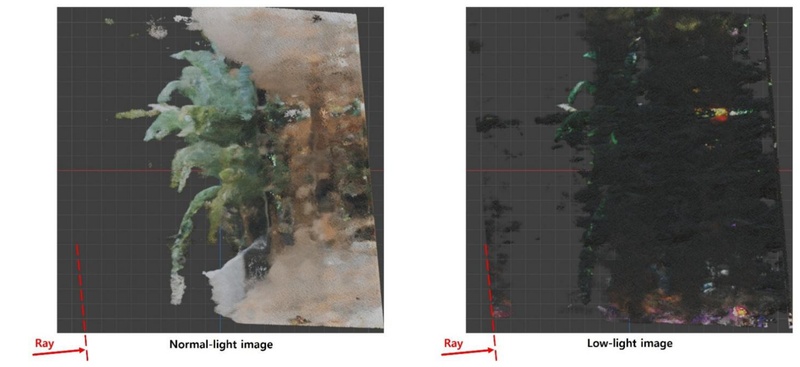

데이터세트는 LLFF [19]의 양치류, 꽃, 잎 데이터를 사용하였다. 4032×3024의 고해상도 이미지이며, 학습을 위해 1/8인 504×378의 해상도로 크기를 변경하였다. 각 데이터는 20, 34, 26개의 시점에서 촬영한 이미지로 구성되어 있으며, 각 이미지 당 3×4 변환행렬, 이미지의 너비와 높이, 초점 거리, 최소 및 최대 깊이를 포함하는 17개의 값을 가지고 있다. 학습에 사용된 정상 조명 이미지와 저조도화된 저조도 이미지는 그림 3과 같다.

2. 평가 방식

본 연구에서는 생성된 저조도 이미지의 품질을 평가하기 위해 RGB 이미지에 대해서는 PSNR, SSIM, LPIPS 를, 밀도에 대해서는 RMSE, 𝛿-Accuracy 를 사용하였다.

PSNR (Peak Signal-to-Noise Ratio)은 두 이미지 간의 픽셀 차이를 기반으로 화질을 수치화한 지표로, 값이 클수록 원본 이미지와의 유사도가 높음을 의미하며, 식 (1)로 정의된다.

| (1) |

여기서 𝐿은 이미지의 최대 픽셀 값으로, 본 연구에서는 255이다.

SSIM (Structural Similarity Index Measure)은 이미지의 구조적 유사성을 평가하는 지표로, 밝기, 대비, 구조적 정보를 고려하여 유사성을 측정한다. 값이 1에 가까울수록 두 이미지가 구조적으로 유사함을 의미하며, 식 (2)로 정의된다.

| (2) |

여기서 𝜇𝑥, 𝜇𝑦는 평균 밝기, , 은 분산(대비), σxy는 공분산(구조적 유사성), 𝐶1, 𝐶2는 상수이다.

LPIPS (Learned Perceptual Image Patch Similarity)는 두 이미지 간의 지각적 유사성을 평가하는 지표로, 사전 학습된 모델을 통해 각 이미지의 특징을 추출하여 특징 간의 유사성을 계산한다. 특징 추출을 위한 모델로는 가장 일반적으로 사용되는 VGGNet[20]을 활용하였으며 식 (3)으로 정의된다.

| (3) |

여기서 𝑓𝑙 (⋅)은 VGGNet의 l번째 레이어를 통해 추출된 특징이며, 𝑤𝑙은 해당 레이어의 가중치이다.

RMSE (Root Mean Squared Error)는 두 값 사이의 평균 제곱 오차의 제곱근으로 식 (4)로 정의된다.

| (4) |

δ-Accuracy는 두 값의 비율이 특정 범위 안에 얼마나 들어오는지를 평가하는 지표로, 식 (5)로 정의된다.

| (5) |

여기서 Threshold는 1.25, 1.252, 1.253으로 각각 두 값의 비율이 25%, 56%, 95% 이내에 들어오는지 평가한다.

3. 실험 결과

각 데이터에 대한 정량적 결과는 표 1과 같다. RGB 이미지에 대해서는 유사한 성능을 보이는 것을 알 수 있다. 이는 기존의 NeRF가 색상을 지도 신호로 활용하기 때문에 입력 이미지와 유사한 이미지를 생성하기 때문이다.

밀도에 대해서는 매우 큰 향상을 보여주고 있는데, 이는 제안하는 방법이 기존의 NeRF와 달리 저조도 방사장에서 밀도를 제대로 예측하고 있다는 것을 의미한다.

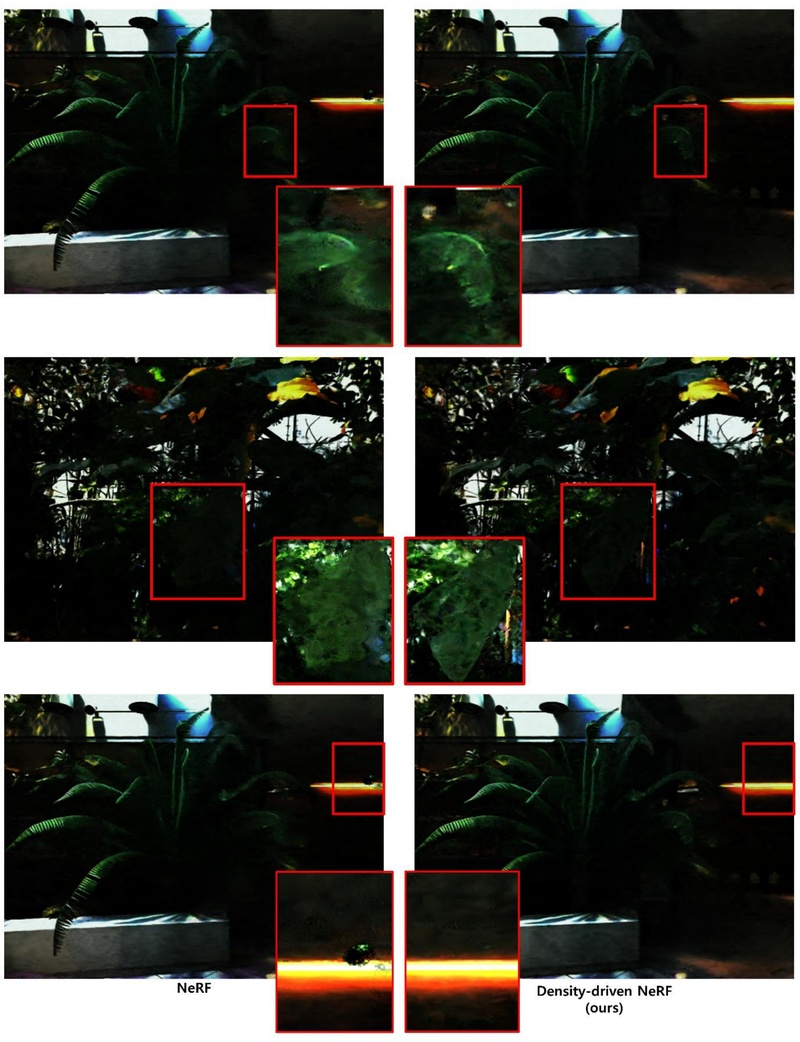

정성적 결과는 그림 4~7과 같다. 그림 4에서 좌측은 정상 조명 이미지에 대한 기존 NeRF의 결과, 중앙은 저조도 이미지에 대한 기존 NeRF의 결과, 우측은 저조도 이미지에 대한 제안 방법의 결과이다. 기존의 NeRF는 그럴듯한 RGB 이미지를 생성하지만 방사장의 밀도를 예측하지 못한다. 이에 반해, 제안하는 방법은 정상 조명 이미지로 학습한 결과와 같이 밀도를 예측하는 것을 확인할 수 있다. 그림 5에서는 세부적인 생성 결과의 차이를 확인할 수 있다. 기존의 NeRF는 세부적인 형태를 제대로 표현하지 못하거나 아티팩트(artifact)가 생기는 것에 반해, 제안하는 방법은 더 양질의 이미지를 생성하는 것을 볼 수 있다.

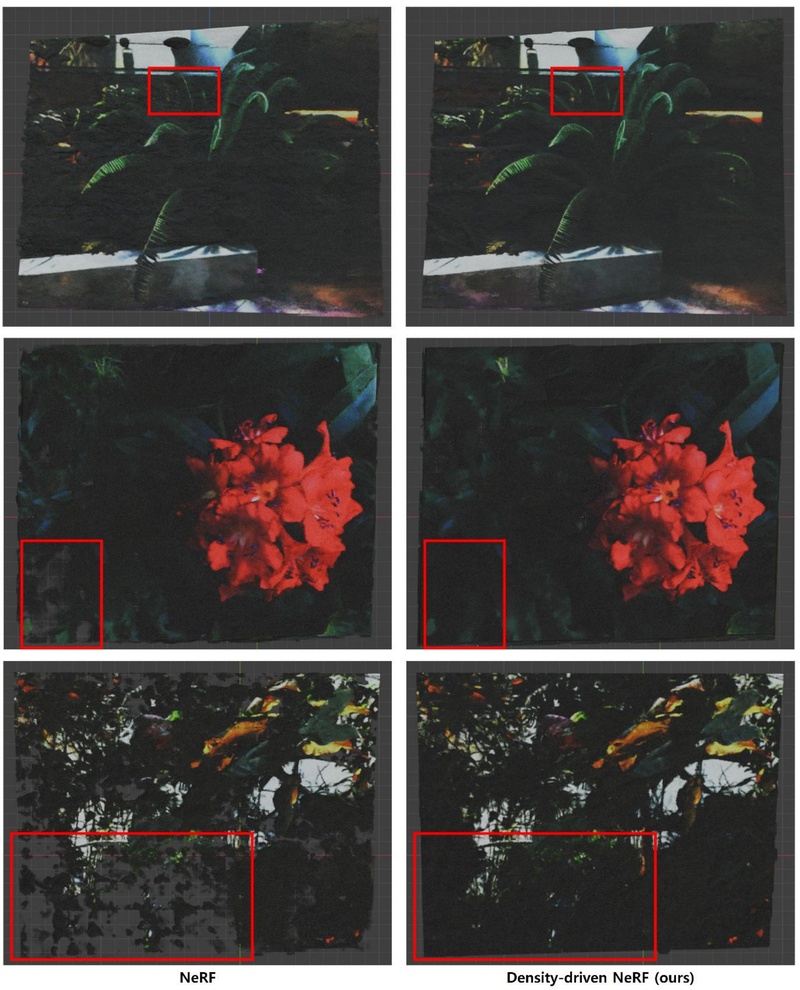

그림 6과 그림 7은 방사장을 포인트 클라우드로 렌더링한 결과이다. 그림 6은 정면의 모습인데, 기존의 NeRF는 어두운 픽셀을 통과하는 광선 부분에 밀도가 없다고 판단하여 뚫려 있는 모습을 확인할 수 있다. 그림 7은 측면의 모습이며, 기존의 NeRF는 카메라와 가까운 위치나 밀도가 없어야 할 부분에 밀도가 높은 검은색 노이즈가 발생하는 것을 확인할 수 있다. 이에 반해, 제안하는 방법은 정면과 측면 모두 노이즈 없이 깨끗한 결과를 보여주고 있다.

V. 결론

본 연구는 정상 조명에서 학습된 NeRF의 밀도 정보를 지도 신호로 활용하여 저조도 환경에서도 정확한 장면 합성을 가능하게 하는 NeRF 학습 방법을 제안하였다. 저조도 환경을 개선하여 정상 조명 장면을 합성하는 기존의 저조도 장면에 대한 NeRF의 응용 연구와 달리, 본 연구에서는 NeRF가 저조도 환경을 유지하며 사실적인 장면을 합성할 수 있도록 이끌었다.

제안된 방법은 기존의 NeRF가 저조도 이미지에서 밀도 예측에 실패하여 방사장 구성에 한계를 보였던 문제를 해결하며, 정상 조명 이미지 기반 NeRF의 방사장에서 추출한 밀도 값을 학습에 반영함으로써 저조도 환경을 유지한 채 더 정확한 체적 렌더링을 가능하게 한다. 실험 결과, 제안된 방법은 RGB 이미지에 대해서는 평균 1.34% 향상된 결과를 보였으며, 밀도 예측에서 기존의 NeRF보다 평균 55배 높은 정확도를 보였고, 이는 방사장의 구조적 품질 향상으로 이어졌다.

향후 연구에서는 제안된 방법을 다양한 저조도 환경에 적용하여 성능을 평가하고, 실시간 작업을 위해 효율성을 개선하는 연구가 필요하다. 또한 다양하고 복잡한 장면에 대한 적용 가능성을 검토할 필요가 있다.

Acknowledgments

본 연구는 2025년도 정부(산업통상자원부)의 재원으로 한국산업기술진흥원의 지원을 받아 수행된 연구임(No.RS-2021-KI002499, 2025년 산업혁신인재성장지원사업).

REFERENCES

-

B. Mildenhall, P. P. Srinivasan, M. Tancik, J. T. Barron, R. Ramamoorthi, and R. Ng, “NeRF: Representing scenes as neural radiance fields for view synthesis,” Communications of the ACM, vol. 65, no. 1, pp. 99-106, Dec. 2021.

[https://doi.org/10.1145/3503250]

- J. Choi and S. Choi, “Principles and technological trends of NeRF,” Magazine of Institute of Control, Robotics and Systems, vol. 28, no. 4, pp. 27-36, 2022. https://www.dbpia.co.kr/journal/articleDetail?nodeId=NODE11178497

-

S. Fridovich-Keil, A. Yu, M. Tancik, Q. Chen, B. Recht, and A. Kanazawa, “Plenoxels: Radiance fields without neural networks,” Proc. of the 2022 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), New Orleans, LA, USA, pp. 5491-5500, Jun. 2022.

[https://doi.org/10.1109/cvpr52688.2022.00542]

-

A. Chen, Z. Xu, A. Geiger, J. Yu, and H. Su, “TensoRF: Tensorial radiance fields,” Proc. of the 17th European Conference on Computer Vision (ECCV), Tel Aviv, Israel, pp. 333-350, Oct. 2022.

[https://doi.org/10.1007/978-3-031-19824-3_20]

-

T. Müller, A. Evans, C. Schied, and A. Keller, “Instant neural graphics primitives with a multiresolution hash encoding,” ACM Transactions on Graphics, vol. 41, no. 4, pp. 1-15, Jul. 2022.

[https://doi.org/10.1145/3528223.3530127]

-

R. Martin-Brualla, N. Radwan, M. S. M. Sajjadi, J. T. Barron, A. Dosovitskiy, and D. Duckworth, “NeRF in the wild: Neural radiance fields for unconstrained photo collections,” Proc. of the 2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), Nashville, TN, USA, pp. 7206-7215, Jun. 2021.

[https://doi.org/10.1109/CVPR46437.2021.00713]

-

Y. Li, L. Jiang, L. Xu, Y. Xiangli, Z. Wang, and D. Lin, “Matrixcity: A large-scale city dataset for city-scale neural rendering and beyond,” Proc. of the 2023 IEEE/CVF International Conference on Computer Vision (ICCV), Paris, France, pp. 3182-3192, Oct. 2023.

[https://doi.org/10.1109/ICCV51070.2023.00297]

-

C. Wang, R. Jiang, M. Chai, M. He, D. Chen, and J. Liao, “NeRFart: Text-driven neural radiance fields stylization,” IEEE Transactions on Visualization and Computer Graphics, vol. 30, no. 8, pp. 4983-4996, Aug. 2024.

[https://doi.org/10.1109/TVCG.2023.3283400]

-

H. Song, S. Choi, H. Do, C. Lee, and T. Kim, “Blending-NeRF: Text-driven localized editing in neural radiance fields,” Proc. of the 2023 IEEE/CVF International Conference on Computer Vision (ICCV), Paris, France, pp. 14337-14347, Oct. 2023.

[https://doi.org/10.1109/ICCV51070.2023.01323]

- H. Jeong, B. Jeon, J. Kwak, S. Park, and M. Jeong, “Neural radiance generative adversarial network for photorealistic space design,” Proc. of the 38th ICROS Annual Conference (ICROS2023), Samcheok, Korea, pp. 556-557, Jun. 2023. https://www.dbpia.co.kr/journal/articleDetail?nodeId=NODE11480460

-

Z. Cui, L. Gu, X. Sun, X. Ma, Y. Qiao, and T. Harada, “Aleth-NeRF: Illumination adaptive NeRF with concealing field assumption,” Proc. of the 38th AAAI Conference on Artificial Intelligence, Vancouver, Canada, pp. 1435-1444, Feb. 2024.

[https://doi.org/10.1609/aaai.v38i2.27908]

-

H. Wang, X. Xu, K. Xu, and R. W. H. Lau, “Lighting up NeRF via unsupervised decomposition and enhancement,” Proc. of the 2023 IEEE/CVF International Conference on Computer Vision (ICCV), Paris, France, pp. 12598-12607, Oct. 2023.

[https://doi.org/10.1109/ICCV51070.2023.01161]

-

S. E. Chen and L. Williams, “View interpolation for image synthesis,” Proc. of the 20th Annual Conference on Computer Graphics and Interactive Techniques, Anaheim, CA, USA, pp. 279-288, Aug. 1993.

[https://doi.org/10.1145/166117.166153]

-

J. Flynn, I. Neulander, J. Philbin, and N. Snavely, “Deep stereo: Learning to Predict new views from the world's imagery,” Proc. of the 2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Las Vegas, NV, USA, pp. 5515-5524, Jun. 2016.

[https://doi.org/10.1109/CVPR.2016.595]

-

I. Goodfellow, J. Pouget-Abadie, M. Mirza, B. Xu, D. Warde-Farley, S. Ozair, A. Courville, and Y. Bengio, “Generative adversarial networks,” Communications of the ACM, vol. 63, no. 11, pp. 139-144. Oct. 2020.

[https://doi.org/10.1145/3422622]

-

P. Isola, J.-Y. Zhu, T. Zhou, and A. A. Efros, “Image-to-image translation with conditional adversarial networks,” Proc. of the 2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Honolulu, HI, USA, pp. 5967-5976, Jul. 2017.

[https://doi.org/10.1109/CVPR.2017.632]

-

B. Kerbl, G. Kopanas, T. Leimkuehler, and G. Drettakis, “3D Gaussian splatting for real-time radiance field rendering,” ACM Transactions on Graphics, vol. 42, no. 4, pp. 1-14, Jul. 2023.

[https://doi.org/10.1145/3592433]

-

R. Luo, W. Wang, W. Yang, and J. Liu, “Similarity min-max: zero-shot day-night domain adaptation,” Proc. of the 2023 IEEE/CVF International Conference on Computer Vision (ICCV), Paris, France, pp. 8070-8080, Oct. 2023.

[https://doi.org/10.1109/ICCV51070.2023.00744]

-

B. Mildenhall, P. P. Srinivasan, R. Ortiz-Cayon, N. K. Kalantari, R. Ramamoorthi, R. Ng, and A. Kar, “Local light field fusion: practical view synthesis with prescriptive sampling guidelines,” ACM Transactions on Graphics, vol. 38, no. 4, pp. 1-14, Jul. 2019.

[https://doi.org/10.1145/3306346.3322980]

-

K. Simonyan and A. Zisserman, “Very deep convolutional networks for large-scale image recognition,” Proc. of the 3rd International Conference on Learning Representations (ICLR), San Diego, CA, USA, May 2015.

[https://doi.org/10.48550/arXiv.1409.1556]

2023년 광운대학교 로봇학부 졸업. 2023년~현재 광운대학교 대학원 로봇학과 석사과정 재학 중. 관심분야는 로보틱스, 컴퓨터비전, 생성모델.

1994년 한국과학기술원 전기및전자공학과(공학사). 1997년 한국과학기술원 전기및전자공학과(공학석사). 2001년 한국과학기술원 전기및전자공학과(공학박사). 2008년~현재 광운대학교 로봇학과 교수. 관심분야는 기계학습, 로봇 소프트웨어.